主要内容

rlRepresentationOptions

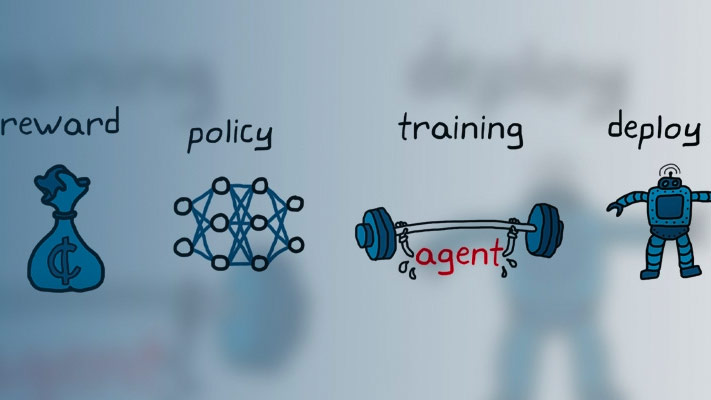

选项设置为强化学习代理表示(批评家和演员)

描述

创建

属性

对象的功能

rlValueRepresentation |

评论家表示值函数强化学习代理 |

rlQValueRepresentation |

强化学习代理核反应能量函数评论家表示 |

rlDeterministicActorRepresentation |

强化学习代理确定的演员表示 |

rlStochasticActorRepresentation |

强化学习代理随机演员表示 |

例子

另请参阅

介绍了R2019a