什么是int8量化,为什么它在深度神经网络中流行?

作者:Ram Cherukuri, MathWorks

在边缘进行实时推理的深度学习部署是许多应用领域的关键。它在网络带宽、网络延迟和功耗方面显著降低了与云通信的成本。

但是,边缘设备的内存、计算资源和功率有限。这意味着深度学习网络必须针对嵌入式部署进行优化。

int8量化已经成为一种流行的优化方法,不仅适用于TensorFlow和PyTorch等机器学习框架,还适用于NVIDIA等硬件工具链®TensorRT和Xilinx®dnndk -主要是因为int8使用8位整数而不是浮点数,使用整数数学而不是浮点数学,减少了内存和计算需求。

这些要求可能相当可观。例如,相对简单的网络如AlexNet超过200 MB,而像VGG-16这样的大型网络超过500 MB[1]。这种规模的网络不适合低功耗微控制器和较小的fpga。

在本文中,我们将仔细研究使用8位表示数字意味着什么,并了解int8量化(用整数表示数字)如何将内存和带宽使用减少75%。

int8表示

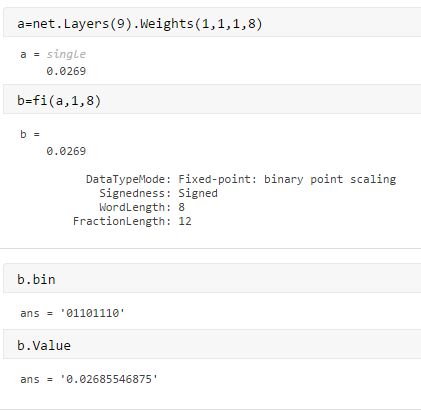

我们从一个简单的例子开始,使用一个VGG16网络,由几个卷积层和ReLU层以及几个全连接层和最大池化层组成。首先,让我们看看现实世界中的数字(在本例中是卷积层中的权重)如何用整数表示。这个函数fi在MATLAB®为我们提供了使用8位字长权重的最佳精确缩放。这意味着我们获得了缩放因子为2^-12的最佳精度,并将其存储为位模式01101110,它表示整数110。

\[Real\_number = stored\_integer * scaling\_factor\]

\ [0.0269 = 110 * 2 ^ {-12} \]

脚本如下:

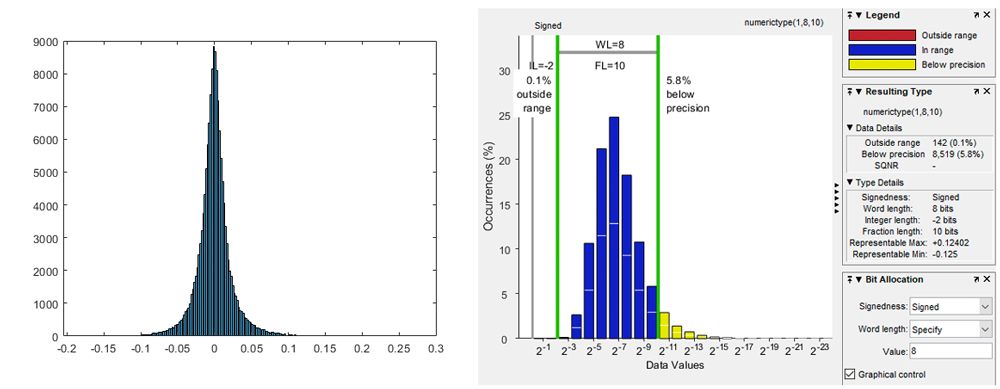

现在让我们考虑层的所有权值。使用fi同样,我们发现在卷积层中为所有权重提供最佳精度的比例因子是2^-8。我们在直方图中可视化权重的动态范围分布。直方图显示,大多数权重分布在2^-3和2^-9的范围内(图1)。这也表明了权重分布的对称性。

这个例子展示了用8位整数量化和表示的一种方法。还有一些其他的选择:

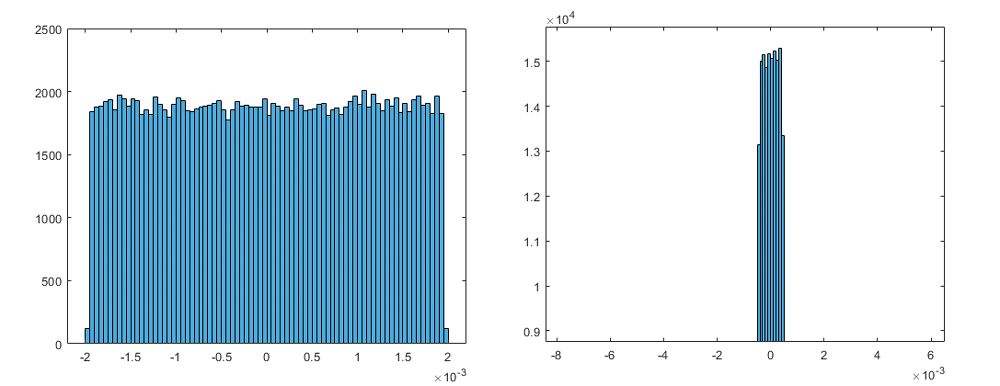

通过考虑精度权衡选择不同的比例因子.因为我们选择了2^-8的比例因子,近22%的权重低于精度。如果我们选择2^-10的比例因子,只有6%的权重会低于精度,但0.1%的权重会超出范围。误差分布和最大绝对误差也说明了这种权衡(图2)。我们可以选择16位整数,但这样我们将使用两倍的位数。另一方面,使用4位将导致显著的精度损失或溢出。

在调用时指定偏置fi,基于权重分布。

\[Real\_number = stored\_integer * scaling\_factor + bias\]

您可以对任何网络(比如ResNet50或yolo)进行类似的分析,并确定一个整数数据类型或比例因子,可以在一定的容差范围内表示权重和偏差。

使用int8将数据表示为整数有两个关键好处:

- 您可以将数据存储需求减少4倍,因为单精度浮点数需要32位来表示一个数字。结果是减少了用于存储所有权重和偏差的内存以及传输所有数据所消耗的能量,因为能量消耗主要由内存访问决定。

- 您可以通过使用整数计算而不是浮点数学来获得进一步的加速,这取决于目标硬件。例如,你可以在NVIDIA gpu上使用半精度浮点。大多数cpu不支持本地半计算。万博1manbetx但是,所有目标都支持整数数学,有些目标还提供万博1manbetx某些特定于目标的intrinsic,例如SIMD支持,在使用整数进行底层计算时,这些特性可以显著提高速度。

将网络量化为int8

量化背后的核心思想是神经网络对噪声的弹性;特别是深度神经网络,它被训练来识别关键模式并忽略噪音。这意味着网络可以应对由量化错误引起的网络权重和偏差的微小变化,并且有越来越多的工作表明量化对整个网络的准确性的最小影响。这一点,再加上内存占用、功耗和计算速度的显著降低[1,2],使得量化成为将神经网络部署到嵌入式硬件的有效方法。

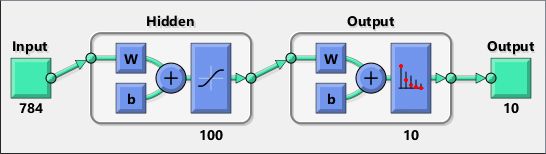

我们将把上面讨论的思想应用到网络中。为了简单起见,我们将使用一个由两层组成的简单网络进行MNIST数字分类。用于图像分类和目标检测的深度网络,如VGG16或ResNet,包括各种各样的层。卷积层和全连接层是内存和计算量最大的层。

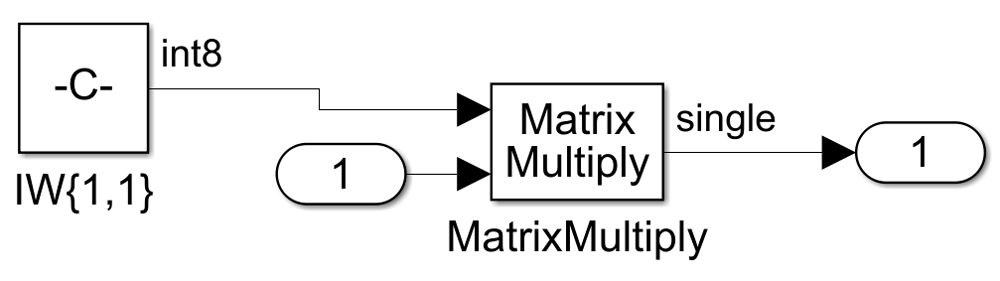

我们的网络模仿了这两层的特性。我们在Simulink中建模了这个网络万博1manbetx®这样我们就可以观察信号流,并更仔细地观察计算的核心(图3)。

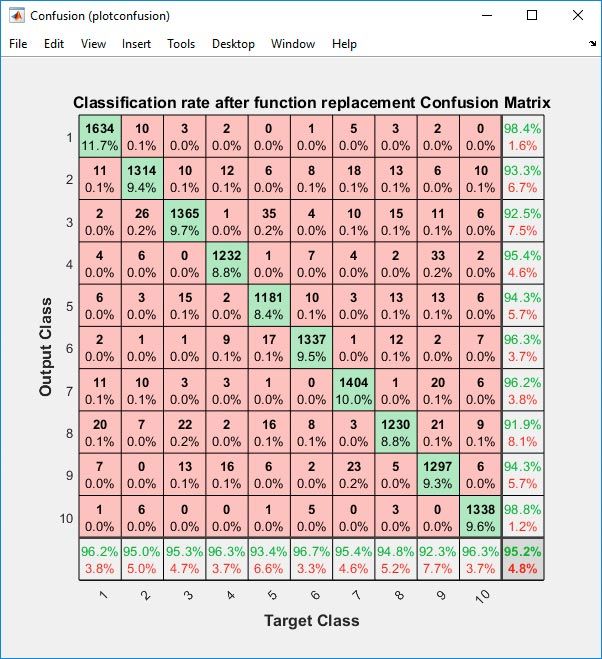

在每一层中,我们将用缩放的int8整数替换权重和偏差,然后将矩阵乘法的输出与固定指数相乘以重新缩放。当我们在验证数据集上验证修改后的网络的预测时,混淆矩阵显示int8表示仍然保持95.9%的准确性(图4)。

为了理解将权重和偏差量化为int8所带来的效率收益,让我们将这个网络部署到一个嵌入式硬件目标上——在本例中,是ST发现板(STM32F746G).我们将分析两个关键指标:

- 内存使用情况

- 运行时执行性能

当我们尝试部署原始模型(在双精度浮点中)时,它甚至不适合电路板,并且RAM溢出。最简单的解决方法是将权重和偏差转换为单一数据类型。该模型现在适合于目标硬件,但仍有改进的空间。

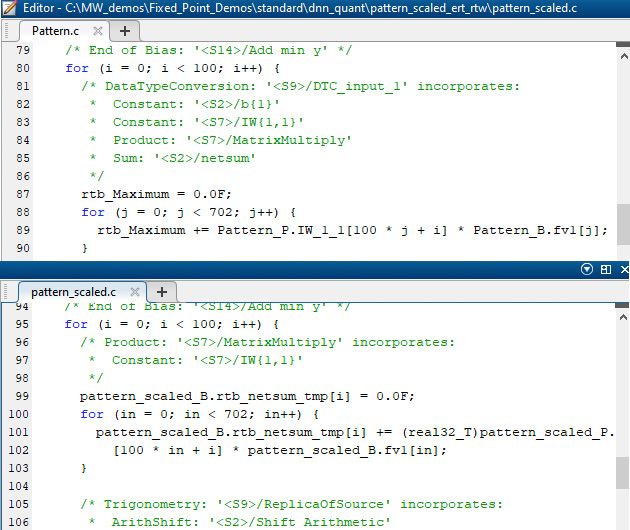

我们使用的缩放模型使用int8作为权重和偏差矩阵,但计算仍然是单精度的(图5)。

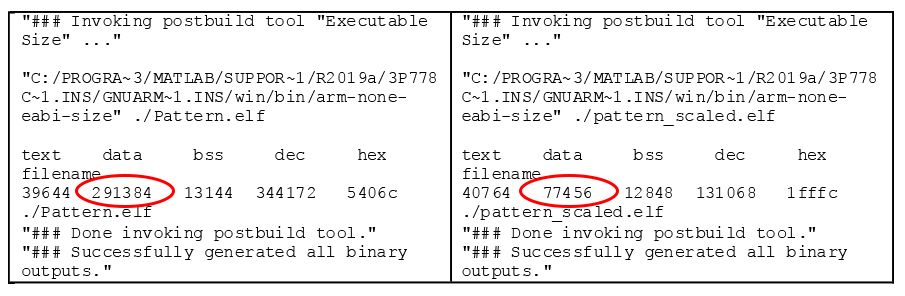

生成的代码消耗的内存比预期的少4倍(图6)。

然而,在发现板上的执行时间显示,单精度版本平均需要14.5毫秒(约69帧/秒)来运行,而缩放版本稍微慢一些,平均需要19.8毫秒(约50帧/秒)。这可能是因为转换为单精度的开销,因为我们仍然在单精度上进行计算(图7)。

这个例子只涉及了量化的一个方面——在int8中存储权重和偏差。通过将相同的原理应用于AlexNet和VGG等标准现货网络,您可以将其内存占用减少3倍。

例如,TensorFlow以两种形式支持训练后量化到8位——只有带浮点内核的权重和权重和激活的全整数量化[3]。TensorFlow使用带有偏差的缩放因子来映射到int8范围[-128,127],而NVIDIA TensorRT通过确定一个阈值来将权重编码到[-128,127]范围,从而避免了偏差的需要,该阈值可以最大限度地减少信息损失,并使超出阈值范围[4]的值饱和。

为了充分利用全整数量化的好处,我们还需要将每一层的输入缩放或转换为整数类型。这需要我们为层的输入确定正确的缩放,然后在整数相乘后重新缩放。但是int8是否是正确的数据类型,是否会有溢出,以及网络的准确性是否可以接受?

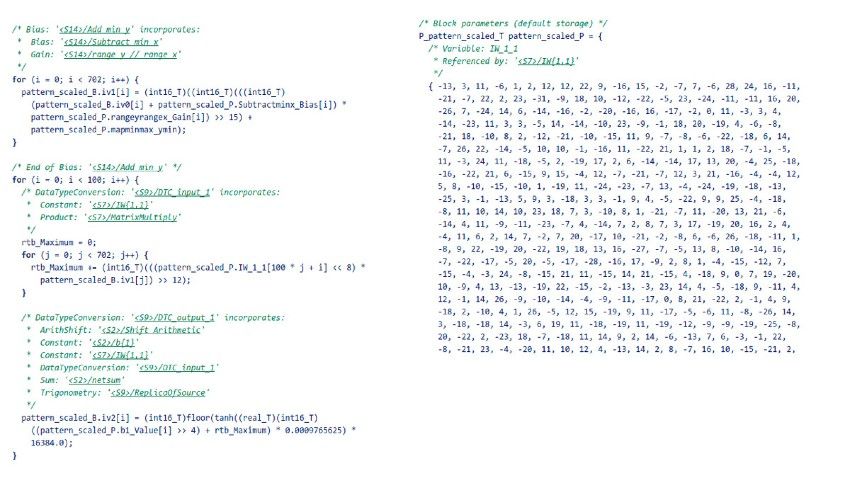

这些问题是定点分析的本质——事实上,数字识别文档示例演示了如何使用定点数据类型[5]转换MNIST网络。按照该示例中说明的步骤,我们提出了权重的8位表示,其插入精度低于1%(图8)。

生成的代码不仅是原来的四分之一;它也更快,11毫秒~ 90帧/秒(图9)。

其他量化技术

我们只看到了正在研究和探索的用于优化嵌入式部署的深度神经网络的许多策略中的一些。例如,第一层中的权重大小为100x702,仅由192个惟一值组成。其他可应用的量化技术包括:

- 通过聚类权重来使用权重共享,并使用Huffman编码来减少权重的数量[1]。

- 将权重量化到最接近2的幂。这大大加快了计算速度,因为它用更快的算术移位操作取代了乘法操作。

- 用查找表替换激活函数,以加快激活函数的计算速度,例如

双曲正切而且经验值.例如,在图9所示的生成代码中,我们可以通过替换双曲正切函数使用查找表。

深度学习应用不仅仅是网络。您还需要考虑应用程序的预处理和后处理逻辑。我们讨论的一些工具和技术已经被用于量化这样的算法几十年了。它们不仅可以用于量化网络,还可以用于量化整个应用程序。

您可以在MATLAB中探索所有这些优化思想。您可以研究量化到进一步限制精度的整数数据类型(如int4)的可行性和影响,或者研究浮点数据类型(如半精度)。结果可能令人印象深刻:Song、Huizi和william[1]使用这些技术的组合,分别将AlexNet和VGG等网络的大小减小了35倍和49倍。

2019年出版的

参考文献

-

深度压缩:用剪枝、训练量化和霍夫曼编码压缩深度神经网络-韩松,毛慧子,william J Dally, ICLR 2016。

-