在实践中,“应用机器学习”意味着你将一种算法应用于数据,该算法创建一个模型,捕捉数据中的趋势。有许多不同类型的机器学习模型可供选择,每一种模型都有自己的特点,这些特点可能使其或多或少适合给定的数据集。

本页概述了可供选择的不同类型的机器学习模型监督式学习;也就是说,对于我们建立模型来预测反应的问题。在监督学习中有两类模型:回归(当响应是连续的)和分类(当响应属于一组类)。

流行的机器学习模型的回归

| 模型 | 图像 | 它是如何工作的 | MATLAB函数 | 进一步的阅读 |

|---|---|---|---|---|

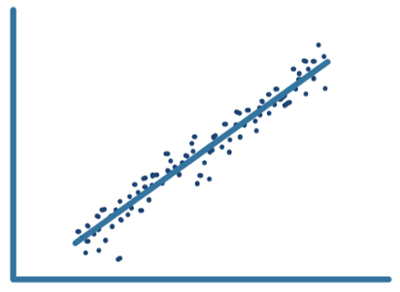

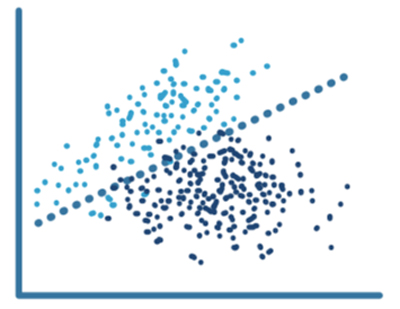

| 线性回归 |  |

线性回归是一种统计建模技术,用于描述一个连续响应变量作为一个或多个预测变量的线性函数。因为线性回归模型很容易解释,也很容易训练,所以它们通常是第一个适合新数据集的模型。 | 菲特姆 |

什么是线性回归模型?(文档) 线性回归机器学习模型的拟合(代码示例) |

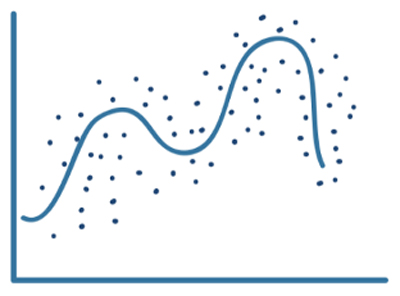

| 非线性回归 |  |

非线性回归是一种统计建模技术,有助于描述实验数据中的非线性关系。非线性回归模型通常假定为参数模型,其中模型被描述为非线性方程。 “非线性”是指一个拟合函数,它是参数的非线性函数。例如拟合参数为b0, b1, b2:方程y = b0+ b1.x+b2.x2.是拟合参数的线性函数,而y = (b0xb1) / (x + b2.)为拟合参数的非线性函数。 |

菲特尔姆 |

非线性回归(文档) 拟合非线性回归机器学习模型(代码示例) |

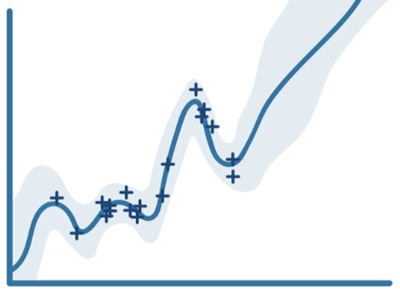

| 高斯过程回归(GPR) |  |

GPR模型是非参数机器学习模型,用于预测连续响应变量的值。 响应变量被建模为高斯过程,使用与输入变量的协方差。 这些模型广泛应用于存在不确定性的空间插值分析领域。探地雷达也称为克里格法。 |

fitrgp |

高斯过程回归模型(文档) 拟合高斯过程机器学习模型(代码示例) |

| 万博1manbetx支持向量机回归 |  |

支持向量机回归算法的工作原理与支持向量机分类算法类似,但经过修改后能够预测连续响应。支持向量机回归算法不是寻找一个分离数据的超平面,而是寻找一个与测量数据偏差不大于一个小值的模型,参数值尽可能小(以最小化对错误的敏感性)。 | fitrsvm |

拟合支持向量机机器学习模型(代码示例) |

| 广义线性模型 |  |

广义线性模型是使用线性方法的非线性模型的特例。它涉及将输入的线性组合拟合到输出的非线性函数(链接函数)。 | 菲特格姆 |

广义线性模型(文档) 拟合广义线性模型(代码示例) |

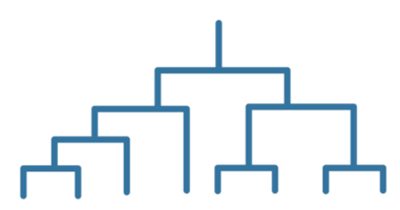

| 回归树 |  |

回归的决策树与分类的决策树相似,但它们被修改为能够预测连续响应。 | fitrtree |

成长决策树(文档) 拟合回归树机器学习模型(代码示例) |

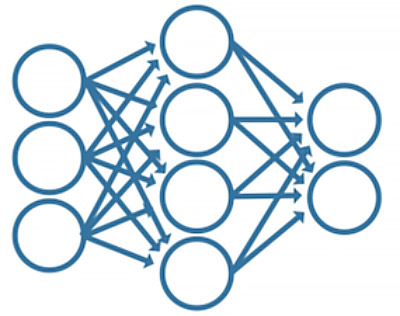

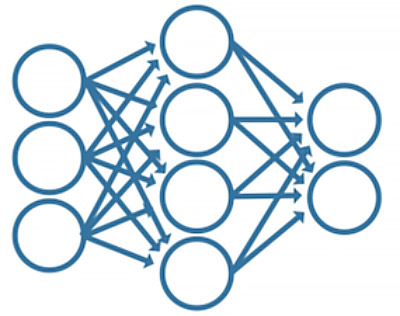

神经网络 (浅) |

|

受人脑启发,神经网络由高度连接的神经元网络组成,这些神经元将输入与期望的输出联系起来。通过迭代修改连接的强度来训练网络,以便训练输入映射到训练响应。 | fitrnet |

神经网络结构(文档) 拟合神经网络机器学习模型(代码示例) |

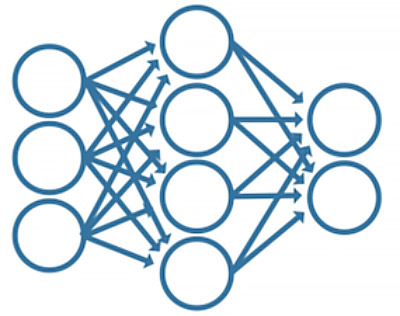

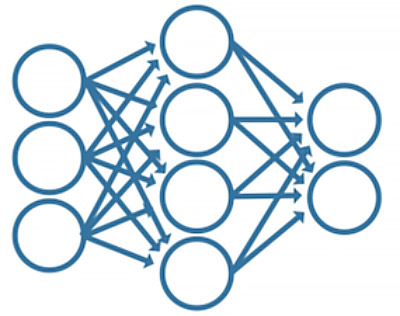

| 神经网络(深) |  |

深度神经网络比浅层神经网络有更多的隐藏层,有些情况下有数百个隐藏层。深度神经网络可以配置为通过在网络末端放置回归输出层来解决回归问题。 | trainNetwork |

MATLAB中的深度学习(文档) 拟合深度神经网络用于回归(代码示例) |

| 回归树集合体 |  |

在集成方法中,将几个“较弱”的回归树组合成一个“较强”的集成。最终模型使用来自“较弱”回归树的预测组合来计算最终预测。 | fitrensemble |

整体算法(文档) 拟合回归树集成机器学习模型(代码示例) |

流行的分类机器学习模型

| 模型 | 图像 | 它是如何工作的 | MATLAB函数 | 进一步的阅读 |

|---|---|---|---|---|

| 对数几率回归 |  |

逻辑回归是一种可以预测二元响应属于一类或另一类的概率的模型。由于其简单性,逻辑回归通常被用作二元分类问题的起点。 | 菲特格姆 |

广义线性模型(文档) 拟合Logistic回归机器学习模型(代码示例) |

| 决策树 |  |

决策树允许您通过从根(开始)到叶节点跟踪树中的决策来预测对数据的响应。树由分支条件组成,其中预测器的值与训练的权重进行比较。分支的数量和权值是在训练过程中确定的。额外的修改,或修剪,可以用来简化模型。 | fitctree |

成长决策树(文档) 拟合决策树机器学习模型(代码示例) |

| k最近邻(kNN) |  |

kNN是一种机器学习模型,它根据数据集中对象最近邻的类别对对象进行分类。kNN预测假设彼此靠近的物体是相似的。距离度量,如欧几里德、城市块、余弦和切比雪夫,用于查找最近邻。 | 菲茨康 |

基于最近邻的分类(文档) 拟合k最近邻机器学习模型(代码示例) |

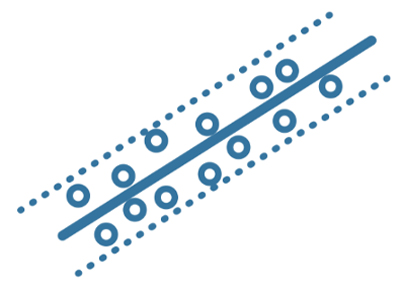

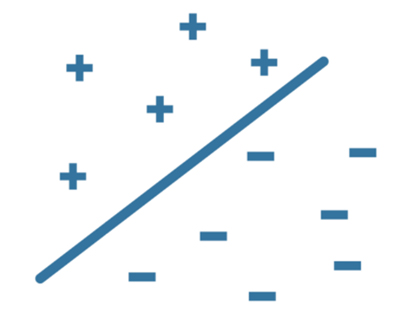

| 万博1manbetx支持向量机 |  |

SVM通过寻找线性决策边界(超平面)对数据进行分类,该边界将一类的所有数据点与另一类的所有数据点分开。当数据是线性可分离的时,支持向量机的最佳超平面是两类之间具有最大裕度的超平面。如果数据不是线性可分的,则使用损失函数惩罚超平面错误一侧的点。支持向量机有时使用核变换将非线性可分离数据转换为更高维,在高维中可以找到线性决策边界。 | fitcsvm |

拟合支持向量机机器学习模型(代码示例) |

| 神经网络(浅) |  |

受人类大脑的启发,神经网络由高度连接的神经元网络组成,将输入与期望的输出联系起来。机器学习模型通过迭代修改连接的强度来训练,以便给定的输入映射到正确的响应。在神经网络的输入层和输出层之间的神经元被称为“隐藏层”。浅神经网络通常有一到两个隐藏层。 | 菲茨内特 |

神经网络结构(文档) 一种浅层神经网络机器学习模型的拟合(代码示例) |

| 神经网络(深) |  |

深度神经网络比浅层神经网络有更多的隐藏层,有些情况下有数百个隐藏层。通过在网络末端放置分类输出层,可以配置深度神经网络来解决分类问题。许多人预先训练过深度学习模型分类是公开可用的任务,例如图像识别. | trainNetwork |

MATLAB中的深度学习(文档) 深度神经网络分类模型的拟合(代码示例) |

| 袋装和增强决策树 |  |

在这些集成方法中,几个“较弱”的决策树被组合成一个“较强”的集成。 袋装决策树由根据输入数据引导的数据独立训练的树组成。 助推包括通过反复添加“弱”学习者,并调整每个“弱”学习者的权重,以集中于错误分类的例子,从而创建一个强大的学习者。 |

菲特森布尔 |

整体算法(文档) 拟合增强决策树集成(代码示例) |

| 朴素贝叶斯 |  |

朴素贝叶斯分类器假设一个类中某个特定特征的存在与任何其他特征的存在无关。它根据新数据属于特定类别的最高概率对其进行分类。 | fitcnb |

朴素贝叶斯分类(文档) 拟合朴素贝叶斯机器学习模型(代码示例) |

| 判别分析集成 |  |

判别分析通过寻找特征的线性组合对数据进行分类。判别分析假设不同的类根据高斯分布生成数据。训练判别分析模型包括为每一类寻找高斯分布的参数。分布参数用于计算边界,边界可以是线性或二次函数。这些边界用于确定新数据的类别。 | fitcdiscr |

建立判别分析模型(文档) 一种判别分析机器学习模型的拟合(代码示例) |