基于并行计算的车道保持辅助训练DQN代理

此示例显示如何使用并行培训在Simulink®中为车道保持辅助(LKA)培训深度Q学习网络(DQN)代理。有关如何在不使用并行培训的情况下培训代理的示例,请参阅万博1manbetx为车道保持辅助培训DQN代理.

有关DQN代理的更多信息,请参阅深度Q网络代理。有关在MATLAB®中培训DQN代理的示例,请参阅培训DQN代理以平衡大车杆系统.

DQN并行训练概述

在DQN代理中,每个工作人员从其代理副本和环境中生成新的体验。以后N步骤中,工作人员将经验发送给客户机代理(与启动培训的MATLAB®过程相关联的代理)。客户机代理更新其参数如下。

对于异步培训,客户端代理从接收到的经验中学习,而无需等待所有工作人员发送经验,并将更新的参数发送回提供经验的工作人员。然后,工作人员继续使用更新的参数从其环境中生成经验。

对于同步培训,客户机代理等待从所有工人那里获得经验,并从这些经验中学习。然后,客户机将更新的参数同时发送给所有工人。然后,所有工作人员继续使用更新的参数生成体验。

有关同步与异步并行化的更多信息,请参见使用并行计算和GPU训练代理.

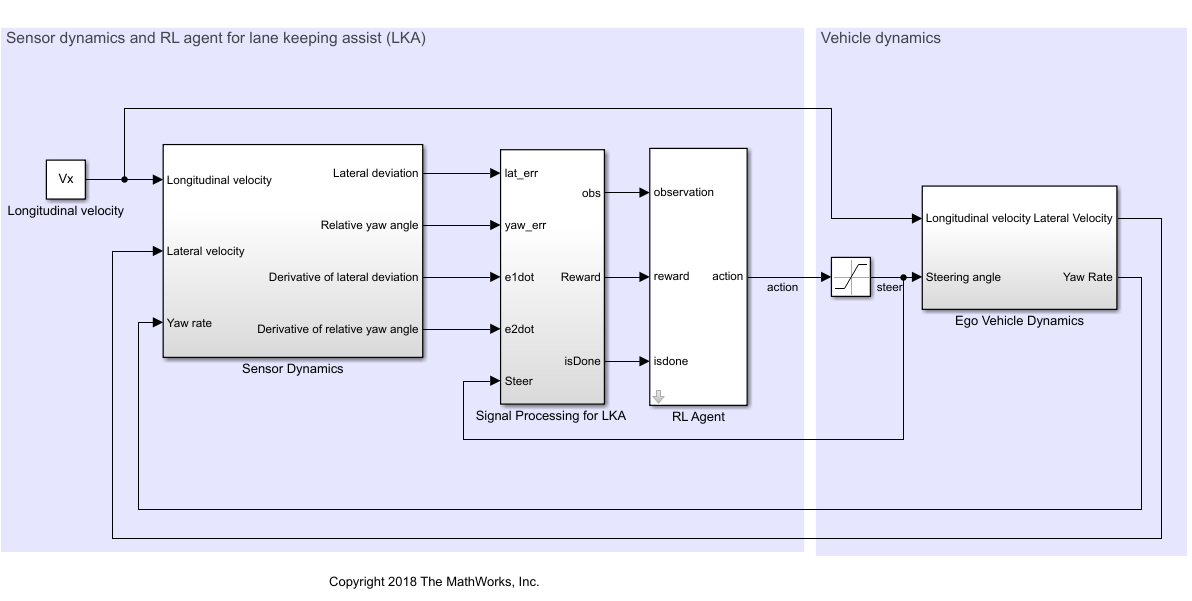

万博1manbetx汽车的Simulink模型

本例中的强化学习环境是一个用于自我车辆动力学的简单自行车模型。培训目标是通过调整前转向角,使ego车辆沿车道中心线行驶。此示例使用与相同的车型为车道保持辅助培训DQN代理.

m=1575;%车辆总质量(kg)Iz=2875;%偏航惯性矩(mNs^2)lf=1.2;%重心到前轮胎的纵向距离(m)lr=1.6;%重心到后轮胎的纵向距离(m)Cf=19000;%前轮胎的转弯刚度(N/rad)Cr=33000;%后轮胎的转弯刚度(N/rad)Vx=15;%纵向速度(m/s)

定义采样时间Ts和模拟持续时间T几秒钟之内。

Ts=0.1;T=15;

LKA系统的输出是ego汽车的前转向角。要模拟ego汽车的物理转向限制,请将转向角限制在范围内[–0.5,0.5]拉德。

u_min=-0.5;u_max=0.5;

道路的曲率由常数0.001定义(

).横向偏差的初始值为0.2m,相对偏航角的初始值为–0.1拉德。

rho=0.001;e1_初始值=0.2;e2_初始值=-0.1;

打开模型。

mdl=“rlLKAMdl”;开放式系统(mdl)代理LK=[mdl“/RL代理”];

对于此型号:

从agent到环境的转向角动作信号为–15度到15度。

从环境中观察到的是横向偏差 ,相对偏航角 ,它们的衍生物 和 ,以及它们的积分 和 .

当出现横向偏差时,模拟终止

奖赏 ,在每个时间步提供 是

哪里 是来自上一时间步的控制输入 .

创建环境接口

为ego车辆创建强化学习环境界面。

定义观测信息。

observationInfo=rlNumericSpec([6 1],“LowerLimit”,-inf*one(6,1),“上限”,inf*one(6,1));observationInfo.Name=“观察”; 观测信息描述=“关于横向偏差和相对偏航角的信息”;

定义操作信息。

actionInfo=rlFiniteSetSpec(-15:15)*pi/180);actionInfo.Name=“转向”;

创建环境接口。

env=rlSi万博1manbetxmulinkEnv(mdl、agentblk、observationInfo、actionInfo);

该界面有一个离散的动作空间,在该空间中,代理可以应用-15度到15度之间的31个可能转向角中的一个。观测是包含横向偏差、相对偏航角及其对时间的导数和积分的六维向量。

要定义横向偏差和相对偏航角的初始条件,请使用匿名函数句柄指定环境重置函数。本地重置FCN,将初始横向偏差和相对偏航角随机化。

env.ResetFcn=@(in)localResetFcn(in);

修复随机生成器种子以获得再现性。

rng(0)

创建DQN代理

DQN代理可以使用多输出Q值批评近似器,通常效率更高。多输出近似器将观察值作为输入,将状态动作值作为输出。每个输出元素表示从观察值指示的状态采取相应离散动作的预期累积长期报酬投入。

要创建批评家,首先创建一个包含一个输入(六维观察状态)和一个包含31个元素(均匀分布的转向角为-15到15度)的输出向量的深度神经网络。有关创建深度神经网络值函数表示的更多信息,请参阅创建策略和值函数表示.

nI=观测信息尺寸(1);%输入数量(6)nL=120;%神经元数目否=numel(actionInfo.Elements);%产出数量(31)dnn=[featureInputLayer(nI,“正常化”,“没有”,“姓名”,“国家”)完全连接层(nL,“姓名”,“fc1”)雷卢耶(“姓名”,“relu1”)完全连接层(nL,“姓名”,“fc2”)雷卢耶(“姓名”,“relu2”)完全连接层(编号:,“姓名”,“fc3”)];

查看网络配置。

图形绘图(图层图(dnn))

使用指定批评家表示的选项rlRepresentationOptions.

临界点=rlRepresentationOptions(“LearnRate”,1e-4,“梯度阈值”1.“L2调节因子”,1e-4);

使用指定的深度神经网络和选项创建批评家表示。还必须指定批评家的操作和观察信息,这些信息是从环境界面获得的。有关更多信息,请参阅rlQValueRepresentation.

批评家=rlQValueRepresentation(dnn、observationInfo、actionInfo、,“观察”,{“国家”},批评);

要创建DQN代理,请首先使用指定DQN代理选项rlDQNAgentOptions.

agentOpts=rlDQNAgentOptions(...“采样时间”,Ts,...“UsedDoubledQn”符合事实的...“目标平滑因子”,1e-3,...“折扣演员”,0.99,...“经验缓冲长度”,1e6,...“MiniBatchSize”,256); agentOpts.epsilongreedexploration.EpsilonDecay=1e-4;

然后使用指定的批评家表示和代理选项创建DQN代理。有关更多信息,请参阅rlDQNAgent.

代理=rlDQNAgent(评论家、代理);

培训方案

要培训代理,请首先指定培训选项。对于本例,请使用以下选项。

每次训练最多进行一次

10000每集,每集最多持续一次ceil(T/Ts)时间步长。仅在“事件管理器”对话框中显示培训进度(设置

阴谋和冗长的相应的选项)。当情节奖励达到时停止训练

-1.为累积奖励大于100的每集保存一份代理副本。

有关详细信息,请参阅RL培训选项.

最大事件数=10000;最大步骤数=ceil(T/Ts);训练选项数=RL训练选项(...“最大集”,每集,...“MaxStepsPerEpisode”,maxsteps,...“冗长”错误的...“情节”,“培训进度”,...“停止培训标准”,“情节报酬”,...“停止训练值”, -1,...“SaveAgentCriteria”,“情节报酬”,...“SaveAgentValue”,100);

并行培训选项

要并行培训代理,请指定以下培训选项。

设定

使用并行选择符合事实的.通过设置

ParallelizationOptions.Mode选择“异步”.每30个步骤后,每个工作人员都会向客户发送体验。

DQN代理要求工人发送“

经验”给客户。

trainOpts.usepallel=true;trainOpts.ParallelizationOptions.Mode=“异步”; trainOpts.ParallelizationOptions.DataToSendFromWorkers=“经验”; trainOpts.ParallelizationOptions.StepsUntilDataIsSent=32;

有关详细信息,请参阅RL培训选项.

列车员

使用火车作用训练代理是一个计算密集型过程,需要几分钟才能完成。要在运行此示例时节省时间,请通过设置溺爱到错误的. 要亲自训练特工,设置溺爱到符合事实的.由于平行培训的随机性,您可以从下图中看到不同的培训结果。下图显示了四名工人的培训结果。

doTraining=false;如果溺爱%培训代理人。trainingStats=列车(代理人、环境、列车员);其他的%为示例加载预训练代理。装载(“万博1manbetxSimulinkLKADQNParallel.mat”,“代理人”)终止

模拟DQN代理

要验证经过培训的代理的性能,请取消注释以下两行并在环境中模拟代理。有关代理模拟的更多信息,请参阅模拟选项和模拟.

%simOptions=rlSimulationOptions('MaxSteps',MaxSteps);%经验=模拟(环境、代理、模拟选项);

要使用确定性初始条件演示经过训练的agent,请在Simulink中模拟该模型。万博1manbetx

e1_初始值=-0.4;e2_初始值=0.2;sim(mdl)

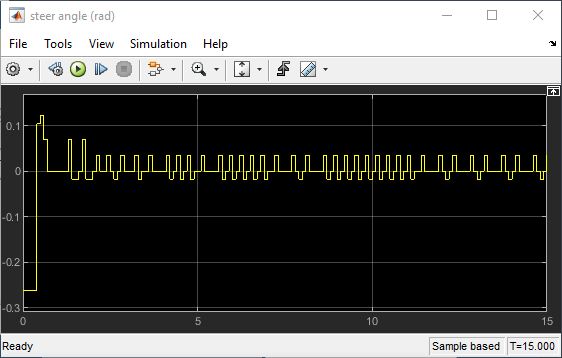

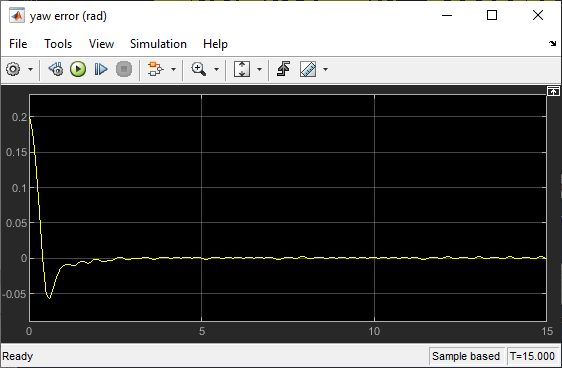

如下图所示,横向误差(中间图)和相对偏航角(底部图)均被驱动至零。车辆从偏离中心线(–0.4 m)和非零偏航角误差(0.2 rad)开始。LKA使ego车辆能够在2.5秒后沿中心线行驶。转向角(上图)显示控制器在2秒后达到稳定状态。

局部函数

作用in=localResetFcn(in)%重置in=设置变量(in,“e1_首字母”,0.5*(-1+2*兰德));%横向偏差的随机值in=设置变量(in,“e2_首字母”,0.1*(-1+2*兰德));%相对偏航角的随机值终止