光谱描述符

Audio Toolbox™提供了一套描述形状的函数,有时称为音质此示例定义了用于确定光谱特征的方程式,引用了每个特征的常用用法,并提供了示例,以便您能够直观了解光谱描述符所描述的内容。

光谱描述符广泛应用于机器和深度学习应用以及感知分析。光谱描述符已应用于一系列应用,包括:

光谱质心

哪里

是对应于bin的频率,单位为Hz .

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱质心的带边(以箱为单位)。

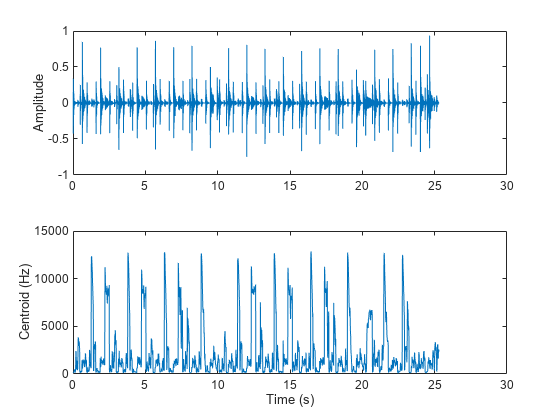

光谱质心表示光谱的“重心”。它用于指示亮度[2]通常用于音乐分析和流派分类。例如,观察与音频文件中的高帽子点击相对应的质心跳跃。

[音频,fs]=音频读取(“FunkyDrums-44p1-stereo-25秒mp3”);audio=sum(audio,2)/2;质心=spectralCentroid(audio,fs);子地块(2,1,1)t=linspace(0,size(audio,1)/fs,size(audio,1));绘图(t,audio)ylabel(“振幅”)子地块(2,1,2)t=linspace(0,大小(音频,1)/fs,大小(质心,1));地块(t,质心)xlabel(‘时间’)伊拉贝尔(‘质心(Hz)’)

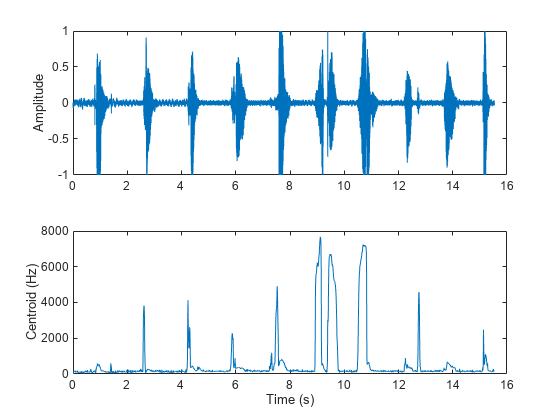

频谱质心也常用于将语音分类为浊音或清音[3.]。例如,质心在清音语音区域跳跃。

[音频,fs]=音频读取(“Counting-16-44p1-mono-15secs.wav”); 质心=频谱质心(音频,fs);子图(2,1,1)t=linspace(0,大小(音频,1)/fs,大小(音频,1));绘图(t,音频)标签(“振幅”)子地块(2,1,2)t=linspace(0,大小(音频,1)/fs,大小(质心,1));地块(t,质心)xlabel(‘时间’)伊拉贝尔(‘质心(Hz)’)

频谱扩展

哪里

是对应于bin的频率,单位为Hz .

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱扩展的带边(以箱为单位)。

是光谱的质心。

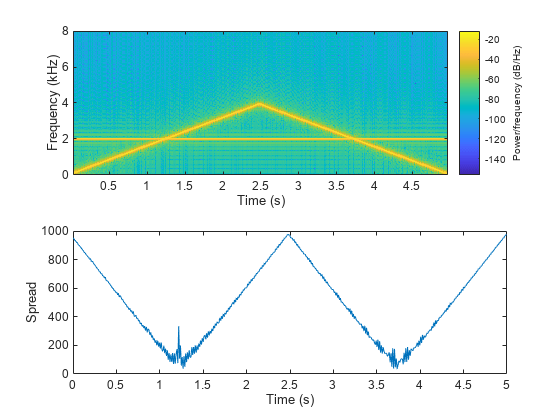

频谱扩展表示频谱的“瞬时带宽”。它用于指示音调的优势。例如,扩展随着音调的发散而增加,随着音调的收敛而减小。

fs=16e3;音调=音频振荡器(“采样器”,财政司司长,“NumTones”2.“样品性能框架”,512,“频率”,[2000,100]); 持续时间=5;numLoops=地板(持续时间*fs/tone.SamplesPerFrame);信号=[];对于i=1:numLoops信号=[信号;音调()];如果i其他的音调频率=音调频率-[0,50];终止终止传播= spectralSpread(信号、fs);次要情节(2,1,1)谱图(信号,圆(fs * 0.05),圆(fs * 0.04), 2048年,fs,“亚克斯”)子地块(2,1,2)t=linspace(0,大小(信号,1)/fs,大小(排列,1));地块(t,排列)xlabel(‘时间’)伊拉贝尔(“蔓延”)

光谱偏度

哪里

是对应于bin的频率,单位为Hz .

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱偏度的带边(以箱为单位)。

是光谱的质心。

是频谱扩展。

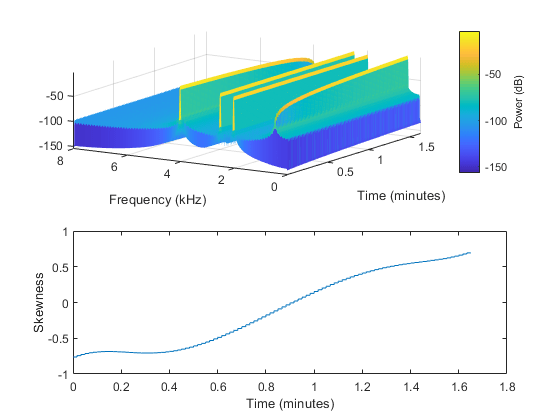

光谱偏斜测量质心周围的对称性。在语音学中,光谱偏斜通常被称为光谱倾斜与其他谱矩一起使用,以区分关节的位置[4]。对于谐波信号,它表示高次谐波和低次谐波的相对强度。例如,在四音信号中,当低音占主导地位时,存在正偏斜,当高音占主导地位时,存在负偏斜。

fs=16e3;持续时间=99;音调=音频振荡器(“采样器”,财政司司长,“NumTones”4.“样品性能框架”,财政司司长,“频率”,[500,2000,2500,4000],“振幅”,[0,0.4,0.6,1]); 信号=[];对于i=1:持续时间信号=[信号;音调()];音调.振幅=音调.振幅+[0.01,0,0,-0.01];终止偏斜度=光谱偏斜度(信号,fs);t=linspace(0,大小(信号,1)/fs,大小(偏斜度,1))/60;子批次(2,1,1)光谱图(信号,圆形(fs*0.05),圆形(fs*0.04),圆形(fs*0.05),fs,“亚克斯”,“权力”)视图([-58 33])子地块(2,1,2)绘图(t,偏斜)xlabel(‘时间(分钟)’)伊拉贝尔(“偏斜”)

光谱峰度

光谱峰度(spectralKurtosis)由四阶矩计算[1]:

哪里

是对应于bin的频率,单位为Hz .

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱峰度的带边(以箱为单位)。

是光谱的质心。

是频谱扩展。

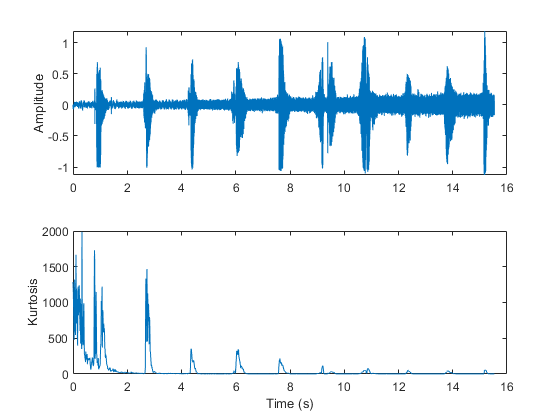

频谱峰度测量围绕其质心的频谱的平坦度或非高斯性。相反,它用于指示频谱的峰值。例如,当语音信号上的白噪声增加时,峰度降低,表明峰值频谱变小。

[audioIn,fs]=音频读取(“Counting-16-44p1-mono-15secs.wav”);noiseGenerator = dsp。ColoredNoise (“颜色”,“白色”,“样品性能框架”,size(audioIn,1));noise=noiseGenerator();noise=noise/max(abs(noise));ramp=linspace(0.25,numel(noise));noise=noise.*ramp;audioIn=audioIn+noise;峰度=spectralKurtosis(audioIn,fs);t=linspace(0,size(audioIn,1)/fs,size(audioIn,1));子批次(2,1,1)plot(t,audioIn)ylabel(“振幅”)t=邻域(0,尺寸(音频,1)/fs,大小(峰度,1));子批次(2,1,2)绘图(t,峰度)xlabel(‘时间’)伊拉贝尔(“峰度”)

谱熵

哪里

是对应于bin的频率,单位为Hz .

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是带边,在箱子里,在上面计算光谱熵。

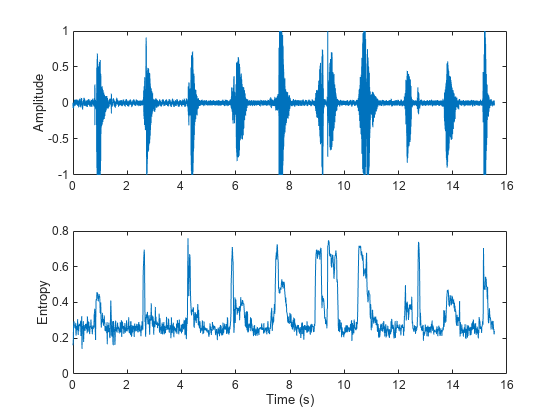

谱熵已成功地应用于语音识别中的浊音/清音判决[6].因为熵是一种无序度的度量,所以浊音语音区域的熵比浊音语音区域的熵要小。

[audioIn,fs]=音频读取(“Counting-16-44p1-mono-15secs.wav”);熵=光谱特性(audioIn,fs);t=linspace(0,大小(audioIn,1)/fs,大小(audioIn,1));子批次(2,1,1)绘图(t,audioIn)ylabel(“振幅”)t=linspace(0,大小(audioIn,1)/fs,大小(熵,1));子地块(2,1,2)绘图(t,熵)xlabel(‘时间’)伊拉贝尔(“熵”)

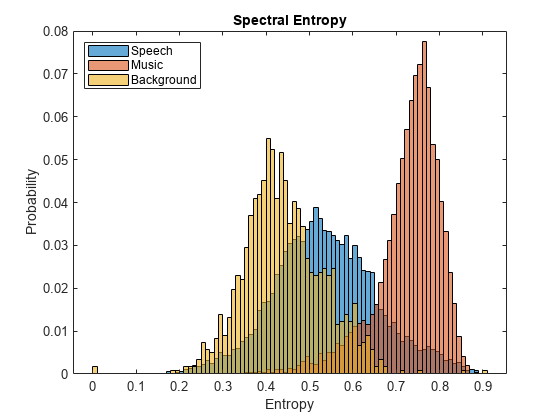

光谱熵也被用来区分语音和音乐[7] [8]。例如,比较语音、音乐和背景音频文件的熵直方图。

fs = 8000;[演讲,speechFs] = audioread (“彩虹-16-8-mono-114s.wav”);语音=重采样(语音,fs,speechFs);语音=语音。/max(语音);[音乐,音乐]=音频读取(“摇滚吉他-16-96-立体声-72秒flac”);music=sum(music,2)/2;music=resample(music,fs,musicFs);music=music./max(music);[background,backgroundFs]=audioread(“环境-16-44p1-mono-12秒波形”);背景=重新取样(背景、fs、backgroundFs);背景= background. / max(背景);speechEntropy = spectralEntropy(演讲、fs);musicEntropy = spectralEntropy(音乐、fs);backgroundEntropy = spectralEntropy(背景、fs);图h1 =直方图(speechEntropy);持有在…上h2=直方图(MusicCentropy);h3=直方图(背景熵);h1.归一化=“概率”;h2.正常化=“概率”;h3.正常化=“概率”;h1.BinWidth=0.01;h2.BinWidth=0.01;h3.BinWidth=0.01;标题(“光谱熵”)传奇(“演讲”,“音乐”,“背景”,“位置”,“西北”)xlabel(“熵”)伊拉贝尔(“概率”)持有关

光谱平坦度

光谱平坦度(光谱平坦度)测量光谱几何平均值与光谱算术平均值的比率[9]:

哪里

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱平坦度的带边(以箱为单位)。

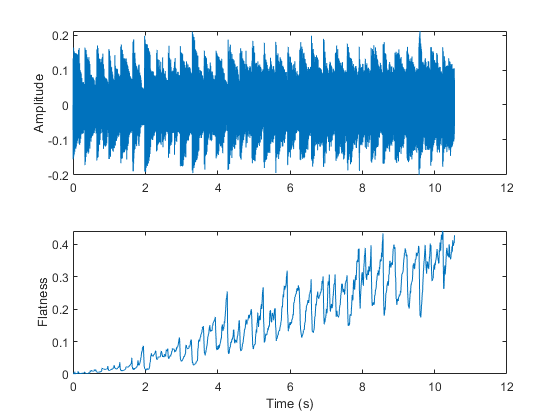

光谱平坦度表示光谱的峰值。较高的光谱平坦度表示噪声,较低的光谱平坦度表示音调。

[音频,fs]=音频读取(“波导环通-24-96-立体声-10秒aif”);音频= sum(音频、2)/ 2;噪音=(2 *兰特(元素个数(音频),1)1)。* linspace(0、0.05、元素个数(音频))';音频=音频+噪声;平面度= spectralFlatness(音频、fs);Subplot (2,1,1) t = linspace(0,size(audio,1)/fs,size(audio,1));情节(t)、音频)ylabel (“振幅”)子地块(2,1,2)t=linspace(0,大小(音频,1)/fs,大小(平坦度,1));绘图(t,平坦度)ylabel(“平坦”)xlabel(‘时间’)

谱平坦度也被成功地应用于歌声检测[10]和音频场景识别[11].

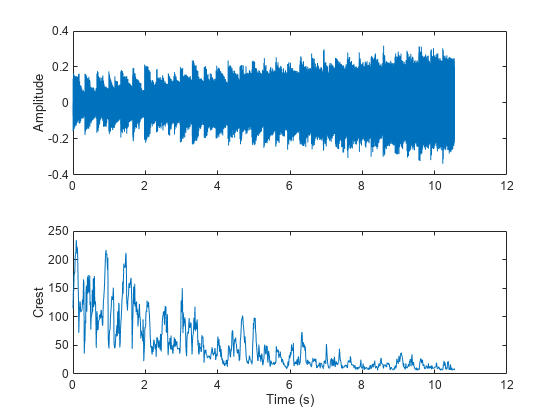

波峰

波峰(光谱休息)测量光谱最大值与光谱算术平均值的比率[1]:

哪里

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是用于计算光谱波峰的带边(以箱为单位)。

光谱波峰表示光谱的峰值。较高的光谱波峰表示更多的音调,而较低的光谱波峰表示更多的噪声。

[音频,fs]=音频读取(“波导环通-24-96-立体声-10秒aif”);audio=sum(audio,2)/2;noise=(2*rand(numel(audio,1)-1)。*linspace(0,0.2,numel(audio));audio=audio+noise;crest=spectralCrest(audio,fs);subplot(2,1,1)t=linspace(0,size(audio,1)/fs,size(audio,1));plot(t,audio)ylabel(“振幅”)子地块(2,1,2)t=linspace(0,大小(音频,1)/fs,大小(波峰,1));地块(t、坝顶)ylabel(“佳洁士”)xlabel(‘时间’)

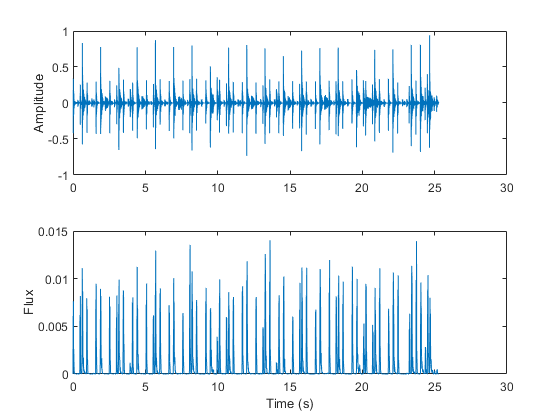

谱通量

哪里

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是波段边缘,在箱子里,在上面计算光谱通量。

是标准类型。

光谱通量广泛应用于起始检测[13]音频和音频分割[14].例如,鼓声轨道中的节拍对应着高光谱通量。

[音频,fs]=音频读取(“FunkyDrums-48立体声-25秒mp3”);音频= sum(音频、2)/ 2;通量= spectralFlux(音频、fs);Subplot (2,1,1) t = linspace(0,size(audio,1)/fs,size(audio,1));情节(t)、音频)ylabel (“振幅”)子地块(2,1,2)t=linspace(0,大小(音频,1)/fs,大小(流量,1));plot(t,流量)ylabel(“通量”)xlabel(‘时间’)

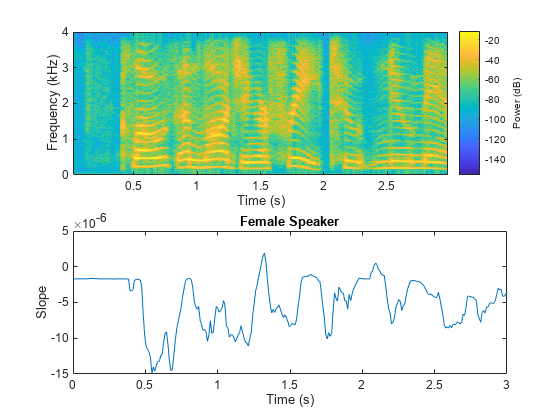

光谱斜率

光谱斜率(spectralSlope)测量光谱的减少量[15]:

哪里

是对应于bin的频率,单位为Hz .

为平均频率。

光谱值在bin处吗 。通常使用震级谱。

是平均光谱值。

和 是波段边缘,在箱子里,在上面计算光谱斜率。

频谱斜率在语音分析中得到了广泛的应用,特别是在说话人压力建模中[19]斜率与声带的共振特性直接相关,也被用于说话人识别[21].谱斜率是音色的一个重要方面。光谱斜率辨别已被证明发生在儿童早期发育中[20].当较低共振峰的能量远大于较高共振峰的能量时,谱斜率最为明显。

[女性,女性]=音频阅读(“FemaleSpeech-16-8-mono-3secs.wav”);雌鸟=雌鸟。/max(雌鸟);雌鸟坡度=光谱坡度(雌鸟,雌鸟);t=linspace(0,大小(雌鸟,1)/femaleFs,大小(雌鸟坡度,1));子批次(2,1,1)光谱图(雌鸟,圆形(雌鸟坡度*0.05),圆形(雌鸟坡度*0.04),圆形(雌鸟坡度*0.05),雌鸟坡度,“亚克斯”,“权力”)子地块(2,1,2)地块(t,femaleSlope)标题(“女发言人”)伊拉贝尔(“坡”)xlabel(‘时间’)

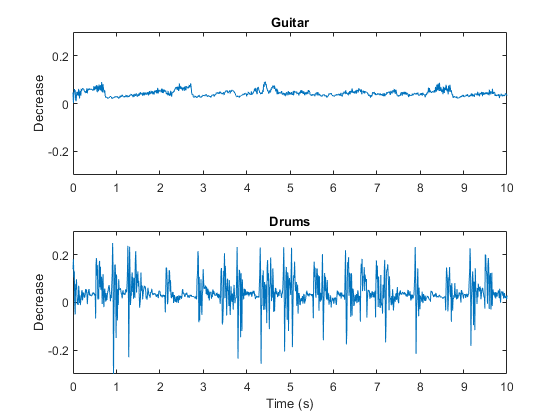

光谱减少

光谱衰减(光谱减退)表示频谱的减少量,同时强调较低频率的斜率[1]:

哪里

光谱值在bin处吗 。通常使用震级谱。

和 是用于计算光谱衰减的带边(以箱为单位)。

在语音文献中,谱衰减的使用频率低于谱斜率,但在音乐分析中,谱衰减与斜率一起被广泛使用。特别是,谱衰减已被证明是乐器识别中的一个特征[22].

[吉他,吉他]=有声读物(“rockguitar - 16 - 44 - p1 -立体声- 72 secs.wav”);吉他=平均(吉他,2);[鼓,鼓]=有声读物(“摇滚鼓-44p1-立体声-11秒mp3”)鼓=平均数(鼓,2);吉他减量=谱减量(鼓,鼓),鼓减量=谱减量(鼓,鼓);t1=林空间(0,大小(吉他,1)/吉他减量,大小(吉他减量,1));t2=林空间(0,大小(鼓,1)/鼓,大小(鼓减量,1));子地块(2,1,1)绘图(t1,吉他减量)标题(“吉他”)伊拉贝尔(“减少”)轴([0.10-0.3 0.3])子地块(2,1,2)图(t2,drumsDecrease)标题(“鼓”)伊拉贝尔(“减少”)xlabel(‘时间’)轴([010-0.30.3])

光谱衰减点

光谱衰减点(光谱衰减点)通过确定总能量的给定百分比所处的频率区间来测量音频信号的带宽[12]:

哪里

光谱值在bin处吗 .震级谱和功率谱都是常用的。

和 是在箱子里的波段边缘,在上面计算光谱滚动点。

是指定的能量阈值,通常为95%或85%。

在它被返回之前被转换为Hz光谱衰减点.

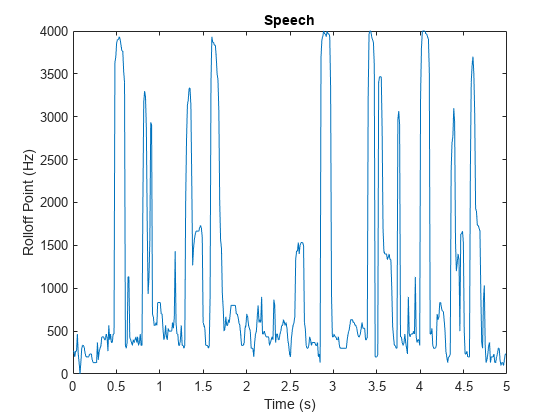

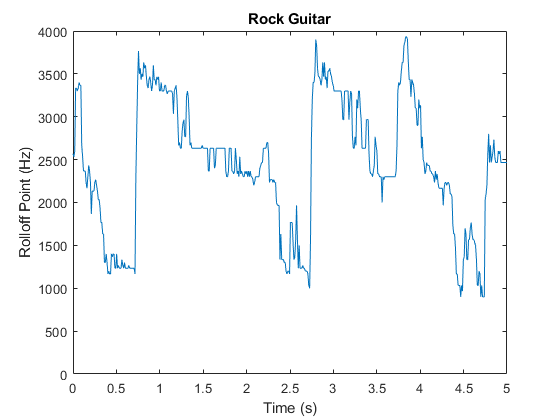

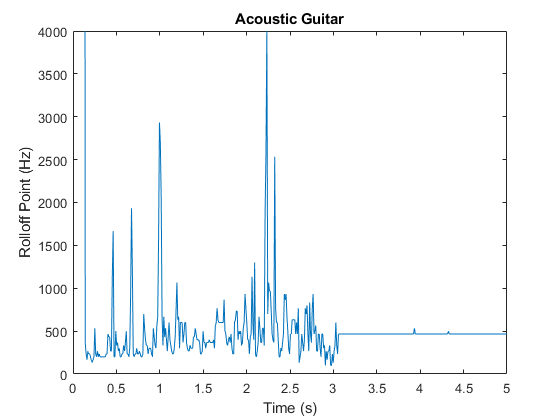

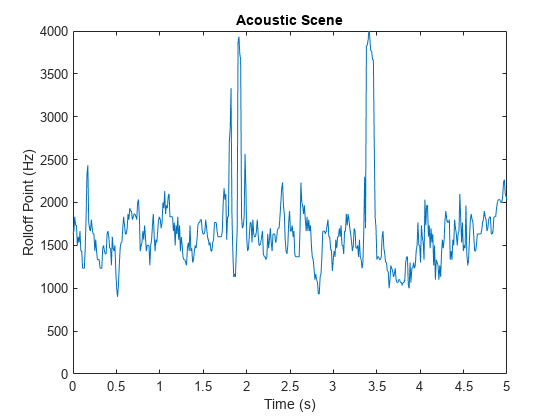

频谱衰减点已用于区分浊音和清音语音、语音/音乐辨别[12],音乐流派分类[16],声场景识别[17],以及音乐情绪分类[18].例如,观察语音、摇滚吉他、原声吉他和原声场景的滚动点的不同均值和方差。

dur=5;%从每个文件中剪下5秒钟。[演讲,fs1] = audioread (“SpeechDFT-16-8-mono-5秒波形”);演讲=演讲(1:min(结束,fs1 *大调的));[electricGuitar, fs2] = audioread (“rockguitar - 16 - 44 - p1 -立体声- 72 secs.wav”);电吉他=平均值(电吉他,2);%转换为mono进行比较。电吉他=电吉他(1:fs2*dur);[声学吉他,fs3]=音频阅读(“软吉他-44p1_单声道-10min.ogg”);acousticGuitar = acousticGuitar (1: fs3 *大调的);[acousticScene, fs4] = audioread (“主高音-16-16-mono-12秒波形”);acousticScene = acousticScene (1: fs4 *大调的);r1 = spectralRolloffPoint(演讲、fs1);r2 = spectralRolloffPoint (electricGuitar fs2);r3 = spectralRolloffPoint (acousticGuitar fs3);r4 = spectralRolloffPoint (acousticScene fs4);t1 = linspace(0,大小(演讲,1)/ fs1、大小(r1, 1));t2 = linspace (0, (electricGuitar 1) / fs2大小,大小(r2, 1));t3 = linspace (0, (acousticGuitar 1) / fs3大小,大小(r3, 1));t4 = linspace (0, (acousticScene 1) / fs4大小,大小(r4, 1)); figure plot(t1,r1) title(“演讲”)伊拉贝尔(“滚动点(Hz)”)xlabel(‘时间’)轴([0504000])

图表(t2、r2)标题(“摇滚吉他”)伊拉贝尔(“滚动点(Hz)”)xlabel(‘时间’)轴([0504000])

图-地块(t3、r3)标题(“原声吉他”)伊拉贝尔(“滚动点(Hz)”)xlabel(‘时间’)轴([0504000])

图绘制(t4、r4)标题(“声学场景”)伊拉贝尔(“滚动点(Hz)”)xlabel(‘时间’)轴([0504000])

工具书类

[1] Peeters,G.“CUIDADO项目中用于声音描述(相似性和分类)的大量音频特征”,技术报告;IRCAM:巴黎,法国,2004年。

格雷,约翰·M·戈登和约翰·w·戈登。《频谱变化对音乐音色的知觉效应》美国声学学会杂志。第63卷,第5期,1978年,第1493-1500页。

[3] 莱米、埃里克和查尔斯·凯恩斯。语音学和音韵学中的片段.John Wiley & Sons Inc., 2015。

[4] 英语擦音的声学特征美国声学学会杂志。第108卷,2000年第3期,第1252-1263页。

[5] Zhang,Y.Guo和Q.Zhang,“基于频谱峰度的鲁棒语音活动检测特征设计。”第一届教育技术和计算机科学国际讲习班,2009年,第269-272页。

[6] Misra,H.,S.Ikbal,H.Bourard和H.Hermansky.“稳健ASR的基于谱熵的特征。”2004年IEEE声学、语音和信号处理国际会议.

A. Pikrakis, T. Giannakopoulos和S. Theodoridis。一种计算效率高的无线电录音语音/音乐鉴别器。国际音乐信息检索及相关活动会议, 2006.

[8] 一种基于动态规划和贝叶斯网络的无线电录音语音/音乐鉴别器IEEE多媒体汇刊。2008年第5期,第10卷,第846-857页。

[9] 约翰斯顿,J.d.“使用感知噪声标准对音频信号进行变换编码。”IEEE通讯选定领域杂志。第6卷,第2期,1988,314-323页。

[10] Lehner, Bernhard等,《关于减少唱歌声音检测中的假阳性》2014年IEEE声学、语音和信号处理国际会议(ICASSP), 2014.

Y. Petetin, C. Laroche和A. Mayoue,《音频场景识别的深度神经网络》,2015年第23届欧洲信号处理会议(EUSIPCO),2015

[12] 稳健多特征语音/音乐鉴别器的构建和评估1997年IEEE声学、语音和信号处理国际会议,1997.

[13] S.Dixon,“重新审视发病检测。”国际数字音频效果会议。2006年第120卷,第133-137页。

[14] 用于浏览和注释的多功能音频分割1999年IEEE音频和声学信号处理应用研讨会论文集,1999

[15] 亚历山大·勒奇。音频内容分析在信号处理和音乐信息学中的应用简介新泽西州皮斯卡塔韦:IEEE出版社,2012年。

[16] 李涛和M.Ogihara,《音乐流派分类与分类学》,第一卷国际声学、语音和信号处理会议,2005.

Eronen, a.j., v.t. Peltonen, j.t. Tuomi, a.p. Klapuri, S. Fagerlund, T. Sorsa, G. Lorho, J. Huopaniemi。“以听力上下文识别。”IEEE音频、语音和语言处理交易。第14卷,2006年第1期,第321-329页。

[18] 任家敏、吴明菊和张成荣。“基于音色和调制特征的音乐情绪自动分类。”IEEE情感计算交易。第6卷,2015年第3期,第236-246页。

[19] 压力下的言语:分析、建模和识别计算机科学的课堂讲稿。2007年第4343卷,第108-137页。

[20] 婴儿期的光谱斜率辨别:对社会重要音色的敏感性婴儿行为和发育。第25卷,第2期,2002年,第183-194页。

[21]Murthy,H.a.,F.Beaufays,L.p.Heck和M.Weintraub.“电话信道上鲁棒的文本无关说话人识别。”关于语音和音频处理的IEEE交易。第7卷,第5期,1999年,第554-568页。

[22]Essid,S.,G.Richard和B.David,“基于自动分类的复调音乐中的乐器识别。”IEEE音频、语音和语言处理交易。2006年第14卷第1期,第68-80页。