高阶对象模型的简化

此示例演示如何使用鲁棒控制工具箱™ 用较简单的低阶模型近似高阶对象模型。

介绍

鲁棒控制工具箱提供了处理大型模型的工具,如:

高级工厂:工厂的详细第一原理或有限元模型往往具有较高的阶数。我们通常希望简化此类模型,以便进行模拟或控制设计。

高阶控制器:鲁棒控制技术通常产生高阶控制器。例如,当我们使用频率加权函数塑造开环响应时,这是常见的。我们希望简化此类控制器的实现。

为了控制目的,一般来说,在交叉频率附近有一个精确的模型就足够了。对于仿真而言,只要在激励信号的频率范围内捕捉到基本的动态就足够了。这意味着通常可以找到高阶模型的低阶近似。鲁棒控制工具箱提供了各种模型缩减算法,以最适合您的要求和您的模型特性。

模型简化过程

模型缩减任务通常包括以下步骤:

从模型的时域或频域响应中分析模型的重要特征

一步或预兆例如通过绘制原始模型的Hankel奇异值来确定适当的降阶(

汉克尔斯夫)来确定哪些模式(状态)可以在不牺牲关键特性的情况下丢弃。选择还原算法。工具箱中提供的一些还原方法有:

balancmr,bstmr,schurmr,汉克尔默和ncfmr

我们可以通过顶级接口轻松访问这些算法减少.这些方法采用不同的方法来衡量原始模型和简化模型之间的“亲密度”。选择取决于应用程序。让我们试一试,看看它们各自的优缺点。

验证:我们通过比较简化模型和原始模型的动态来验证我们的结果。如果结果不令人满意,我们可能需要调整我们的约简参数(模型顺序的选择,算法,误差边界等)。

例:建筑物刚体运动模型

在本例中,我们将简化方法应用于洛杉矶大学医院的建筑模型。该模型摘自SLICOT工作笔记2002-2,“线性时不变动力系统模型约简的基准示例集合”,由Y. Chahlaoui和P.V. Dooren编写。它有八层,每层有三个自由度——两个位移和一个旋转。我们使用48状态模型来表示这些位移的输入-输出关系,其中每个状态表示一个位移或其变化率(速度)。

让我们加载示例的数据:

负载buildingData.mat

检查植物动态

让我们从分析模型的频率响应开始:

博德(G)网格在…上

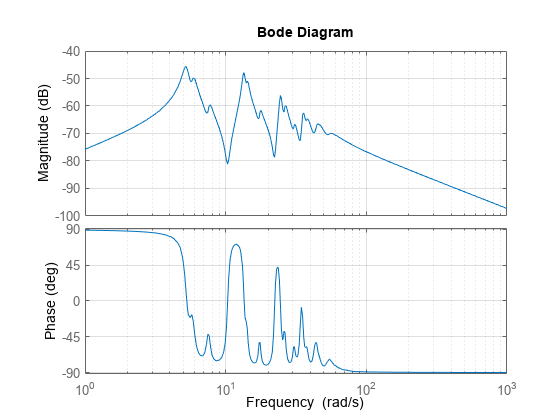

图1:分析频率响应的波特图

从模型的频率响应可以看出,系统的本质动力学是在3 - 50弧度/秒的频率范围内。震级在极低和高频范围都下降。我们的目标是找到一个低阶模型,在这个频率范围内保持一个可接受的精度水平的信息内容。

计算汉克尔奇异值

为了理解模型的哪些状态可以被安全丢弃,看看模型的Hankel奇异值:

hsv_add=汉克尔斯夫(G);酒吧(hsv_add)标题(“模型(G)的Hankel奇异值”); xlabel(“许多州”)伊拉贝尔('奇异值(\sigma_i)')行([10.5 10.5],[0 1.5e-3],“颜色”,“r”,“线条样式”,“——”,“线宽”,1)文本(6,1.6e-3,“10个主要国家。”)

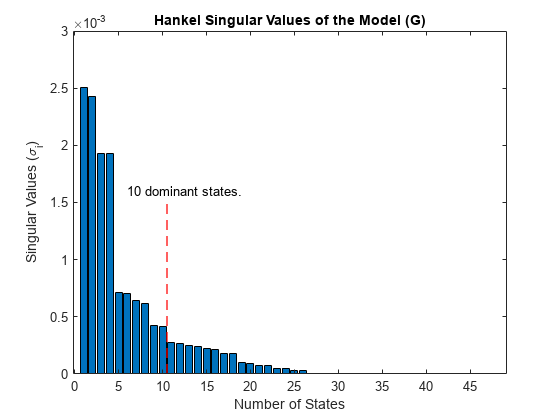

图2:模型的Hankel奇异值(G)。

Hankel奇异值图表明,在这个系统中有四个主导模式。但是,剩余模式的贡献仍然很大。我们将在10个状态下画一条线,并丢弃剩余的模式,以找到一个10阶简化模型Gr这最接近原始系统G.

使用附加误差界执行模型缩减

这个函数减少是工具箱中可用的所有模型简化例程的入口。我们将使用默认的平方根余额截断('balancmr')选项减少作为第一步,该方法使用“加法”误差界进行缩减,这意味着它试图在频率范围内保持绝对近似误差均匀较小。

%计算第10阶简化模型(默认情况下,简化使用balancmr方法)[Gr\U add,info\U add]=reduce(G,10);现在比较原始模型G和简化后的模型Gr_add博德(G,“b”Gr_add,“r”网格)在…上标题(“将原始模型(G)与简化模型(Gr\\ U add)进行比较”)传奇(“G - 48州原创”,“Gr\\ U添加-10状态减少”,“位置”,“东北”)

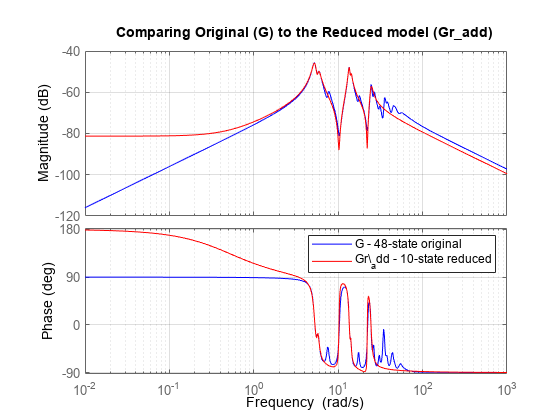

图3:将原始模型(G)与简化模型(Gr_-add)进行比较

使用乘法误差界执行模型缩减

如图3中的Bode图所示,简化模型很好地捕捉了30 rad/s以下的共振,但在低频区域(<2 rad/s)匹配较差。此外,简化模型不能完全捕获30-50 rad/s频率范围内的动态。低频率下较大误差的一个可能解释是这些频率下模型的增益相对较低。因此,即使这些频率下的较大误差对总体误差的贡献也很小。

为了解决这个问题,我们可以尝试乘法误差法,例如bstmr。此算法强调相对误差,而不是绝对误差。因为当增益接近零时,相对比较不起作用,所以我们需要添加最小增益阈值,例如,通过添加馈通增益D到我们原来的模型。假设我们不关心增益低于- 100db时的误差,我们可以将馈通设置为1e-5。

GG=G;GG.D=1e-5;

现在,让我们看看乘法(相对)误差的奇异值(使用汉克尔斯夫)

hsv_mult = hankelsv (GG,“骡子”);标题栏(hsv_mult) (“模型(G)的乘性误差奇异值”); xlabel(“许多州”)伊拉贝尔('奇异值(\sigma_i)')

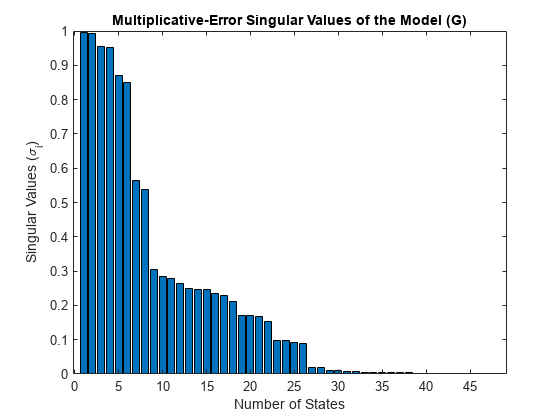

图4:模型的乘性误差奇异值(G)

26阶模型看起来很有希望,但为了与之前的结果进行比较,让我们坚持10阶降阶。

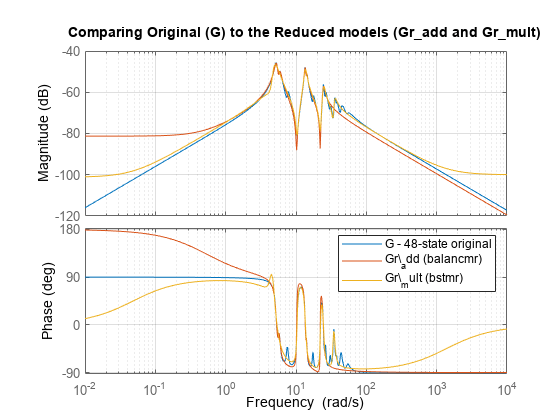

%使用bstmr算法选项进行模型简化[Gr_mult,info_mult]=reduce(GG,10,“算法”,“英国夏令时”);%现在比较原始模型G和简化模型Gr_multbode(G,Gr_add,Gr_mult,{1e-2,1e4}),网格在…上标题(“比较原始(G)和简化模型(Gr\_add和Gr\_mult)”)传奇(“G - 48州原创”,Gr \ _add (balancmr)”,Gr \ _mult (bstmr)”,“位置”,“东北”)

图5:将原始模型(G)与简化模型(Gr_add和Gr_mult)进行比较

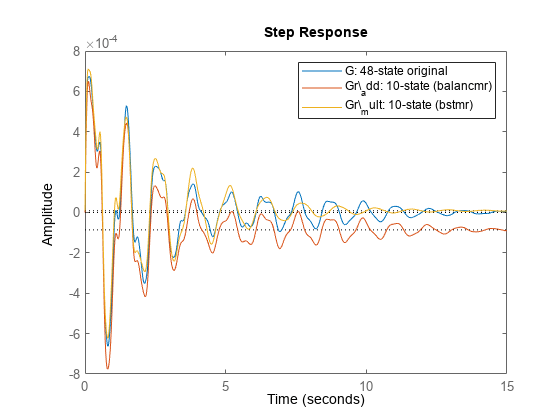

使用乘性误差方法,原始模型和简化模型之间的拟合更好,即使在低频情况下也是如此。我们可以通过比较阶跃响应来确认这一点:

步骤(G, Gr_add Gr_mult 15)%阶跃响应直到15秒传奇(“G:48州原文”,“Gr \ _add:十余个州(balancmr) ','Gr\\ mult:10状态(bstmr)')

图6:三种模型的阶跃响应

验证结果

所有的算法都提供近似误差的界限。对于加法错误方法balancmr时,近似误差由误差模型的峰值(最大)增益测量G-诱导在所有频率上。该峰值增益也称为误差模型的H无穷范数。加法误差算法的误差界如下所示:

其中,和等于G(第11至48项hsv_add).我们可以通过比较此不等式的两侧来验证此界是否满足:

标准(G-Gr_添加,inf)%实际误差

ans=6.0251e-04

%理论边界(存储在“INFO”的“ErrorBound”字段中)% struct return by |info_add。ERR或BoUND

ans=0.0047

对于乘法错误方法,例如bstmr近似误差由相对误差模型的频率峰值增益测量G\(G-减少)。错误界限如下所示

和在哪里乘法汉克尔奇异值的计算汉克尔斯夫(G,'mult').同样,我们可以比较简化模型的这些界限格鲁穆特

规范(GG \ (GG-Gr_mult)、正)%实际误差

ans=0.5949

%理论界信息多个错误绑定

ans = 473.2954

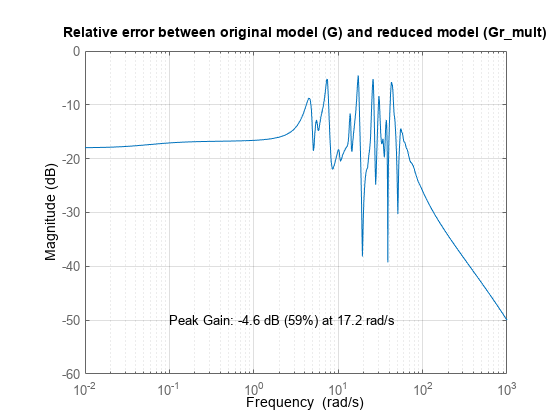

画出相对误差以作确认

bodemag(GG\(GG-Gr_mult),{1e-2,1e3})网格在…上文本(0.1,-50,峰值增益:-4.6 dB (59%), 17.2 rad/s)头衔(“原始模型(G)和简化模型(Gr\\\ mult)之间的相对误差”)

图7:原始模型(G)与简化模型(Gr_mult)的相对误差

从上面的相对误差图可以看出,在17.2 rad/s时,相对误差高达59%,这可能超出了我们的接受范围。

选择与所需精度级别兼容的最低订单

提高数据的准确性格鲁穆特,我们需要增加订单。要达到至少5%的相对精度,我们能得到的最低阶是多少?这个函数减少可以自动选择符合我们所需精度水平的最低阶模型。

%指定最大近似误差为5%[Gred,info]=reduce(GG,“错误类型”,“骡子”,“MaxError”,0.05);尺寸(灰色)

状态空间模型,包含1个输出,1个输入和34个状态。

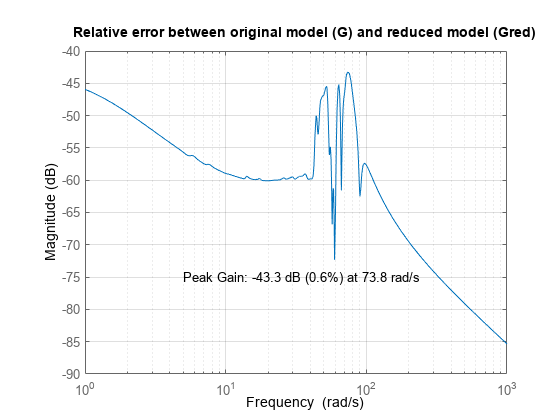

该算法选择了一个34状态简化模型gre考试.将实际误差与理论限值进行比较:

规范(GG \ (GG-Gred)、正)

ans=0.0068

info.ErrorBound

ans=0.0423

将相对误差大小视为频率的函数。以更大的模型阶数(从10到34)为代价实现了更高的精度。请注意,实际最大误差为0.6%,远低于5%的目标。这种差异是函数的结果bstmr使用错误界限而不是实际错误来选择订单。

bodemag(GG\(GG Gred),{1,1e3})网格在…上文本(5,-75,‘73.8 rad/s时的峰值增益:-43.3 dB(0.6%))头衔(“原始模型(G)和简化模型(Gred)之间的相对误差”)

图8:原始模型(G)和简化模型(Gred)之间的相对误差

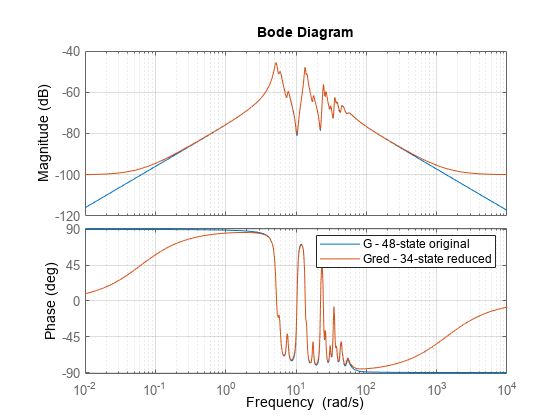

比较波特的反应

bode(G,Gred,{1e-2,1e4})格在…上传奇(“G-48国家原创”,“Gred - 34州降级”)

图9:48态原始模型和34态简化模型的伯德图

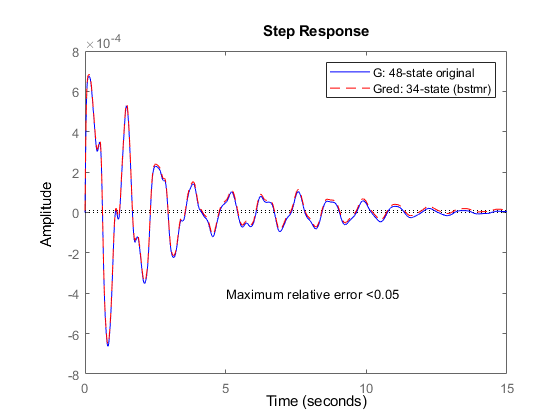

最后,比较原始模型和简化模型的阶跃响应,它们几乎无法区分。

步骤(G),“b”gre考试,“r——”15)%阶跃响应直到15秒传奇(“G:48州原文”,'格雷德:34州(bstmr)')文本(5 4的军医,“最大相对误差<0.05”)

图10:48状态原始模型和34状态简化模型的阶跃响应图