TreeBagger

创建决策树袋

个人决策树倾向于过度拟合。引导聚集(袋装)决策树结合大量的决策树,从而降低过度拟合的效果,提高了泛化的结果。TreeBagger增长的数据的集合使用bootstrap样本中的决策树。也,TreeBagger选择预测器的随机子集在每个决定分割使用如随机森林算法[1]。

默认,TreeBagger袋分类树。包包回归树来代替,指定“方法”,“回归”。

对于回归问题,TreeBagger万博1manbetx支持均值和分位数回归(即分位数回归森林[5])。

句法

MDL = TreeBagger(NumTrees,TBL,ResponseVarName)

MDL = TreeBagger(NumTrees,TBL,式)

MDL = TreeBagger(NumTrees,TBL,Y)

B = TreeBagger(NumTrees,X,Y)

B = TreeBagger(NumTrees,X,Y,名称,值)

描述

MDL= TreeBagger(NumTrees,TBL,ResponseVarName)NumTrees袋装分类树在使用表格中的样本数据训练TBL。ResponseVarName是在响应变量的名称TBL。

MDL= TreeBagger(NumTrees,TBL,式)TBL。式是响应的说明模型和预测变量的在一个子集TBL用来拟合MDL。指定式使用威尔金森符号。欲了解更多信息,请参阅威尔金森表示法。

MDL= TreeBagger(NumTrees,TBL,ÿ)TBL和类别标签在矢量ÿ。

ÿ是响应数据的数组。要点ÿ对应于各行TBL。对于分类,ÿ是一套真正的类标签。标签可以是任何分组变量即,数字或逻辑向量,字符矩阵,字符串数组,字符向量的单元阵列,或分类矢量。TreeBagger标签转换为字符向量的单元阵列。对于回归,ÿ是一个数值向量。增长回归树,你必须指定名称 - 值对“方法”,“回归”。

乙= TreeBagger(NumTrees,X,ÿ)乙的NumTrees用于预测响应决策树ÿ作为预测的在训练数据的数字矩阵的函数,X。每一行中X代表观测,每一列代表一个预测器或特征。

B = TreeBagger(NumTrees,X,Y,名称,值)指定可选的参数名称 - 值对:

'InBagFraction' |

输入数据的分数与从用于生长每个新树中的输入数据的替换样品。默认值是1。 |

'成本' |

方阵 或者,

默认值是 如果 |

'SampleWithReplacement' |

'上'与更换或样品“关”无需更换采样。如果您品尝无需更换,需要设置'InBagFraction'到的值小于一。默认值是'上'。 |

'OOBPrediction' |

'上'存储的信息是什么观测袋每个树出来。这个信息可以通过使用oobPrediction来计算预测的类概率在合奏每个树。默认值是“关”。 |

'OOBPredictorImportance' |

'上'存储在整体功能的重要性了球袋估计。默认值是“关”。指定'上'还设置了'OOBPrediction'值'上'。如果预测重要性的分析是你的目标,那么也可以指定'PredictorSelection', '弯曲'要么“PredictorSelection”,“相互作用曲率”。有关详细信息,请参阅fitctree要么fitrtree。 |

'方法' |

或'分类'要么“回归”。回归需要一个数字ÿ。 |

'NumPredictorsToSample' |

变量数以随机每个决策拆分选择。默认的是用于分类变量的数量的平方根和三分之一的回归变量的数目的。有效值'所有'或一个正整数。这个参数设置为任何有效的值,但'所有'所调用Breiman的随机森林算法[1]。 |

'NumPrint' |

培训周期数(成年树)之后,TreeBagger显示示出训练进度诊断消息。默认为不诊断消息。 |

'MinLeafSize' |

最小数每树叶意见。默认值是1用于分类和5回归。 |

“选项” |

一种结构,增长决策树的合奏时支配计算指定的选项。其中一个选项要求在多个引导重复决策树的计算使用多个处理器,如果并行计算工具箱™是可用的。两个选项指定选择引导重复的随机数流使用。您可以通过调用来创建这个说法

|

“在此之前” |

先验概率为每个类。指定为之一:

如果您在设定值 如果 |

'PredictorNames' |

预测器变量名,指定为逗号分隔的一对组成的

|

'CategoricalPredictors' |

分类预测列表中,指定为逗号分隔的一对组成的

|

“块大小” |

块大小,指定为逗号分隔的一对组成的 注意此选项仅使用时应用 |

除了上述的可选参数,TreeBagger接受这些可选fitctree和fitrtree参数。

万博1manbetx支持的fitctree参数 |

万博1manbetx支持的fitrtree参数 |

|---|---|

AlgorithmForCategorical |

MaxNumSplits |

MaxNumCategories |

MergeLeaves |

MaxNumSplits |

PredictorSelection |

MergeLeaves |

修剪 |

PredictorSelection |

PruneCriterion |

修剪 |

QuadraticErrorTolerance |

PruneCriterion |

SplitCriterion |

SplitCriterion |

代孕 |

代孕 |

权重 |

“权重” |

例子

提示

避免大的估计出的袋误差通过设置一个更平衡的误分类代价矩阵或更少歪斜先验概率矢量方差。

该

树财产乙存储的单元阵列B.NumTreesCompactClassificationTree要么CompactRegressionTree模型对象。对于树的文本或图形显示Ť在单元阵列中,输入视图(B.Trees {Ť})标准CART倾向于选择包含在含有几个不同的值,例如,分类变量那些许多不同的值,例如,连续的变量,分裂的预测[4]。考虑指定的曲率或相互作用试验如果任何以下的为真:

如果存在具有比其他预测相对较少不同的值,例如,如果预测的数据集是异质的预测因子。

如果预测重要性的分析是你的目标。

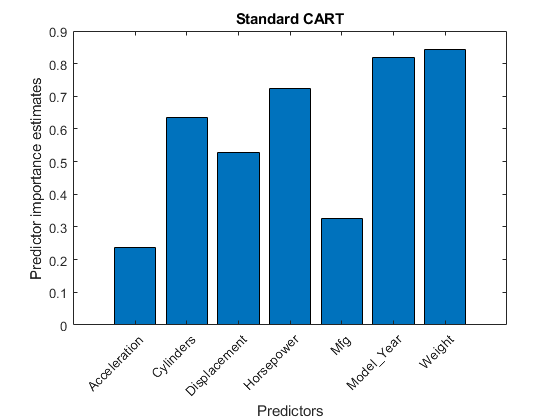

TreeBagger卖场预测因素的重要性估计OOBPermutedPredictorDeltaError财产MDL。

有关预测值选择的更多信息,请参阅

PredictorSelection对于分类树或PredictorSelection对于回归树。

算法

另类功能

统计和机器学习工具箱™提供了套袋和随机森林三个对象:

TreeBagger由...制作TreeBagger分类和回归

有关之间差异的详细信息TreeBagger和袋装合奏(ClassificationBaggedEnsemble和RegressionBaggedEnsemble),见TreeBagger和袋装合奏的比较。

参考

[1] Breiman,L.随机森林。机器学习45,第5-32,2001年。

[2] Breiman,L.,J。弗里德曼,R. Olshen,和C.石。分类和回归树。佛罗里达州Boca Raton:CRC出版社,1984年。

[3]蕙,W.Y.“回归树不带偏见的变量选择和互动检测。”国家统计报卷。12,2002年,第361-386。

[4]蕙,W.Y.和Y.S.施。“拆分选择方法对于分类树”。国家统计报卷。7,1997年,第815-840。

[5] Meinshausen,N“位数回归森林”。杂志的机器学习研究的卷。7,2006年,第983-999。