主要内容

侦探讲话

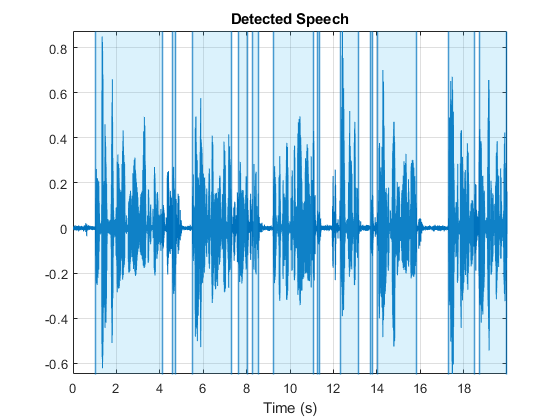

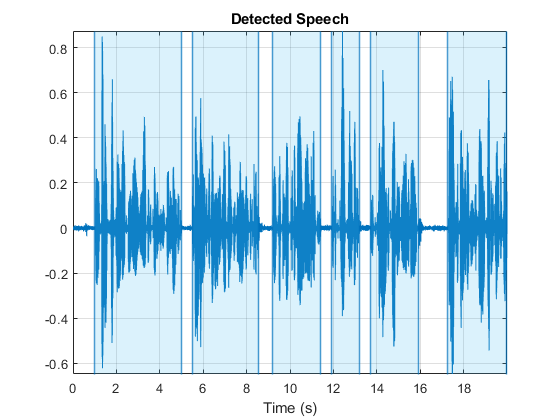

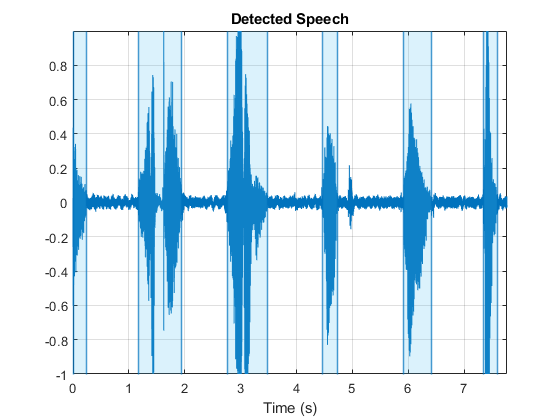

检测音频信号中的语音边界

描述

例子

输入参数

输出参数

算法

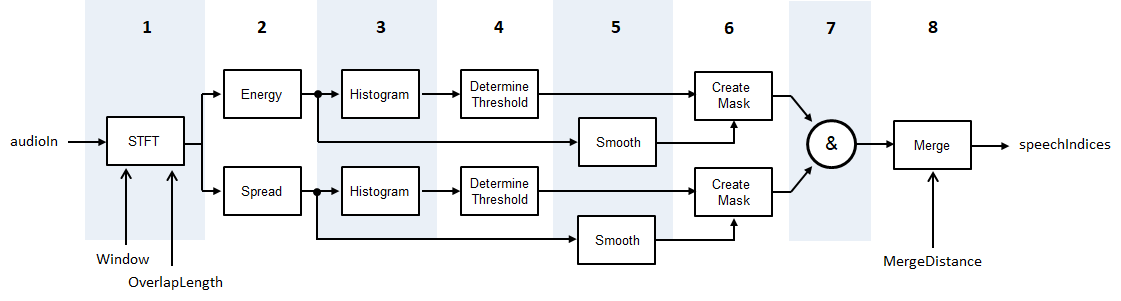

这个侦探讲话算法是基于[1],虽然修改使得阈值的统计数据是短期能量和光谱传播,而不是短期能量和光谱质心。图和步骤提供了算法的高级概述。有关详细信息,请参阅[1].

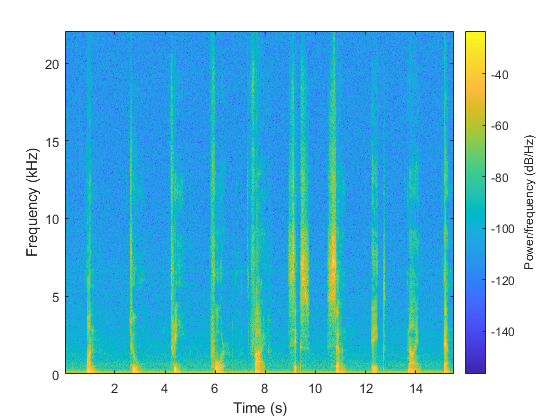

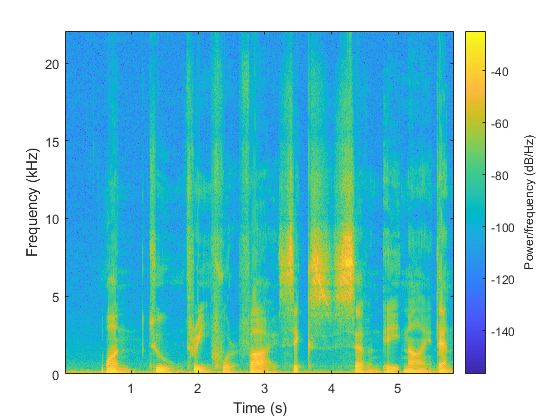

使用指定的音频信号将音频信号转换为时频表示

窗和overtaplenth.为每个帧计算短期能量和光谱扩展。根据条件计算光谱差距

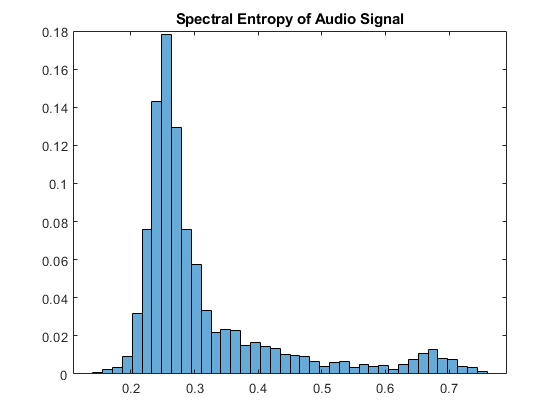

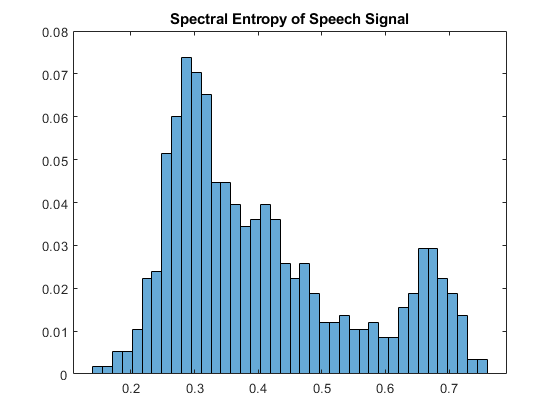

光谱分布.为短期能量和光谱扩展分布创建直方图。

对于每个直方图,根据 , 在哪里M1.和M2.分别是第一个和第二个局部极大值。W被设定为

5..通过连续的五元素移动中值过滤器通过连续的五元件,横跨频谱扩散和短期能量都是平滑的。

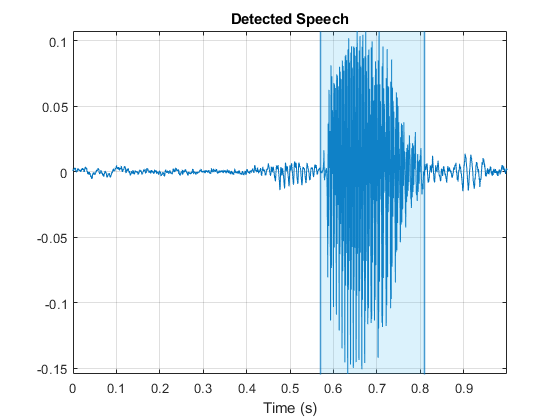

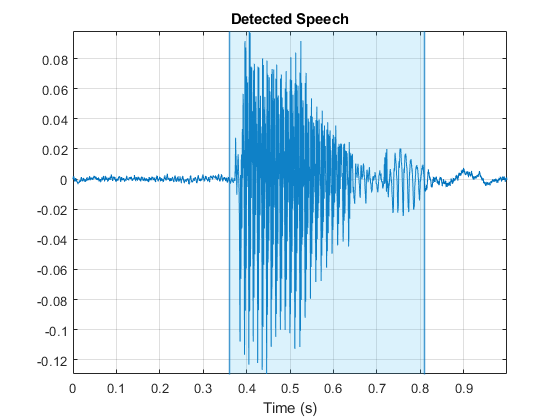

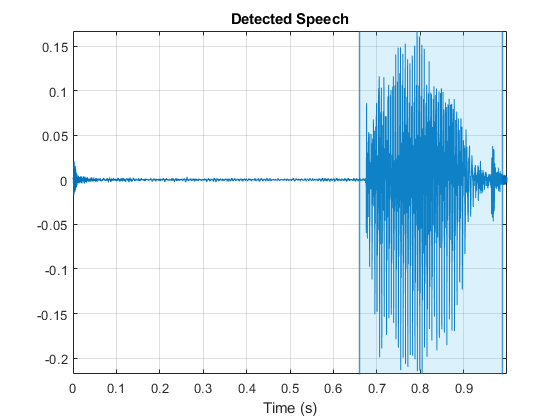

通过将短期能量和频谱扩展与其各自的阈值进行比较来创建掩码。若要将帧声明为包含语音,特征必须高于其阈值。

掩码是组合在一起的。对于要声明为语音的帧,短期能量和频谱扩展必须高于各自的阈值。

如果声明为语音的区域之间的距离小于

合并距离.

参考

[1] Theodoros Giannakopoulos,“语音信号的静音消除和分割方法,在MATLAB中实现”,(雅典大学,雅典,2009年)。

扩展能力

在R2020a中引入