alexnet

AlexNet卷积神经网络

描述

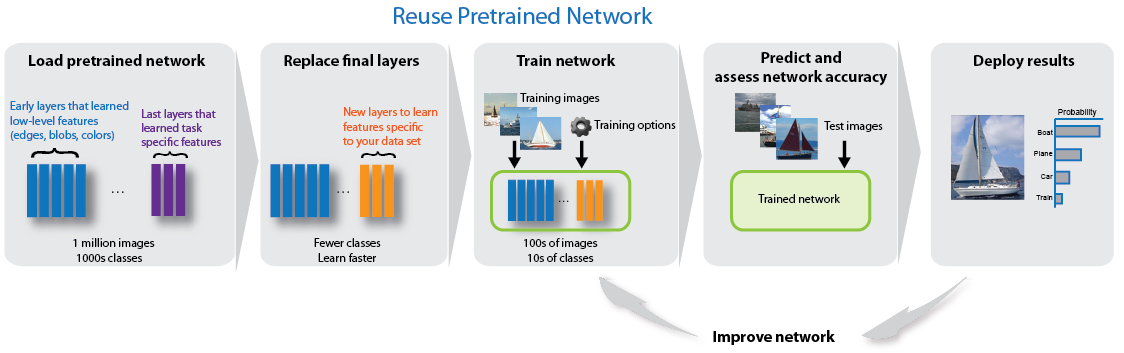

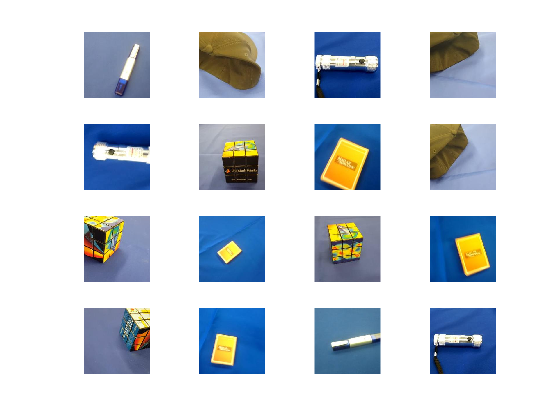

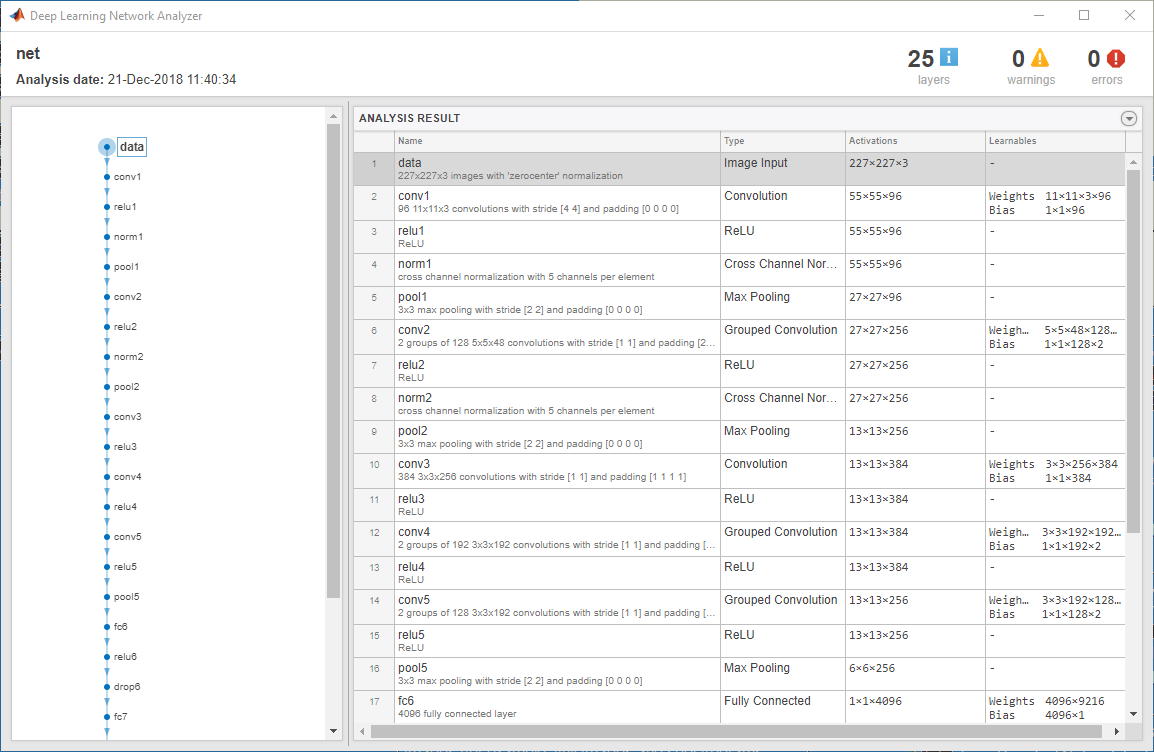

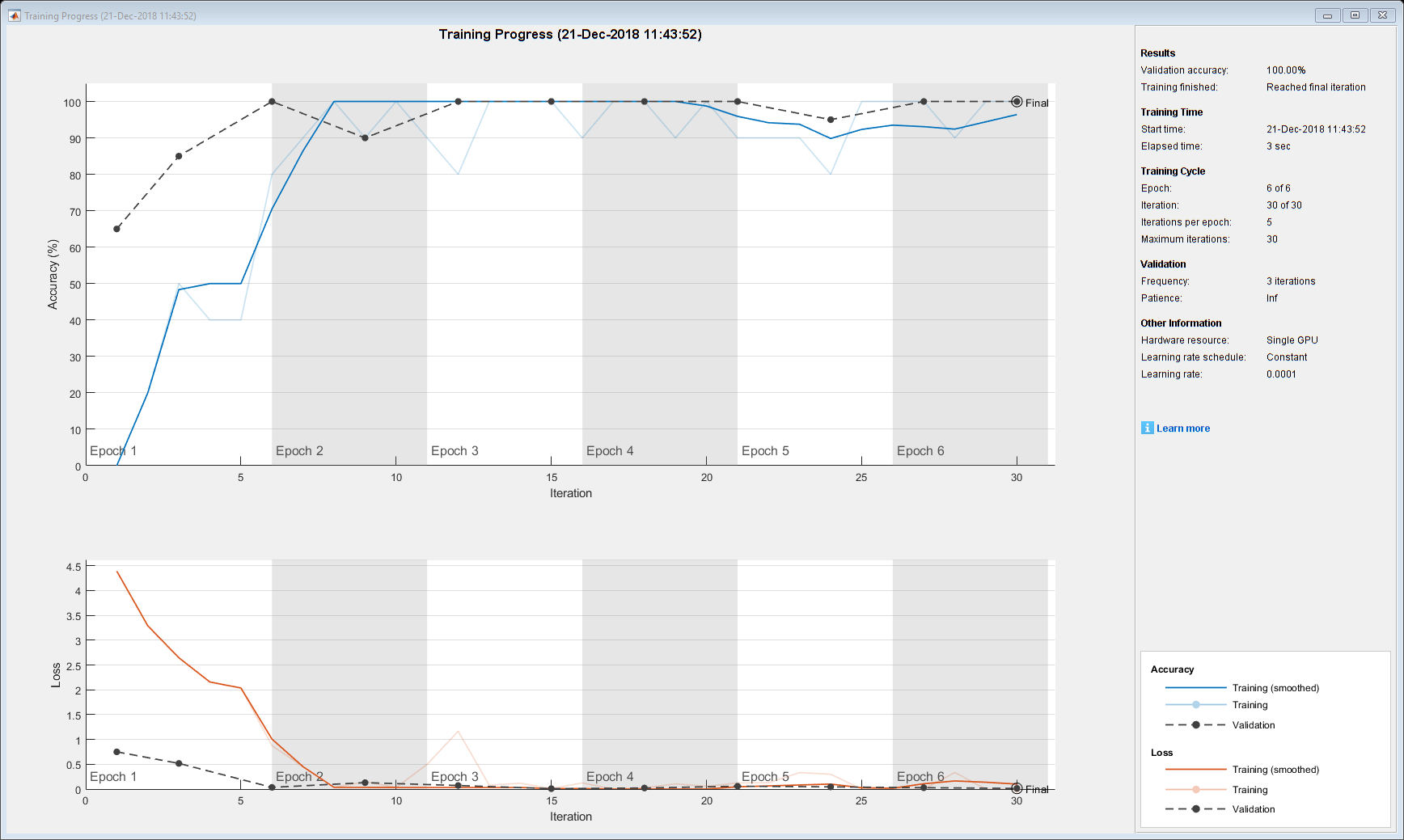

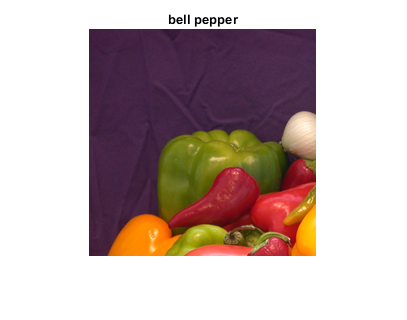

AlexNet是卷积神经网络是深8层。您可以从ImageNet数据库加载培训了超过一万张图片的网络的预训练版本[1]。这个预先训练好的网络可以将图像分成1000个对象类别,比如键盘、鼠标、铅笔和许多动物。因此,该网络学会了丰富的特征表示,为广泛的图像。该网络的图像输入大小为227 * 227。用于MATLAB中更多的预训练网络®见预先训练的深度神经网络。

您可以使用分类使用AlexNet网络对新图像进行分类。遵循以下步骤使用GoogLeNet对图像进行分类与AlexNet取代GoogLeNet。

有关实际深度学习方法的免费实践介绍,请参阅深度学习匝道。

净= alexnet

此功能需要深度学习工具箱™模式对于AlexNet网络万博1manbetx支持包。如果未安装此支持万博1manbetx包,该功能提供了下载链接。另外,看深度学习工具箱模型对于AlexNet网络。

对于MATLAB更多的预训练的网络,看预先训练的深度神经网络。

净= alexnet(“权重”,'imagenet')净= alexnet。

层= alexnet(“权重”,'没有')

例子

输出参数

提示

有关实际深度学习方法的免费实践介绍,请参阅深度学习匝道。

参考

[1]ImageNet。http://www.image-net.org

[2] Russakovsky,O.,邓,J.,苏,H。等人。“ImageNet大型视觉识别的挑战。”国际计算机视觉杂志(IJCV)。第115卷,2015年第3期,第211-252页

[3] Krizhevsky,亚历克斯,伊利亚Sutskever,和Geoffrey E.欣顿。“ImageNet分类与深卷积神经网络。”在神经信息处理系统的进步。2012.

[4]BVLC AlexNet模型。https://github.com/BVLC/caffe/tree/master/models/bvlc_alexnet

扩展功能

也可以看看

深层网络设计师|densenet201|googlenet|importCaffeNetwork|importKerasNetwork|inceptionresnetv2|resnet18|resnet50|squeezenet|vgg16|vgg19