importTensorFlowNetwork

描述

净= importTensorFlowNetwork (modelFolder)modelFolder保存模型中的模型,其中包含格式(兼容只有TensorFlow 2)。该函数可以导入TensorFlow网络创建TensorFlow-Keras顺序或功能的API。importTensorFlowNetwork进口中定义的层saved_model.pb中包含的文件和学习权重变量子文件夹,并返回网络净作为一个DAGNetwork或dlnetwork对象。

importTensorFlowNetwork要求深度学习工具箱™转换器TensorFlow模型万博1manbetx支持包。如果这种支持包没万博1manbetx有安装importTensorFlowNetwork提供一个下载链接。

请注意

importTensorFlowNetwork试图生成一个自定义层当你导入一个定制TensorFlow层或当软件不能TensorFlow层转化为一个等价的内置MATLAB®层。的层的软件支持转换,明白了万博1manbetxTensorFlow-Keras层支持转换成内置万博1manbetxMATLAB层。

importTensorFlowNetwork保存生成的自定义层和相关TensorFlow运营商在包+。modelFolder

importTensorFlowNetwork并不会自动生成一个自定义层每个TensorFlow层不支持转换成一个内置的MATLAB层。万博1manbetx如何处理不支持层的更多信息,见万博1manbetx提示。

净= importTensorFlowNetwork (modelFolder,名称,值)“OutputLayerType”、“分类”网络作为一个进口DAGNetwork与一个分类输出层附加到结束的进口网络体系结构。

例子

进口TensorFlow网络DAGNetwork对图像进行分类

导入一个pretrained TensorFlow网络在保存的模型格式DAGNetwork对象,并使用进口网络分类图像。

指定模型文件夹。

如果~ (“digitsDAGnet”,“dir”)解压缩(“digitsDAGnet.zip”)结束modelFolder =”。/ digitsDAGnet ';

指定类名。

一会= {' 0 ',' 1 ',' 2 ',“3”,“4”,“5”,“6”,“7”,“8”,“9”};

在保存的模型格式导入TensorFlow网络。默认情况下,importTensorFlowNetwork网络作为一个进口DAGNetwork对象。指定输出层类型的图像分类问题。

网= importTensorFlowNetwork (modelFolder,“OutputLayerType”,“分类”,“类”类名)

导入保存模型……翻译的模式,这可能需要几分钟…完成翻译。装配网络……导入完成。

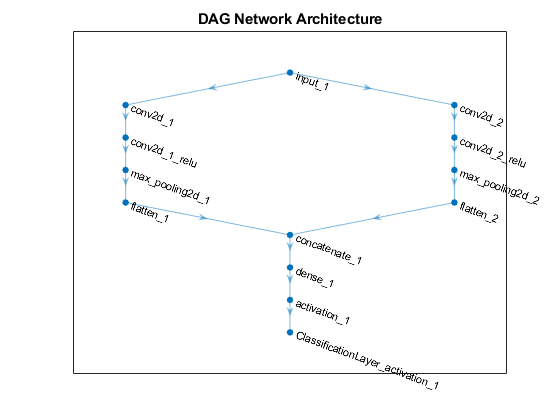

网= DAGNetwork属性:层:[13×1 nnet.cnn.layer.Layer]连接:[13×2表]InputNames: {“input_1”} OutputNames: {“ClassificationLayer_activation_1”}

绘制网络体系结构。

情节(净)标题(“DAG网络体系结构”)

读你想要的图像分类和显示图像的大小。图像是灰度图像(一个频道)28-by-28像素大小。

digitDatasetPath = fullfile (toolboxdir (“nnet”),“nndemos”,“nndatasets”,“DigitDataset”);我= imread (fullfile (digitDatasetPath,“5”,“image4009.png”));大小(我)

ans =1×228日28日

显示输入网络的大小。在这种情况下,图像大小匹配网络输入的大小。如果它们不匹配,您必须调整图像通过使用imresize(我netInputSize (1:2))。

net.Layers (1) .InputSize

ans =1×328日28日1

使用pretrained网络分类的图像。

标签=分类(净,我);

显示图像的分类结果。

imshow (I)标题([的分类结果char(标签)))

进口TensorFlow网络dlnetwork对图像进行分类

导入一个pretrained TensorFlow网络在保存的模型格式dlnetwork对象,并使用进口网络预测类标签。

指定模型文件夹。

如果~ (“digitsDAGnet”,“dir”)解压缩(“digitsDAGnet.zip”)结束modelFolder =”。/ digitsDAGnet ';

指定类名。

一会= {' 0 ',' 1 ',' 2 ',“3”,“4”,“5”,“6”,“7”,“8”,“9”};

导入一个TensorFlow网络在保存的模型格式dlnetwork对象。

网= importTensorFlowNetwork (modelFolder,“TargetNetwork”,“dlnetwork”)

导入保存模型……翻译的模式,这可能需要几分钟…完成翻译。装配网络……导入完成。

网= dlnetwork属性:层:[12×1 nnet.cnn.layer.Layer]连接:[12×2表]可学的:[6×3表]状态:[0×3表]InputNames: {“input_1”} OutputNames: {“activation_1”}初始化:1

读你想要的图像分类和显示图像的大小。图像是灰度图像(一个频道)28-by-28像素大小。

digitDatasetPath = fullfile (toolboxdir (“nnet”),“nndemos”,“nndatasets”,“DigitDataset”);我= imread (fullfile (digitDatasetPath,“5”,“image4009.png”));大小(我)

ans =1×228日28日

显示输入网络的大小。在这种情况下,图像大小匹配网络输入的大小。如果它们不匹配,您必须调整图像通过使用imresize(我netInputSize (1:2))。

.InputSize netInputSize = net.Layers (1)

netInputSize =1×328日28日1

将图像转换为一个dlarray。格式的图像尺寸“SSCB”(空间、空间、通道、批)。在这种情况下,批量大小是1,你可以忽略它(SSC的)。

I_dlarray = dlarray(单(我),“SSCB”);

样本图像进行分类,找到预测的标签。

概率=预测(净,I_dlarray);[~,标签]= max(概率);

显示图像的分类结果。

imshow (I)标题([的分类结果一会{标签}])

进口TensorFlow网络自动生成自定义层

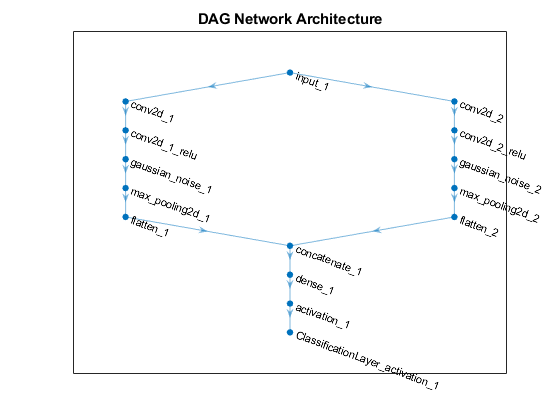

导入一个pretrained TensorFlow网络在保存的模型格式DAGNetwork对象,并使用进口网络分类图像。导入的网络不支持包含层转换成内置MATLAB层。万博1manbetx软件自动生成自定义层当你进口这些层。

下面的例子使用了辅助函数findCustomLayers。查看这个函数的代码,看看Helper函数。

指定模型文件夹。

如果~ (“digitsDAGnetwithnoise”,“dir”)解压缩(“digitsDAGnetwithnoise.zip”)结束modelFolder =”。/ digitsDAGnetwithnoise ';

指定类名。

一会= {' 0 ',' 1 ',' 2 ',“3”,“4”,“5”,“6”,“7”,“8”,“9”};

在保存的模型格式导入TensorFlow网络。默认情况下,importTensorFlowNetwork网络作为一个进口DAGNetwork对象。指定输出层类型的图像分类问题。

网= importTensorFlowNetwork (modelFolder,“OutputLayerType”,“分类”,“类”类名);

导入保存模型……翻译的模式,这可能需要几分钟…完成翻译。装配网络……导入完成。

如果导入网络包含转换成的层不支持内置MATLAB层,万博1manbetximportTensorFlowNetwork可以自动生成自定义层代替这些层。importTensorFlowNetwork保存每个生成自定义一个单独的层。m文件包+ digitsDAGnetwithnoise在当前文件夹。

找到自动生成自定义的指标层使用helper函数findCustomLayers,并显示自定义层。

印第安纳州= findCustomLayers (net.Layers,' + digitsDAGnetwithnoise ');net.Layers(印第安纳州)

ans = 3×1层与层:数组1连接digitsDAGnetwithnoise concatenate_1。kConcatenate1Layer3826 2的gaussian_noise_1 GaussianNoise digitsDAGnetwithnoise。kGaussianNoise1Layer3766 3 ' gaussian_noise_2 ' GaussianNoise digitsDAGnetwithnoise.kGaussianNoise2Layer3791

绘制网络体系结构。

情节(净)标题(“DAG网络体系结构”)

读你想要的图像分类。

digitDatasetPath = fullfile (toolboxdir (“nnet”),“nndemos”,“nndatasets”,“DigitDataset”);我= imread (fullfile (digitDatasetPath,“5”,“image4009.png”));

使用pretrained网络分类的图像。

标签=分类(净,我);

显示图像的分类结果。

imshow (I)标题([的分类结果char(标签)))

Helper函数

本节提供的代码辅助功能findCustomLayers在这个例子中使用。findCustomLayers返回指数自定义层importTensorFlowNetwork自动生成。

函数指数= findCustomLayers(层,PackageName) s = ([“。”filesep PackageName]);指数= 0(1、长度(小);为i = 1:长度(层)为j = 1:长度(小)如果strcmpi(类(层(i)), [PackageName(2:结束)“。”s.m {j} (1: end-2)])指数(j) =我;结束结束结束结束

输入参数

modelFolder- - - - - -TensorFlow模型文件夹的名称

特征向量|字符串标量

文件夹的名称包含TensorFlow模型,指定为一个特征向量或字符串标量。modelFolder必须在当前文件夹,或者你必须包括完整或相对路径的文件夹。modelFolder必须包含的文件saved_model.pb和子文件夹变量。它还可以包含子文件夹资产和assets.extra。

该文件

saved_model.pb包含层图架构和培训选项(例如,优化器、损失和度量)。的子文件夹

变量包含的权重学习pretrained TensorFlow网络。默认情况下,importTensorFlowNetwork进口的权重。的子文件夹

资产包含补充文件(例如,词汇表),这层图可以使用。importTensorFlowNetwork没有导入文件吗资产。的子文件夹

assets.extra包含补充文件(例如,信息用户),这与层图共存。

例子:“MobileNet”

例子:”。/ MobileNet '

名称-值参数

指定可选的双参数作为Name1 = Value1,…,以=家,在那里的名字参数名称和吗价值相应的价值。名称-值参数必须出现在其他参数,但对的顺序无关紧要。

R2021a之前,用逗号来分隔每一个名称和值,并附上的名字在报价。

例子:importTensorFlowNetwork (modelFolder‘TargetNetwork’,‘dagnetwork’,‘OutputLayerType’,“分类”)进口的网络modelFolder作为一个DAGNetwork对象,保存自动生成自定义层的包+ modelFolder在当前文件夹,并附加一个分类输出层的进口网络体系结构。

PackageName- - - - - -定义层包的名称

特征向量|字符串标量

的包的名称importTensorFlowNetwork保存自定义图层,指定为一个特征向量或字符串标量。importTensorFlowNetwork保存自定义层包+在当前文件夹。如果你不指定PackageName“PackageName”,然后importTensorFlowNetwork保存自定义层包命名+在当前文件夹。关于包的更多信息,请参阅包创建名称空间。modelFolder

importTensorFlowNetwork试图生成一个自定义层当你导入一个定制TensorFlow层或当软件不能TensorFlow层转化为一个等价的内置MATLAB层。importTensorFlowNetwork保存每个生成自定义一个单独的层。m文件中+。查看或编辑自定义图层,打开相关PackageName。m文件。自定义层的更多信息,见自定义图层。

这个包+也可以包含分包PackageName+行动。这个分包包含MATLAB函数对应TensorFlow运营商(见万博1manbetx支持TensorFlow运营商),用于自动生成自定义层。importTensorFlowNetwork保存相关的每个操作符在一个单独的MATLAB函数。m文件分装+行动。对象的功能dlnetwork,如预测函数,使用这些操作符与自定义交互层。

例子:“PackageName”、“MobileNet”

例子:“PackageName”、“CustomLayers”

TargetNetwork- - - - - -深度学习工具箱网络的目标类型

“dagnetwork”(默认)|“dlnetwork”

深度学习工具箱网络的目标类型,指定为“dagnetwork”或“dlnetwork”。

指定

“TargetNetwork作为“dagnetwork”导入网络DAGNetwork对象。在这种情况下,净必须包括一个输出层TensorFlow保存模型损失函数或指定的名称论点吗“OutputLayerType”。指定

“TargetNetwork作为“dlnetwork”导入网络dlnetwork对象。在这种情况下,净不包括一个输出层。

例子:“TargetNetwork”、“dlnetwork”

OutputLayerType- - - - - -类型的输出层

“分类”|“回归”|“pixelclassification”

类型的输出层importTensorFlowNetwork附加的导入的网络体系结构,指定为“分类”,“回归”,或“pixelclassification”。附加一个pixelClassificationLayer(计算机视觉工具箱)计算机视觉对象需要工具箱™。

如果您指定

“TargetNetwork”作为“dagnetwork”和保存的模型modelFolder不指定一个损失函数,您必须指定一个名称参数值“OutputLayerType”。一个DAGNetwork对象必须有一个输出层。如果您指定

“TargetNetwork”作为“dlnetwork”,importTensorFlowNetwork忽略了名称-值参数“OutputLayerType”。一个dlnetwork对象没有一个输出层。

例子:“OutputLayerType”、“分类”

ImageInputSize- - - - - -输入图像的大小

向量的两个或三个数值

网络的输入图像的大小,指定为一个向量的两个或三个数值对应(高度、宽度)对灰度图像和(高度、宽度、渠道)分别对彩色图像。网络时使用该信息saved_model.pb文件中modelFolder没有指定输入的大小。

例子:“ImageInputSize”, [28 28]

类- - - - - -输出层的类

“汽车”(默认)|分类向量|字符串数组|单元阵列的特征向量

输出层的类,指定为一个分类向量,字符串数组,单元阵列的特征向量,或“汽车”。如果您指定一个字符串数组或单元阵列的特征向量str,然后importTensorFlowNetwork设置输出层的类分类(str, str)。如果类是“汽车”,然后importTensorFlowNetwork设置类分类(1:N),在那里N类的数量。

如果您指定

“TargetNetwork”作为“dagnetwork”,importTensorFlowNetwork类的信息存储在输出层DAGNetwork对象。如果您指定

“TargetNetwork”作为“dlnetwork”,importTensorFlowNetwork忽略了名称-值参数“类”。一个dlnetwork对象没有一个输出层存储类的信息。

例子:“类”,{' 0 ',' 1 ',' 3 '}

例子:“类”,直言({‘狗’,‘猫’})

数据类型:字符|分类|字符串|细胞

详细的- - - - - -指标显示导入进度信息

真正的或1(默认)|假或0

指示器显示导入进度信息在命令窗口中,指定为一个数字或逻辑1(真正的)或0(假)。

例子:“详细”,“真正的”

输出参数

净——Pretrained TensorFlow网络

DAGNetwork对象|dlnetwork对象

限制

importTensorFlowNetwork万博1manbetx支持v2.0 TensorFlow版本2.6。

更多关于

TensorFlow-Keras层支持转换成内置万博1manbetxMATLAB层

importTensorFlowNetwork万博1manbetx支持以下TensorFlow-Keras层类型转换成内置MATLAB层,有一些局限性。

| TensorFlow-Keras层 | 相应的深度学习工具箱层 |

|---|---|

添加 |

additionLayer |

|

层: |

先进的激活:

|

层:

|

AveragePooling1D |

averagePooling1dLayer与PaddingValue指定为“的意思是” |

AveragePooling2D |

averagePooling2dLayer与PaddingValue指定为“的意思是” |

BatchNormalization |

batchNormalizationLayer |

双向(LSTM (__)) |

bilstmLayer |

Conv1D |

convolution1dLayer |

Conv2D |

convolution2dLayer |

Conv2DTranspose |

transposedConv2dLayer |

CuDNNGRU |

gruLayer |

CuDNNLSTM |

lstmLayer |

密集的 |

fullyConnectedLayer |

DepthwiseConv2D |

groupedConvolution2dLayer |

辍学 |

dropoutLayer |

嵌入 |

wordEmbeddingLayer(文本分析工具箱) |

平 |

nnet.keras.layer.FlattenCStyleLayer |

GlobalAveragePooling1D |

globalAveragePooling1dLayer |

GlobalAveragePooling2D |

globalAveragePooling2dLayer |

GlobalMaxPool1D |

globalMaxPooling1dLayer |

GlobalMaxPool2D |

globalMaxPooling2dLayer |

格勒乌 |

gruLayer |

输入 |

imageInputLayer,sequenceInputLayer,或featureInputLayer |

LSTM |

lstmLayer |

MaxPool1D |

maxPooling1dLayer |

MaxPool2D |

maxPooling2dLayer |

乘 |

multiplicationLayer |

SeparableConv2D |

groupedConvolution2dLayer或convolution2dLayer |

TimeDistributed |

sequenceFoldingLayer之前的包裹层,sequenceUnfoldingLayer后包层 |

UpSampling2D |

resize2dLayer(图像处理工具箱) |

UpSampling3D |

resize3dLayer(图像处理工具箱) |

ZeroPadding1D |

nnet.keras.layer.ZeroPadding1DLayer |

ZeroPadding2D |

nnet.keras.layer.ZeroPadding2DLayer |

* PReLU层,importTensorFlowNetwork取代了向量值尺度参数的平均向量的元素。你可以改变参数导入后回到一个向量。例如,看到的进口Keras PReLU层。

万博1manbetx支持TensorFlow-Keras损失函数

importTensorFlowNetwork万博1manbetx支持以下Keras损失函数:

mean_squared_errorcategorical_crossentropysparse_categorical_crossentropybinary_crossentropy

万博1manbetx支持TensorFlow运营商

importTensorFlowNetwork万博1manbetx支持以下TensorFlow运营商转变为MATLAB函数dlarray万博1manbetx支持。

| TensorFlow运营商 | 相应的MATLAB函数 |

|---|---|

添加 |

tfAdd |

AddN |

tfAddN |

AddV2 |

tfAdd |

所有 |

tfAll |

断言 |

断言 |

AvgPool |

tfAvgPool |

BatchMatMulV2 |

tfBatchMatMulV2 |

BiasAdd |

tfBiasAdd |

BroadcastTo |

tfBroadcastTo |

投 |

tfCast |

ConcatV2 |

tfCat |

常量 |

(翻译没有重量在自定义层) |

Conv2D |

tfConv2D |

DepthToSpace |

depthToSpace(图像处理工具箱) |

DepthwiseConv2dNative |

tfDepthwiseConv2D |

平等的 |

= = |

经验值 |

经验值 |

ExpandDims |

tfExpandDims |

填满 |

tfFill |

FusedBatchNormV3 |

tfBatchnorm |

GatherV2 |

tfGather |

更大的 |

gt> |

GreaterEqual |

通用电气,> = |

身份 |

(没有一个翻译在自定义层)赋值 |

IdentityN |

tfIdentityN |

L2Loss |

tfL2Loss |

LeakyRelu |

leakyrelu |

少 |

lt,< |

日志 |

日志 |

MatMul |

tfMatMul |

MaxPool |

tfMaxPool |

最大 |

tfMaximum |

的意思是 |

tfMean |

最低 |

tfMinimum |

MirrorPad |

tfMirrorPad |

Mul |

tfMul |

负的 |

-,- - - - - - |

NonMaxSuppressionV5 |

tfNonMaxSuppressionV5 |

包 |

tfStack |

垫 |

tfPad |

PadV2 |

tfPad |

PartitionedCall |

(没有翻译功能自定义层方法) |

战俘 |

权力,。^ |

刺激 |

tfProd |

RandomStandardNormal |

tfRandomStandardNormal |

范围 |

tfRange |

ReadVariableOp |

(没有一个翻译在自定义层)赋值 |

RealDiv |

tfDiv |

线性整流函数(Rectified Linear Unit) |

线性整流函数(Rectified Linear Unit) |

Relu6 |

线性整流函数(Rectified Linear Unit)和最小值 |

重塑 |

tfReshape |

ResizeBilinear |

dlresize(图像处理工具箱) |

ResizeNearestNeighbor |

dlresize(图像处理工具箱) |

Rsqrt |

√6 |

选择 |

tfSelect |

形状 |

tfShape |

乙状结肠 |

乙状结肠 |

大小 |

tfSize |

片 |

tfSlice |

Softmax |

softmax |

SpaceToDepth |

spaceToDepth(图像处理工具箱) |

分裂 |

tfSplit |

广场 |

. ^ 2 |

√6 |

√6 |

SquaredDifference |

tfMul或tfSub |

挤压 |

tfSqueeze |

StatefulPartitionedCall |

(没有翻译功能自定义层方法) |

StopGradient |

tfStopGradient |

StridedSlice |

tfStridedSlice或tfSqueeze |

子 |

tfSub |

总和 |

tfSum |

双曲正切 |

双曲正切 |

瓷砖 |

tfTile |

转置 |

tfTranspose |

解压缩 |

tfUnpack |

在哪里 |

tfWhere |

有关函数操作的更多信息dlarray对象,看到与dlarray支持函数的列表万博1manbetx。

对进口网络的生成代码

您可以使用MATLAB编码器™或GPU编码器™一起深度学习工具箱生成墨西哥人,独立的CPU, CUDA®墨西哥人,或独立的CUDA代码导入网络。有关更多信息,请参见代码生成。

使用MATLAB编码器与深度学习工具箱生成墨西哥人或独立的CPU的代码运行在桌面或嵌入式目标。您可以部署生成独立的代码,使用了英特尔®MKL-DNN库或手臂®计算库。或者,您可以生成通用的C或c++代码不调用第三方库函数。有关更多信息,请参见深度学习与MATLAB编码器(MATLAB编码器)。

使用GPU与深度学习工具箱编码器生成CUDA墨西哥人或独立的CUDA的代码运行在桌面或嵌入式目标。您可以部署生成独立的CUDA的代码使用CUDA深层神经网络库(cuDNN)的TensorRT™高性能推理库,或手臂计算库马里GPU。有关更多信息,请参见深度学习GPU编码器(GPU编码器)。

importTensorFlowNetwork返回网络净作为一个DAGNetwork或dlnetwork对象。这两个对象支持代码生成。万博1manbetx的更多信息MATLAB编码器和GPU编码器支持深度学习工万博1manbetx具箱对象,明白了万博1manbetx支持类(MATLAB编码器)和万博1manbetx支持类(GPU编码器),分别。

您可以生成代码的任何进口网络层支持代码生成。万博1manbetx层支持代码生成的列表万博1manbetxMATLAB编码器和GPU编码器,看到万博1manbetx支持层(MATLAB编码器)和万博1manbetx支持层(GPU编码器),分别。更多信息在每一个内置的代码生成功能和限制MATLAB层,请参见扩展功能部分的层。例如,请参见代码生成和GPU的代码生成的imageInputLayer。

在GPU上使用进口网络

importTensorFlowNetwork不执行GPU。然而,importTensorFlowNetwork进口pretrained深度学习的神经网络DAGNetwork或dlnetwork对象,您可以使用GPU。

如果你导入网络

DAGNetwork对象,您可以做出预测与进口网络使用一个CPU或GPU分类。使用名称-值参数指定的硬件需求ExecutionEnvironment。对于多个输出的网络,使用预测函数DAGNetwork对象。如果你导入网络

DAGNetwork对象,您可以做出预测与进口网络使用一个CPU或GPU预测。使用名称-值参数指定的硬件需求ExecutionEnvironment。如果网络有多个输出,指定名称的论点ReturnCategorical作为真正的。如果你导入网络

dlnetwork对象,您可以做出预测与进口网络使用一个CPU或GPU预测。这个函数预测在GPU上执行如果输入数据或网络参数存储在GPU上。如果你使用

minibatchqueue输入数据的处理和管理mini-batches,minibatchqueue对象将输出转换为GPU数组默认情况下如果GPU可用。使用

dlupdate转换的可学的参数dlnetworkGPU数组对象。净= dlupdate (@gpuArray,净)

你可以训练进口网络使用一个CPU或GPU

trainNetwork。指定训练选项,包括选项执行环境,使用trainingOptions函数。使用名称-值参数指定的硬件需求ExecutionEnvironment。如何加快培训更多的信息,请参阅并行扩展深度学习,在gpu上,在云端。

使用GPU需要并行计算工具箱™许可和支持GPU设备。万博1manbetx支持设备的信息,请参阅万博1manbetxGPU计算的需求(并行计算工具箱)。

提示

如果进口网络包含一层不支持转换成一个内置的MATLAB层(见万博1manbetxTensorFlow-Keras层支持转换成内置万博1manbetxMATLAB层),

importTensorFlowNetwork不生成一个自定义层呢importTensorFlowNetwork返回一个错误。在这种情况下,您仍然可以使用importTensorFlowLayers导入网络体系结构。使用pretrained网络预测或转让学习新的图片,你必须进行预处理图像以同样的方式用于火车导入模型的图像预处理。最常见的预处理步骤调整图片大小,图像减去平均值,将图像从BGR格式转换为RGB格式。

更多信息预处理图像进行训练和预测,明白了预处理图像深度学习。

包的成员

+(自定义层和TensorFlow运营商)是无法访问如果包父文件夹不是在MATLAB的道路。有关更多信息,请参见包和MATLAB的道路。PackageNameMATLAB使用集中的索引,而Python®使用从零开始的索引。换句话说,在数组第一个元素的索引1和0在MATLAB和Python,分别。MATLAB索引的更多信息,请参阅数组索引。在MATLAB中,使用数组索引(

印第安纳州)在Python中,创建数组转换为印第安纳州+ 1。更多的技巧,明白了建议从TensorFlow进口模型,PyTorch ONNX。

选择功能

使用importTensorFlowNetwork或importTensorFlowLayers进口TensorFlow网络保存模型格式[2]。另外,如果网络HDF5或JSON格式,使用importKerasNetwork或importKerasLayers导入网络。

引用

[1]TensorFlow。https://www.tensorflow.org/。

[2]使用SavedModel格式。https://www.tensorflow.org/guide/saved_model。

版本历史

介绍了R2021aR2023a:importTensorFlowNetwork创建一个自定义层连接

的importTensorFlowNetwork函数返回一个theTensorFlow-Keras自动生成自定义层连接一层一层而不是内置的深度学习工具箱concatenationLayer或depthConcatenationLayer。以前,所使用的函数concatenationLayer或depthConcatenationLayer并假定连接轴值基于网络的输入层被导入。然而,对于一些复杂的网络这种假设可能不是真的。因此,软件使用一个自动生成自定义层执行连接。自动生成自定义层确保TensorFlow-Keras的正确的翻译连接在运行时层到MATLAB。

MATLAB命令

你点击一个链接对应MATLAB命令:

运行该命令通过输入MATLAB命令窗口。Web浏览器不支持MATLAB命令。万博1manbetx

你也可以从下面的列表中选择一个网站:

表现最好的网站怎么走吗

选择中国网站(中文或英文)最佳站点的性能。其他MathWorks国家网站不优化的访问你的位置。