Q学习代理

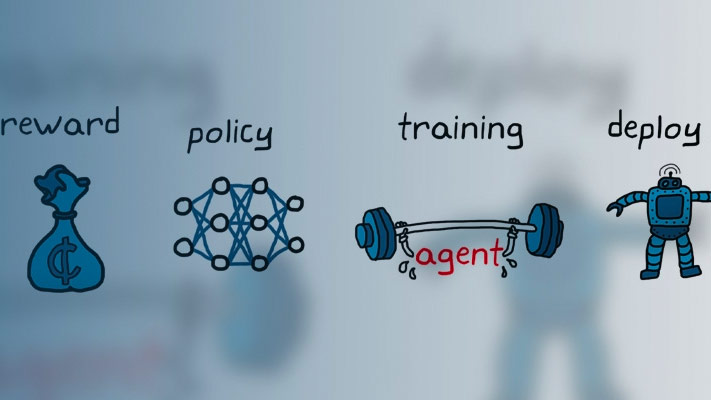

Q学习算法是一种无模型,在线,禁止策略加强学习方法。Q学习代理是一个基于价值的强化学习代理,可以训练批评奖励或未来奖励。

有关不同类型的强化学习代理商的更多信息,请参阅加固学习代理人。

Q学习代理可以在具有以下观察和动作空间的环境中培训。

| 观察空间 | 行动空间 |

|---|---|

| 连续或离散 | 离散的 |

Q代理商使用以下批评者表示。

| 评论家 | 演员 |

|---|---|

Q值功能评论家q(s,a),您创建使用 |

Q代理商不使用演员。 |

在培训期间,代理商使用epsilon-贪婪的探索来探讨动作空间。在每个控制间隔期间,代理使用概率选择随机动作ε.否则,它对具有概率1的值函数贪婪地选择了一个动作 -ε.。这种贪婪的行动是价值函数最大的动作。

批评功能

要估计价值函数,Q学习代理维护评论家问:(S.那一种),这是一个表或函数近似剂。评论家采取观察S.和行动一种作为输入并返回相应的长期奖励期望。

有关创建值函数近似的批评者的更多信息,请参阅创建策略和值函数表示。

培训完成后,培训的值函数近似器存储在评论家中问:(S.那一种)。

代理创作

要创建Q学习代理:

使用一个批评评论家

rlqvalueerepresentation目的。使用一个指定代理选项

rlqagentoptions.目的。使用一个创建代理

rlqagent.目的。

培训算法

Q学习代理使用以下培训算法。要配置培训算法,请使用arlqagentoptions.目的。

初始化评论家问:(S.那一种)随机值。

对于每次训练集:

设置初始观察S.。

对集发集的每个步骤重复以下内容S.是终端状态。

目前的观察S.,选择一个随机动作一种有概率ε.。否则,选择批评值函数最大的操作。

指定ε.及其衰减率,使用

epsilongredyexpliation.选项。执行动作一种。遵守奖励R.和下一次观察S'。

如果S'是终端状态,设置值函数目标y到R.。否则,将它设置为

设置折扣因素γ., 使用

贴纸物选项。计算批评批评参数更新。

使用学习率更新评论家α.。

通过设置创建批评批评表示时,请指定学习率

学习选项在rlrepresentationOptions.目的。设置观察S.到S'。