基于YOLO v2深度学习的目标检测

此示例显示如何训练you only look once(YOLO)v2对象检测器。

深度学习是一种强大的机器学习技术,可以用来训练健壮的目标探测器。有几种目标检测技术,包括Faster R-CNN和you only look once (YOLO) v2。这个例子训练YOLO v2车辆检测器使用trainYOLOv2ObjectDetector函数。有关更多信息,请参见YOLO v2入门.

下载Pretrained探测器

下载一个预先训练过的检测器,以避免等待训练完成。如果你想训练探测器,设置doTraining变量为true。

doTraining=false;如果~ doTraining & & ~存在(“Yolov2Resnet50车辆示例_19b.垫”,“文件”) disp (“下载预训练探测器(98 MB)……”);pretrainedURL =“//www.tianjin-qmedu.com/万博1manbetxsupportfiles/vision/data/yolov2ResNet50VehicleExample_19b.mat”; 韦伯萨夫(“Yolov2Resnet50车辆示例_19b.垫”,训练前;结束

加载数据集

本例使用一个包含295张图像的小型车辆数据集。这些图像中有许多来自加州理工学院汽车1999年和2001年的数据集,可以在加州理工学院计算视觉中心获得网站,由Pietro Perona创作并获得许可使用。每个图像包含一个或两个已标记的车辆实例。一个小的数据集对于探索YOLO v2训练过程很有用,但在实践中,需要更多标记的图像来训练健壮的检测器。解压缩车辆图像,加载车辆地面真实数据。

解压缩vehicleDatasetImages.zipdata =负载(“vehicleDatasetGroundTruth.mat”);vehicleDataset = data.vehicleDataset;

车辆数据存储在两列表格中,其中第一列包含图像文件路径,第二列包含车辆边界框。

%显示数据集的前几行。vehicleDataset (1:4,:)

ans =4×2表目前,UUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUUjpg'}{1×4双精度}

%将完整路径添加到本地车辆数据文件夹。vehicleDataset.imageFilename=fullfile(pwd,vehicleDataset.imageFilename);

将数据集分解为训练集、验证集和测试集。选择60%的数据用于训练,10%用于验证,其余的用于测试训练过的检测器。

rng (0);shuffledIndices = randperm(高度(vehicleDataset));idx = floor(0.6 * length(shuffledIndices));trainingIdx = 1: idx;trainingDataTbl = vehicleDataset (shuffledIndices (trainingIdx):);validationIdx = idx+1: idx+1 + floor(0.1 * length(shuffledIndices));validationDataTbl = vehicleDataset (shuffledIndices (validationIdx):);testdx = validationIdx(end)+1: length(shuffledIndices);testDataTbl = vehicleDataset (shuffledIndices (testIdx):);

使用imageDatastore和Boxlabeldata商店创建用于在训练和评估期间加载图像和标签数据的数据存储。

imdsTrain = imageDatastore (trainingDataTbl {:,“imageFilename”}); bldsTrain=boxLabelDatastore(培训数据TBL(:,“车辆”));imdsValidation = imageDatastore (validationDataTbl {:,“imageFilename”}); bldsValidation=boxLabelDatastore(validationDataTbl(:,“车辆”));imdsTest = imageDatastore (testDataTbl {:,“imageFilename”});bldsTest = boxLabelDatastore (testDataTbl (:,“车辆”));

组合图像和框标签数据存储。

trainingData =结合(imdsTrain bldsTrain);validationData =结合(imdsValidation bldsValidation);testData =结合(imdsTest bldsTest);

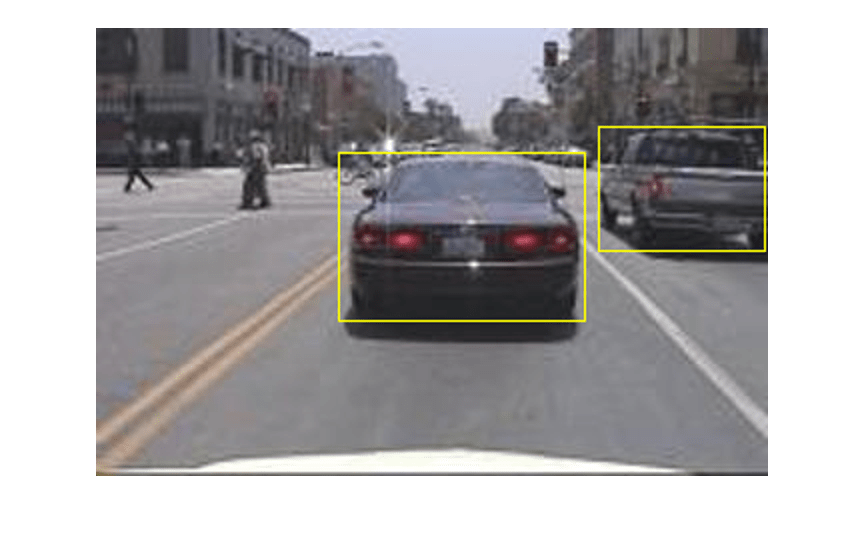

显示其中一个训练图像和框标签。

data=read(trainingData);I=data{1};bbox=data{2};annotatedImage=insertShape(I,“矩形”, bbox);annotatedImage = imresize (annotatedImage 2);图imshow (annotatedImage)

创建YOLO v2对象检测网络

YOLO v2对象检测网络由两个子网组成。特征提取网络,然后是检测网络。特征提取网络通常是预先训练好的CNN(详情请参见预先训练的深度神经网络(深度学习工具箱)).本例使用ResNet-50进行特征提取。您还可以使用其他预先训练过的网络,如MobileNet v2或ResNet-18,也可以根据应用程序需求使用。与特征提取网络相比,检测子网络是一个较小的CNN,由几个卷积层和针对YOLO v2的层组成。

使用约洛夫2层功能,通过预先训练的ResNet-50特征提取网络,自动创建YOLO v2对象检测网络。约洛夫2层要求您指定几个用于参数化YOLO v2网络的输入:

网络输入大小

锚箱

特征提取的网络

首先,指定网络输入大小和类的数量。在选择网络输入尺寸时,考虑网络本身所需要的最小尺寸、训练图像的尺寸以及在所选尺寸下处理数据所需要的计算代价。在可行的情况下,选择一个与训练图像尺寸相近且大于网络所需输入尺寸的网络输入尺寸。为了减少运行示例的计算成本,指定一个网络输入大小[224 224 3],这是运行网络所需的最小大小。

inputSize = [224 224 3];

定义要检测的对象类的数量。

numClasses =宽度(vehicleDataset) 1;

请注意,本例中使用的训练图像大于224 x 224,并且大小不一,因此必须在训练前的预处理步骤中调整图像大小。

下一步,使用估计锚箱根据训练数据中对象的大小估计锚定框。要考虑在训练之前调整图像的大小,请调整训练数据的大小以估计锚定框。使用变换对训练数据进行预处理,定义锚盒的数量并对锚盒进行估计。使用支持函数将训练数据调整为网络的输入图像大小万博1manbetxpreprocessData.

trainingDataForEstimation =变换(trainingData @(数据)preprocessData(数据、inputSize));numAnchors = 7;[anchorBoxes, meanIoU] = estimateAnchorBoxes(trainingdatafestimation, numAnchors)

anchorBoxes =7×2162 136 85 80 149 123 43 32 65 63 117 105 33 27

meanIoU = 0.8472

有关选择锚框的更多信息,请参见根据训练数据估计锚盒(计算机视觉工具箱™)和用于目标检测的锚盒.

现在,使用resnet50加载预先训练的ResNet-50模型。

featureExtractionNetwork=resnet50;

选择“activation_40_relu”作为特征提取层,代替后的各层“activation_40_relu”与检测子网。该特征提取层输出特征地图,该地图以16的系数进行下采样。这种下采样量在空间分辨率和提取特征的强度之间是一种很好的折衷,因为在网络更深处提取的特征以空间分辨率为代价编码更强的图像特征。选择最佳特征提取层需要进行实证分析。

featureLayer =“activation_40_relu”;

创建YOLO v2对象检测网络

lgraph = yolov2Layers (inputSize numClasses、anchorBoxes featureExtractionNetwork, featureLayer);

您可以使用analyzeNetwork或来自Deep Learning工具箱的Deep Network Designer™.

如果需要对YOLO v2网络架构进行更多的控制,可以使用“Deep network Designer”手工设计YOLO v2检测网络。有关更多信息,请参见设计YOLO v2检测网络.

数据扩充

数据扩充用于通过在训练期间随机变换原始数据来提高网络精度。通过使用数据扩充,您可以向训练数据添加更多种类,而无需实际增加标记训练样本的数量。

使用变换通过水平随机翻转图像和相关的框标签来增加训练数据。注意,数据扩充并不适用于测试和验证数据。理想情况下,测试和验证数据应该能够代表原始数据,并且不作任何修改,以便进行公正的评估。

augmentedTrainingData=转换(trainingData,@augmentData);

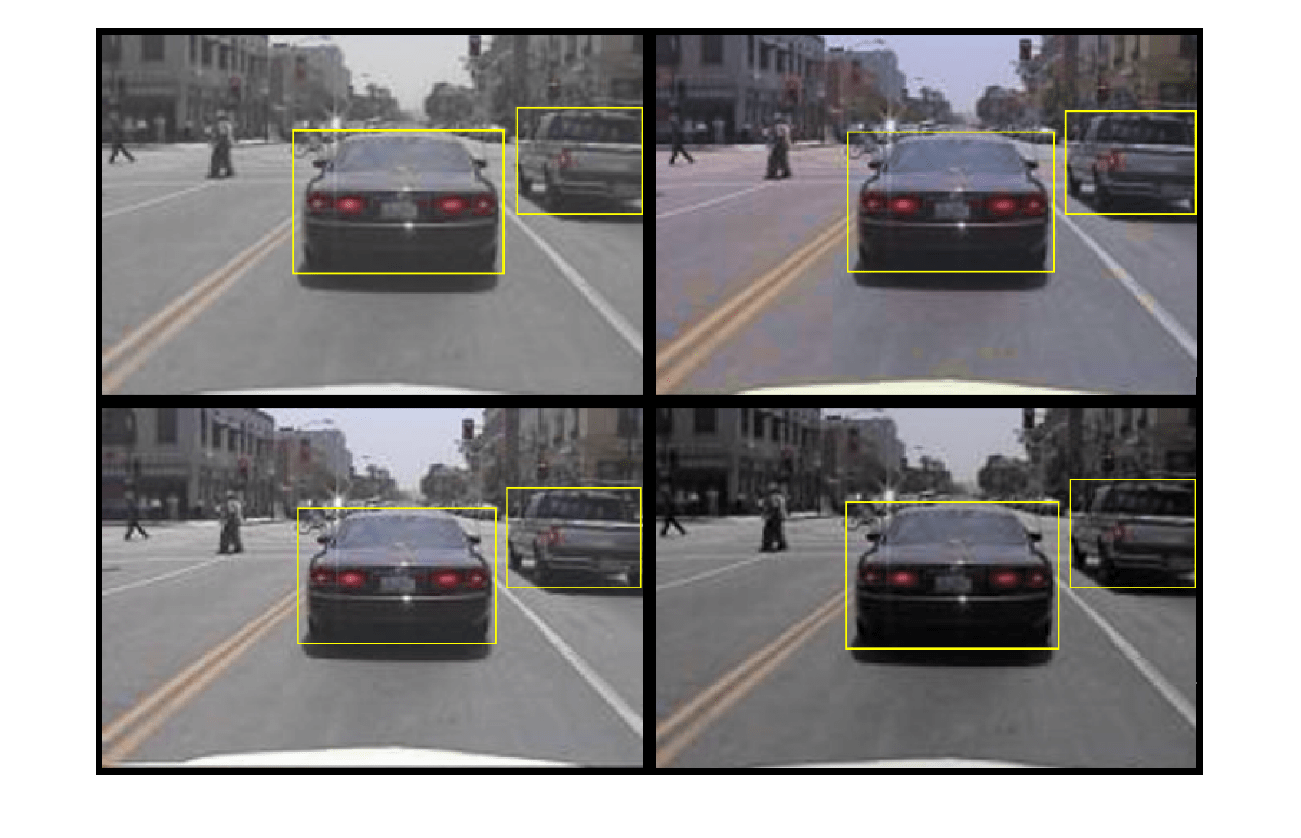

多次读取同一图像并显示增强的训练数据。

%可视化增强图像。augmentedData =细胞(4,1);为k = 1:4 data = read(augmentedTrainingData);augmentedData {k} = insertShape(数据{1},“矩形”、数据{2});重置(augmentedTrainingData);结束图蒙太奇(augmentedData,“BorderSize”,10)

训练数据预处理

预处理增强后的训练数据和验证数据,为训练做准备。

预处理训练数据=转换(增强训练数据,@(数据)预处理数据(数据,输入大小));preprocessedValidationData=转换(validationData,@(data)preprocessData(data,inputSize));

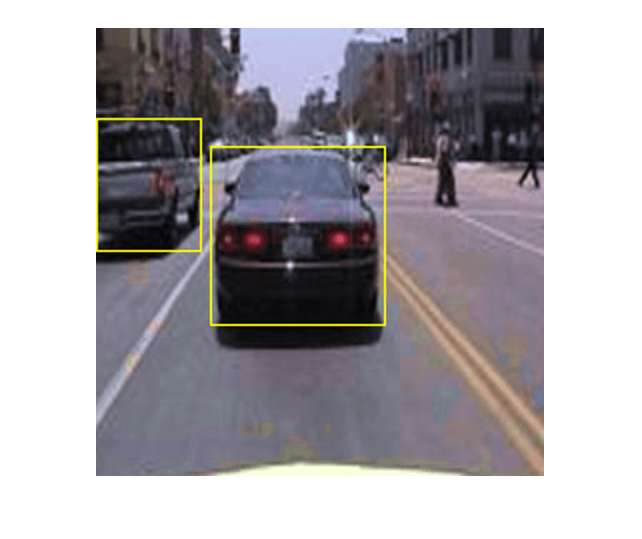

读取预处理的训练数据。

data =阅读(preprocessedTrainingData);

显示图像和边框。

我={1}数据;bbox ={2}数据;annotatedImage = insertShape(我“矩形”, bbox);annotatedImage = imresize (annotatedImage 2);图imshow (annotatedImage)

列车YLOV2目标探测器

使用trainingOptions指定网络培训选项。设置“ValidationData”到预处理的验证数据。设置“CheckpointPath”到一个临时地点。这样可以在培训过程中保存部分经过培训的探测器。如果培训被中断,例如断电或系统故障,您可以从保存的检查点恢复培训。

选择= trainingOptions (“个”,...“MiniBatchSize”, 16岁,....“InitialLearnRate”,1e-3,...“MaxEpochs”,20,...“CheckpointPath”tempdir,...“ValidationData”, preprocessedValidationData);

使用trainYOLOv2ObjectDetector功能训练YOLO v2对象检测器doTraining是真的。否则,加载预训练的网络。

如果doTraining%培训YOLO v2检测仪。[检测器,信息]=TrainyLov2Object检测器(预处理的训练数据、lgraph、选项);其他的%负载预训练检测器为例。pretrained =负载(“Yolov2Resnet50车辆示例_19b.垫”);检测器=预训练检测器;结束

这个例子是在具有12gb内存的NVIDIA™Titan X GPU上验证的。如果你的GPU有更少的内存,你可能会耗尽内存。如果发生这种情况,降低“MiniBatchSize”使用trainingOptions功能。使用此设置培训此网络大约需要7分钟。培训时间因您使用的硬件而异。

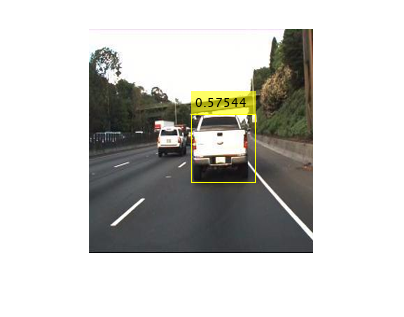

作为一个快速测试,在测试图像上运行检测器。确保将图像调整为与训练图像相同的大小。

我= imread (“highway.png”); I=imresize(I,输入大小(1:2));[b盒,分数]=检测(检测器,I);

显示结果。

I=插入对象注释(I,“矩形”bboxes,分数);图imshow(我)

使用测试集评估检测器

评估训练的目标检测器在一组大的图像,以衡量性能。计算机视觉工具箱™提供对象检测器评估功能,以测量常见的指标,如平均精度(evaluateDetectionPrecision)并记录平均未命中率(evaluateDetectionMissRate)。对于此示例,请使用平均精度度量来评估性能。平均精度提供了一个单一的数字,该数字结合了检测器进行正确分类的能力(精度)和检测器查找所有相关对象的能力(召回)。

对测试数据应用与训练数据相同的预处理变换。请注意,数据扩充不应用于测试数据。测试数据应代表原始数据,且不作修改,以便进行无偏评估。

preprocessedTestData=转换(testData,@(data)preprocessData(data,inputSize));

在所有测试图像上运行检测器。

检测结果=检测(检测器,预处理的检测数据);

评估对象探测器使用平均精度度量。

[ap,召回率,精密度]=评估检测精密度(检测结果,预处理检测数据);

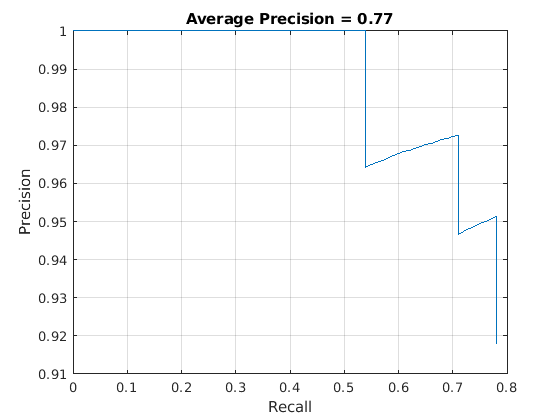

精度/召回(PR)曲线突出显示了检测器在不同召回水平下的精度。理想的精度在所有召回水平下为1。使用更多数据有助于提高平均精度,但可能需要更多的训练时间。绘制PR曲线。

图表(召回率、精度)xlabel(“召回”) ylabel (“精确性”网格)在…上标题(sprintf ('平均精度= %.2f'据美联社)),

代码生成

一旦对检测器进行了培训和评估,您就可以为检测器生成代码Yolov2物体检测器使用GPU编码器™。看到使用YOLO v2生成目标检测代码(GPU编码器)例如更多的细节。

万博1manbetx辅助功能

函数B = augmentData (A)%应用随机水平翻转和随机X/Y缩放。盒子,%如果重叠超过0.25,则将剪裁边界外的缩放。此外,抖动图像颜色。B =细胞(大小(A));我= {1};深圳=大小(I);如果numel(sz)==3 && sz(3) ==3 I = jitterColorHSV(I,...“对比度”,0.2,...“颜色”0,...“饱和”,0.1,...“亮度”, 0.2);结束%随机翻转和缩放图像。tform=随机仿射2d(“外部选择”符合事实的“规模”1.1 [1]);tform溃败= affineOutputView(深圳,“BoundsStyle”,“中心输出”);B {1} = imwarp (tform,我“OutputView”,溃败);%如果需要,请清理方框数据。A{2} = helperSanitizeBoxes(A{2}, sz);对方框应用相同的转换。[B{2},索引]=bboxwarp(A{2},tform,rout,“重叠阈值”, 0.25);B{3} ={3}(指标);%仅当通过扭曲移除所有框时,才返回原始数据。如果isempty(indices) B = A;结束结束函数数据=预处理数据(数据,targetSize)%调整图像和包围框的大小为targetSize。sz=大小(数据{1}[12]);比例=目标尺寸(1:2)。/sz;data{1}=imresize(data{1},targetSize(1:2));%如果需要,请清理方框数据。{2} = helperSanitizeBoxes数据(数据{2},sz);将方框大小调整为新的图像大小。数据{2}=bboxresize(数据{2},比例);结束

工具书类

[1] 雷蒙、约瑟夫和阿里·法哈迪。YOLO9000:更好、更快、更强2017 IEEE计算机视觉与模式识别大会(CVPR), 6517–25. 檀香山,你好:IEEE,2017年。https://doi.org/10.1109/CVPR.2017.690.