主要内容

flattenLayer

平层

描述

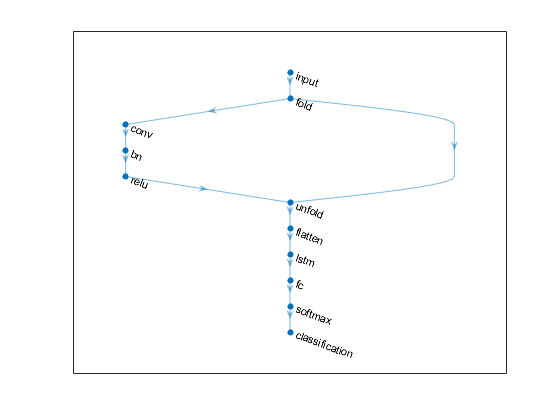

扁平层将输入的空间尺寸塌陷到通道尺寸中。

例如,如果该层的输入是H-经过-W-经过-C-经过-N-经过-年代数组(图像序列),则平展的输出为(H*W*C)———N-经过-年代数组中。

该层仅支持序列输入。万博1manbetx

创建

属性

对象的功能

例子

扩展功能

另请参阅

Bilstmlayer.|classifyAndUpdateState|gruLayer|lstmLayer|predictAndUpdateState|重置静止|sequenceFoldingLayer|sequenceInputLayer|sequenceUnfoldingLayer

介绍了R2019a