主要内容

rlddpgagent.

深度确定性政策梯度加固学习代理

描述

深度确定性政策梯度(DDPG)算法是一个演员 - 评论家,无模型,在线,禁止策略加强学习方法,这些禁止措施方法计算了最大化长期奖励的最佳政策。动作空间只能是连续的。

有关更多信息,请参阅深度确定性政策梯度代理。有关不同类型的强化学习代理商的更多信息,请参阅加固学习代理人。

创建

句法

描述

从观察和行动规范创建代理

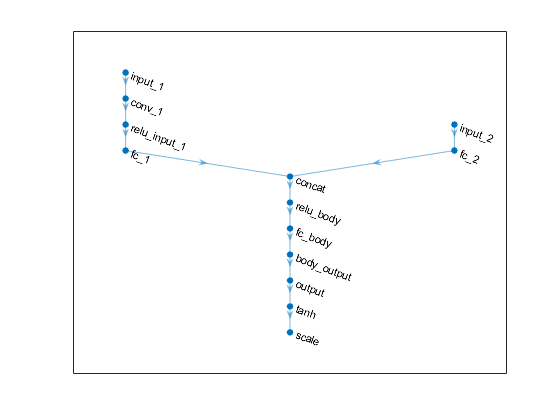

代理人= rlddpgagent(观察税收那ActionInfo.)观察税收和行动规范ActionInfo.。

代理人= rlddpgagent(观察税收那ActionInfo.那初学者)初学者目的。有关初始化选项的详细信息,请参阅rlagentinitializationOptions.。

指定代理选项

代理人= rlddpgagent(___那代理选项)代理选项财产到代理选项输入参数。在上一个语法中的任何输入参数后使用此语法。

输入参数

特性

对象功能

火车 |

在指定环境中列车加固学习代理 |

SIM |

在指定环境中模拟培训的钢筋学习代理 |

努力 |

从代理商或演员代表获取行动给定环境观察 |

工作者 |

获取钢筋学习代理人的演员代表 |

setActor. |

设置钢筋学习代理的演员代表 |

透镜 |

获取钢筋学习代理人的批评奖学金 |

setcritic. |

设定批评批评学习代理的代表 |

生成policyfunction. |

创建评估培训的强化学习代理策略的功能 |

例子

也可以看看

深网络设计师|rlagentinitializationOptions.|rlddpgagentoptions.|RLDETerminyActorRepresentation|rlqvalueerepresentation

在R2019A介绍