主要内容

损失

查找支持向量机(SVM)分类器的分类错误万博1manbetx

语法

描述

l=损失(SVMModel,TBL.,responsevarname.)SVMModel)对表中的预测器数据进行分类TBL.与真正的课程标签相比TBL.ResponseVarName.

损失标准化在类概率TBL.ResponseVarName到之前的概率fitcsvm.用于培训,储存在先的属性SVMModel.

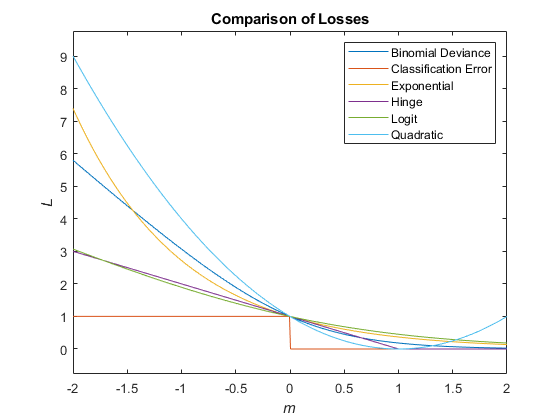

分类损失(l)是一种泛化或再替代质量度量。它的解释取决于损失函数和加权方案,但一般来说,更好的分类器产生更小的分类损失值。

例子

输入参数

更多关于

参考资料

[1] Hastie,T.,R. Tibshirani和J. Friedman。统计学习的要素,第二版。施普林格,纽约,2008。

扩展能力

在R2014A介绍