深度学习导入、导出和定制

从TensorFlow™-Keras、Caffe和ONNX™(Open Neural network Exchange)模型格式导入网络和网络架构。您还可以将训练有素的深度学习工具箱™网络导出为ONNX模型格式。

您可以为您的问题定义自己的自定义深度学习层。您可以使用自定义输出层指定自定义损失函数,并定义带有或不带有可学习参数的自定义层。例如,您可以使用带有加权交叉熵损失的自定义加权分类层来处理类分布不平衡的分类问题。定义自定义层后,您可以检查该层是否有效,GPU兼容,输出正确定义的梯度。

如果培训选项函数不提供任务所需的训练选项,或者自定义输出层不支持所需的丢失函数,则可以定义自定义训练循环。对于无法使用图层图创建的网络,可以将自定义网络定义为函数。要了解更多信息,请参阅万博1manbetx定义自定义训练回路、损耗函数和网络.

功能

主题

自定义图层

了解如何定义自定义深度学习层。

了解如何检查自定义深度学习层的有效性。

这个例子展示了如何定义一个PReLU层并在卷积神经网络中使用它。

此示例演示如何定义自定义加权加法层并将其用于卷积神经网络。

此示例演示如何定义具有平方和误差(SSE)损失的自定义分类输出层,并将其用于卷积神经网络。

此示例演示如何定义和创建具有加权交叉熵损失的自定义加权分类输出层。

这个例子展示了如何定义一个具有平均绝对误差(MAE)损失的自定义回归输出层,并将其用于卷积神经网络。

此示例演示如何定义PReLU层并指定自定义向后函数。

此示例演示如何定义加权分类层并指定自定义反向损失函数。

网络培训和组装

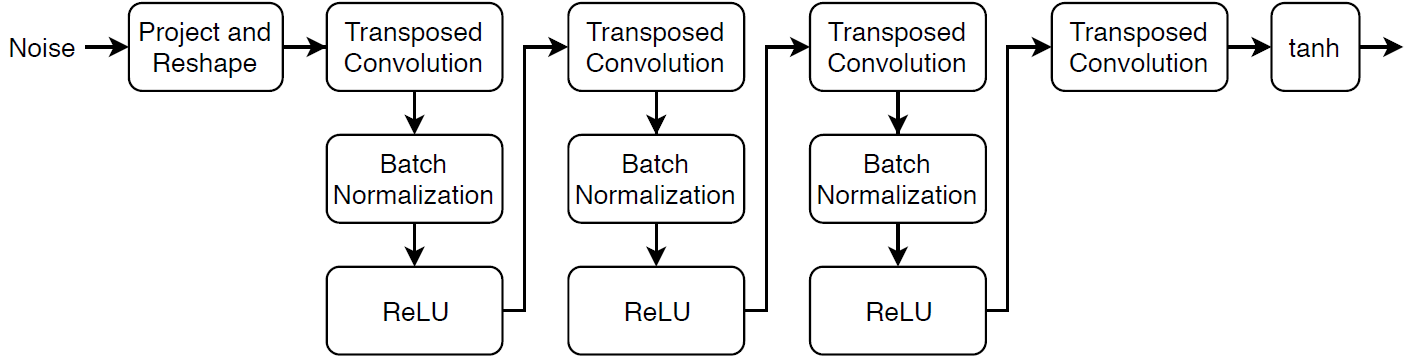

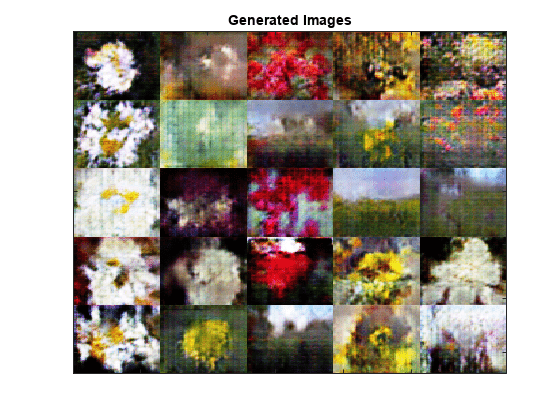

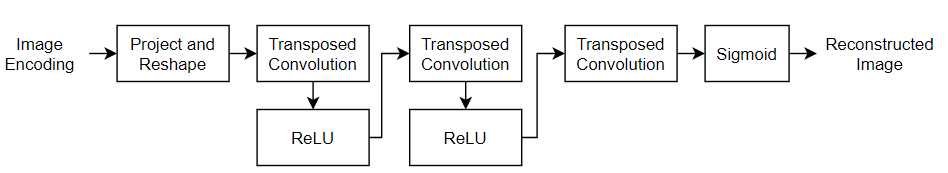

这个例子展示了如何训练生成性对抗网络(GAN)生成图像。

这个例子展示了如何训练条件生成对抗网络(CGAN)来生成图像。

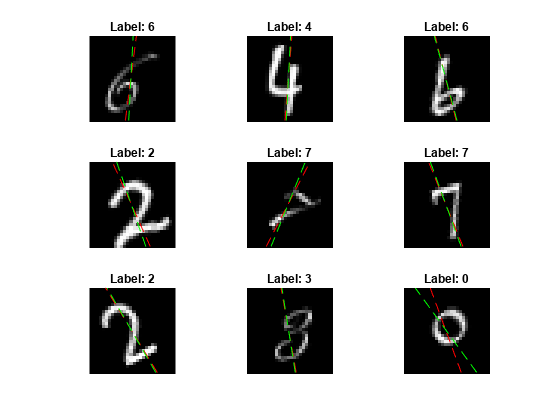

这个例子展示了如何通过降维训练暹罗网络来比较手写数字。

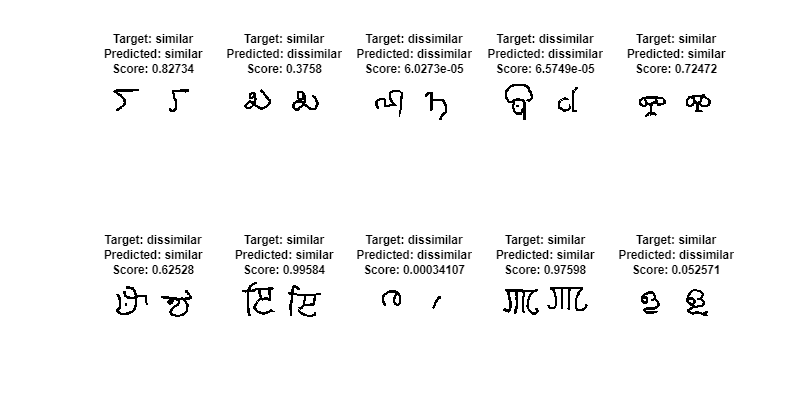

这个例子展示了如何训练暹罗网络来识别手写字符的相似图像。

了解如何使用自动区分定义和自定义深度学习训练循环、损失函数和网络。

了解如何在自定义训练循环中指定常用训练选项。

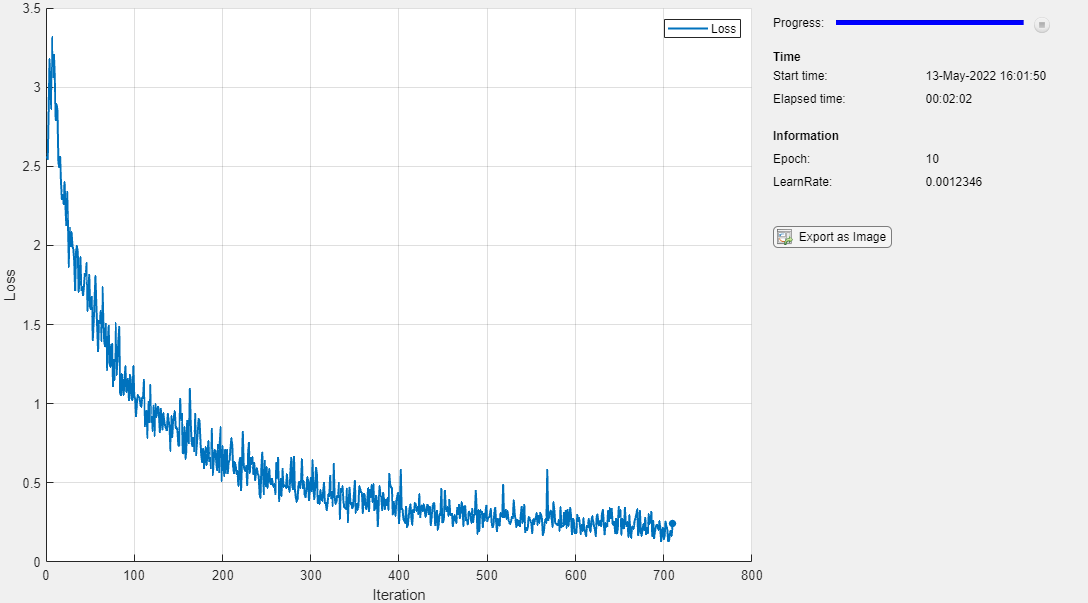

这个例子展示了如何训练一个使用自定义学习速率计划对手写数字进行分类的网络。

此示例显示如何在自定义训练循环中更新网络状态。

这个例子展示了如何使用数据链路网络对象,将数据拆分为小批量。

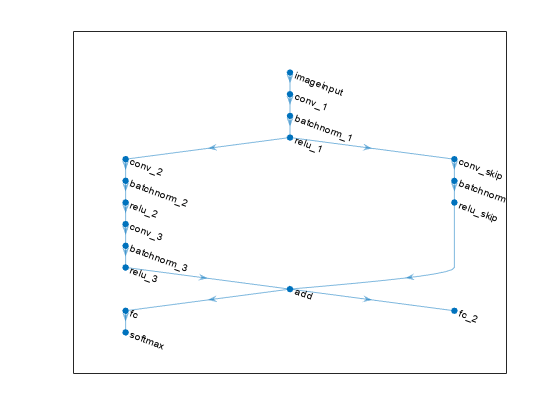

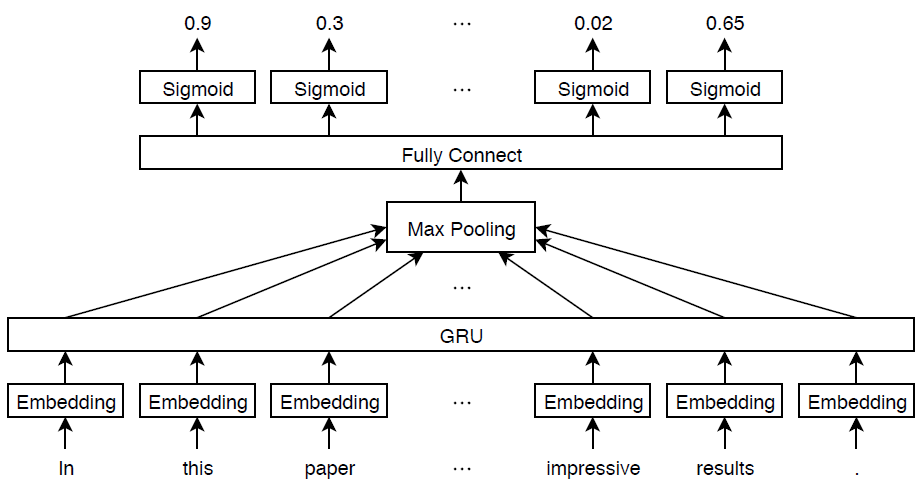

这个例子展示了如何通过使用函数而不是层图或图形来创建和训练深度学习网络数据链路网络.

此示例显示如何更新定义为函数的网络中的网络状态。

这个例子展示了如何使用模型函数进行预测,方法是将数据分割成小批。

这个例子展示了如何使用不同的权重初始化器来训练深度学习网络。

这个例子展示了如何为卷积层创建自定义权重初始化函数,然后是有漏洞的ReLU层。

这个例子展示了如何从预先训练的Keras网络导入层,用自定义层替换不支持的层,并将层组装到一个网络中准备进行预测。万博1manbetx

多输入多输出网络

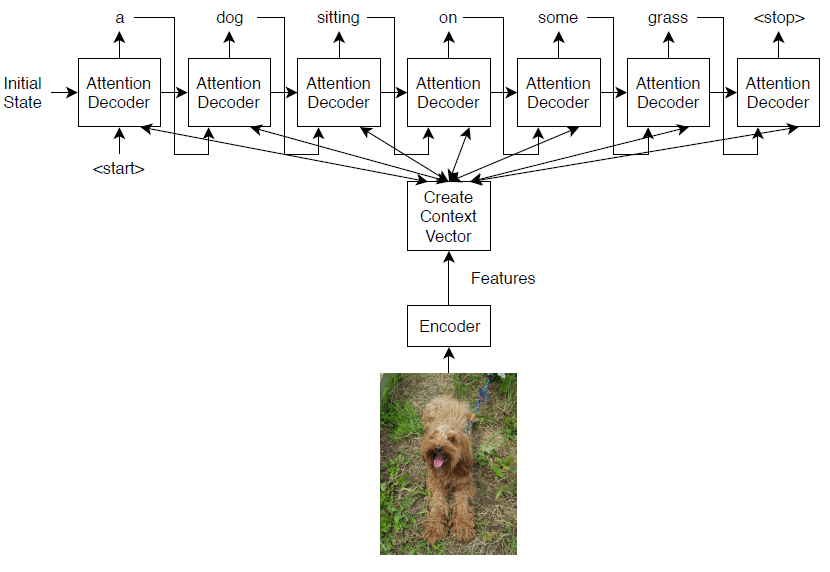

了解如何定义和培训具有多输入或多输出的深度学习网络。

这个例子展示了如何用多个输出来训练一个深度学习网络,预测手写数字的标签和旋转角度。

代替使用模型函数进行预测,你可以将网络组装成一个达格网络准备好使用函数层图和装配网络功能。

自动微分

了解自动差异化是如何工作的。

如何在深度学习中使用自动微分。

查看支持的函数列表万博1manbetxdlarray对象。

这个例子展示了如何使用梯度加权类激活映射(grade - cam)技术来理解为什么深度学习网络会做出分类决策。