深度学习自定义训练循环

自定义深度学习训练循环和损失函数

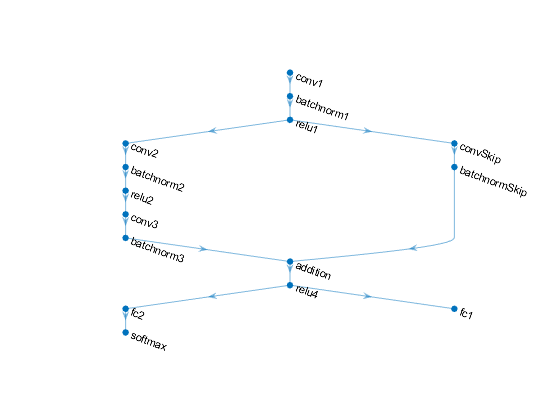

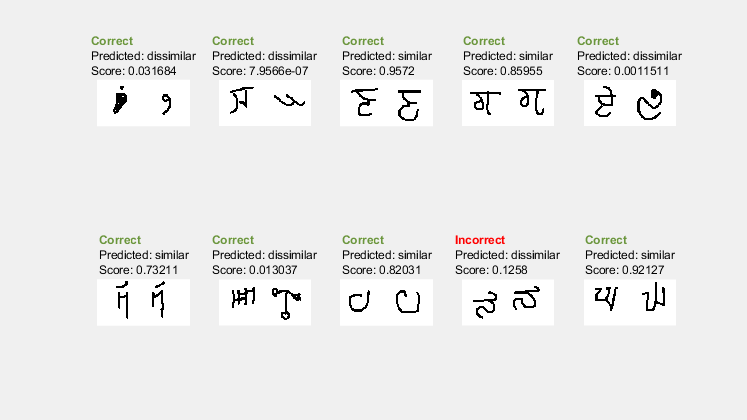

如果trainingOptions功能不提供训练选项,你需要你的任务,或自定义输出层不支持所需要的损失函数,你可以定义一个自定义训练循环。万博1manbetx的网络不能使用层创建图表,您可以自定义网络定义为一个函数。欲了解更多,请看自定义训练循环,损失函数和网络。

功能

主题

自定义训练循环

- 火车深度学习模型在MATLAB

学习如何培训深入学习模型在MATLAB®。 - 自定义训练循环,损失函数和网络

学习如何定义和定制深度学习训练循环,损失函数和网络使用自动分化。 - 列车网络的使用自定义训练循环

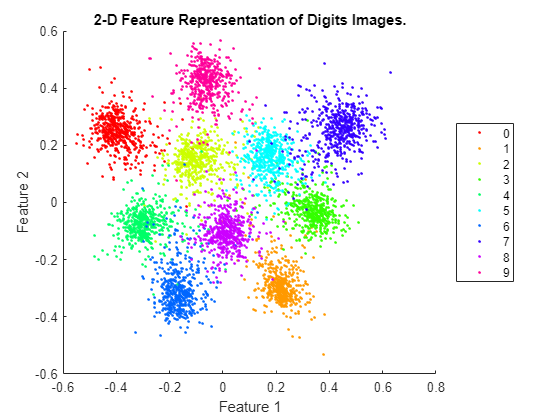

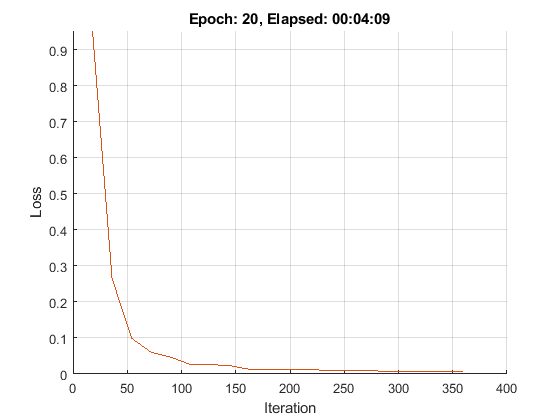

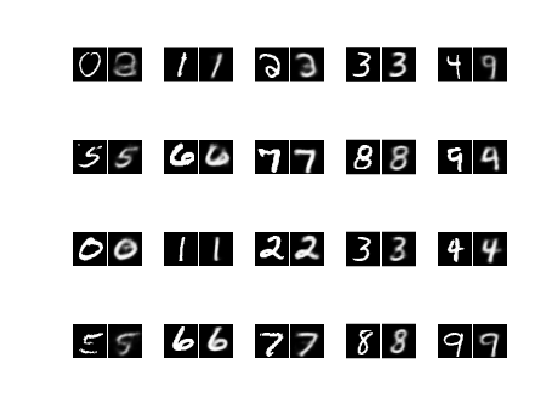

这个例子展示了如何训练网络,把手写的数字和一个定制的学习速率的时间表。 - 指定培训选项自定义训练循环

学习如何指定共同训练选项自定义训练循环。 - 定义模型损失函数自定义训练循环

学习如何定义一个模型损失函数自定义训练循环。 - 在定制培训循环更新批规范化统计

这个例子展示了如何在一个自定义更新网络状态训练循环。 - 使用dlnetwork对象作出预测

这个例子展示了如何使用作出预测dlnetwork对象数据分割到mini-batches。 - 列车网络的多个输出

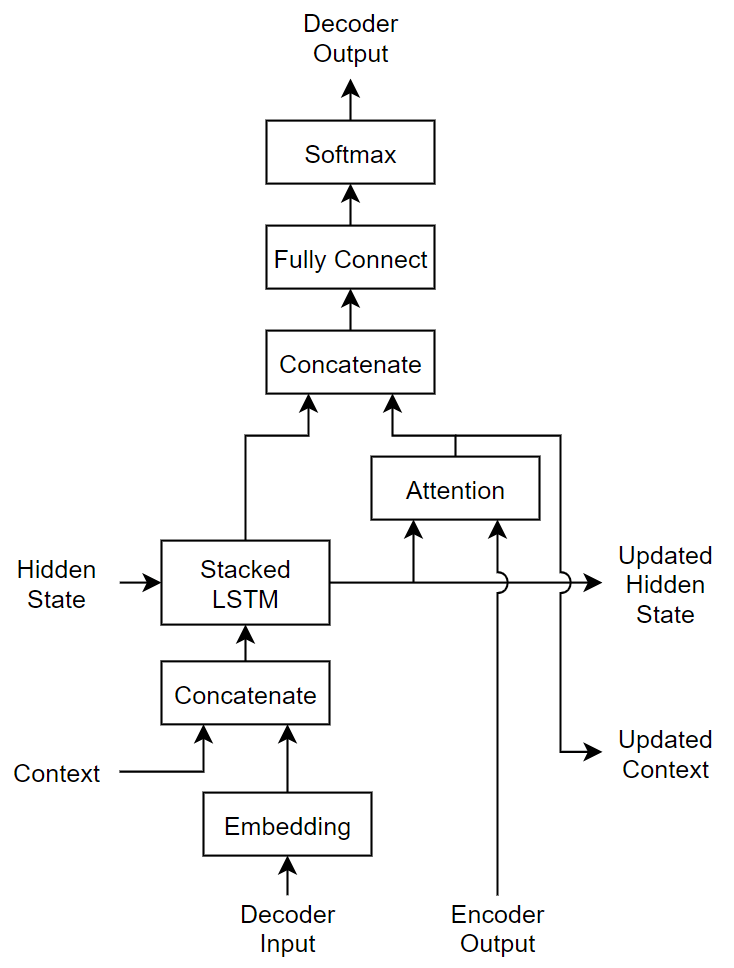

这个例子展示了如何培养深入学习网络和多个输出预测这两个标签和角度旋转的手写数字。 - 分类视频使用深度学习和自定义训练循环

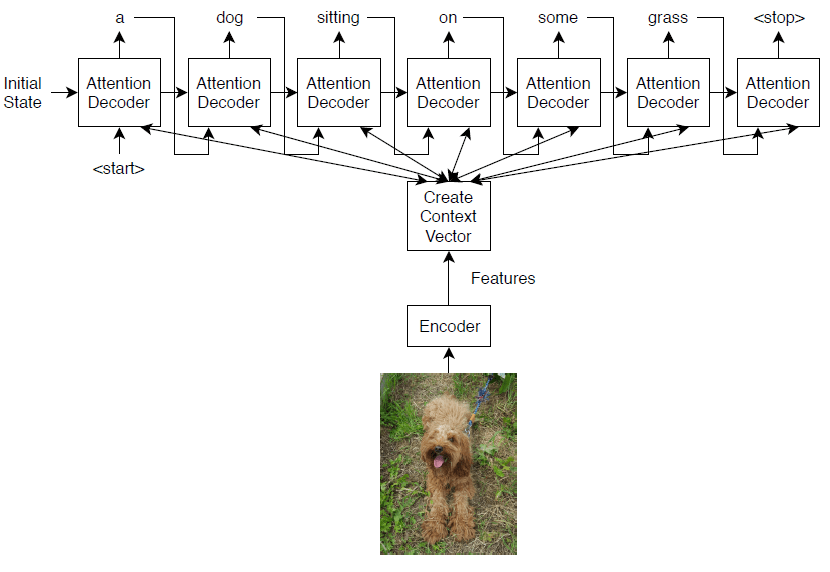

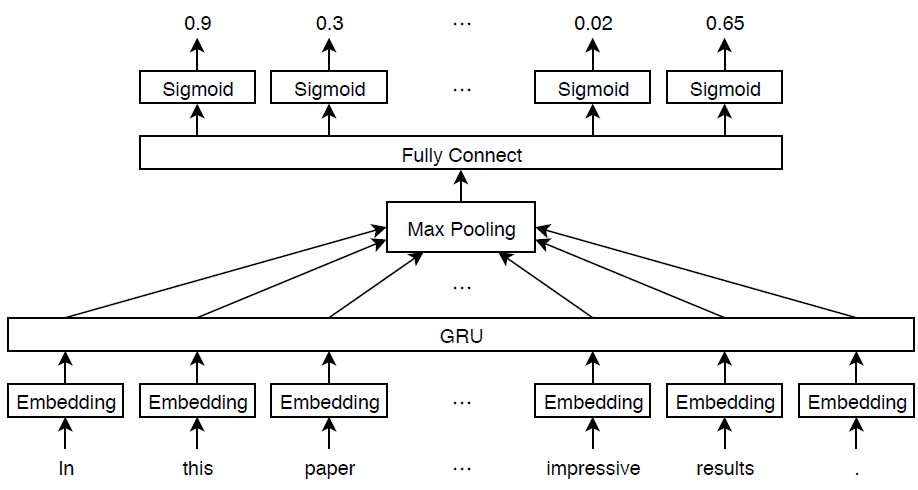

这个例子展示了如何创建一个网络视频分类结合pretrained图像分类模型和序列分类网络。 - 训练图像分类网络健壮的敌对的例子

这个例子展示了如何训练一个神经网络强大的敌对的例子使用快速梯度信号法(FGSM)对抗训练。 - 训练神经颂歌网络

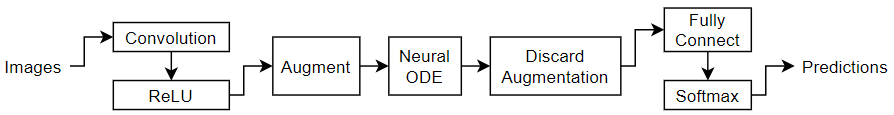

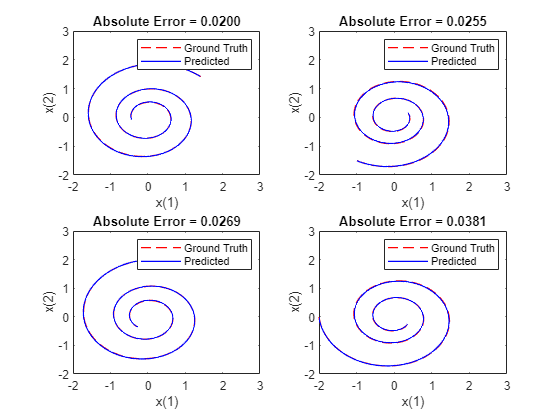

这个例子展示了如何培养一个增广神经常微分方程(ODE)网络。 - 火车健壮的深度与雅可比矩阵正则化学习网络

这个例子展示了如何训练一个神经网络强大的敌对的例子使用雅可比矩阵正则化方案[1]。 - 使用神经网络求解常微分方程

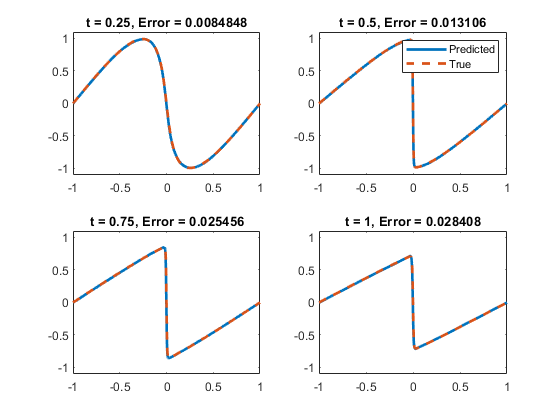

这个例子展示了如何解决一个常微分方程(ODE)使用神经网络。 - 组装多输出网络的预测

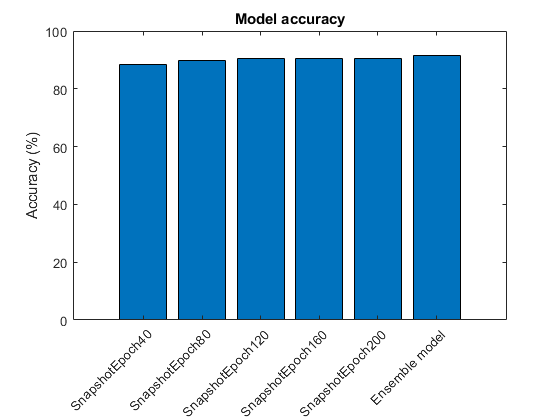

这个例子展示了如何组装多个输出网络的预测。 - 在GPU上运行自定义训练循环和并行

加快定制培训循环运行在GPU,使用多个GPU并行,或集群。

模型函数

- 列车网络的使用模型的功能

这个例子展示了如何创建和火车深入学习网络通过使用函数,而不是一个或一层图dlnetwork。 - 更新批规范化统计使用模型的功能

这个例子展示了如何在网络更新网络状态定义为一个函数。 - 使用函数模型做出预测

这个例子展示了如何使用一个模型预测数据分割到mini-batches函数。 - 初始化函数可学的参数模型

学习如何初始化可学的定制培训循环使用模型函数的参数。

自动分化

- 与dlarray支持函数的列表万博1manbetx

视图的功能列表的支持万博1manbetxdlarray对象。 - 自动分化背景

学习自动分化是如何工作的。 - 在深度学习工具箱使用自动分化

在深入学习如何使用自动分化。

深度学习函数加速度

- 深度学习功能定制培训循环的加速

加速模型的功能和模型损失函数自定义训练循环缓存和重用的痕迹。 - 加快定制培训循环功能

这个例子展示了如何加速深循环学习自定义训练和预测功能。 - 检查加速深度学习函数输出

这个例子展示了如何检查加速功能的输出匹配底层函数的输出。 - 评估性能加速深度学习的功能

这个例子展示了如何评估使用加速功能的性能收益。