在Simulink中使用合成雷达和视觉数据的传感器融合万博1manbetx

这个例子展示了如何在Simulink®中使用自动驾驶工具箱™实现跟踪和传感器融合的合成数据模拟。万博1manbetx它紧跟基于合成雷达和视觉数据的传感器融合MATLAB®的例子。

简介

模拟合成雷达和视觉检测提供了创建罕见和潜在危险事件的能力,并使用它们测试车辆算法。这个例子涵盖了Simulink中的整个合成数据工作流。万博1manbetx

模型的建立和概述

在运行此示例之前,驾驶场景设计中定义的相同场景基于合成雷达和视觉数据的传感器融合.然后将该场景中的道路和参与者保存到场景文件中OpenLoop.mat.

的场景的读者块从保存的文件中读取参与者姿势数据。该块将演员的姿势从场景的世界坐标转换为自我车辆坐标。演员的姿势在由块生成的总线上传输。

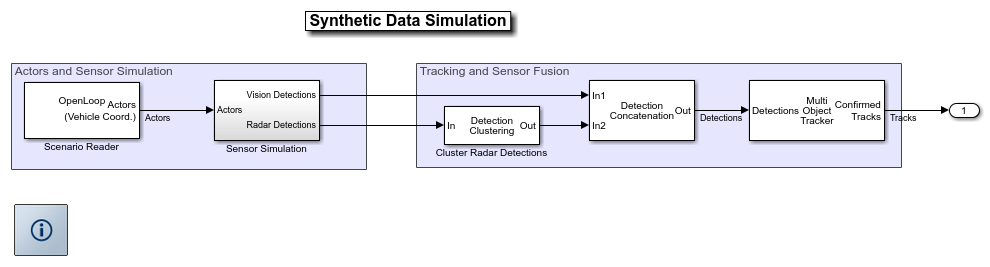

演员姿态被传感器仿真子系统使用,该子系统生成合成雷达和视觉检测。模拟检测在输入端连接到多对象跟踪器块,其输出是已确认的轨迹列表。最后,鸟瞰瞄准镜将演员、视觉和雷达探测、确认的轨道和道路边界可视化。下面几节描述了这个模型的主要模块。

模拟传感器检测

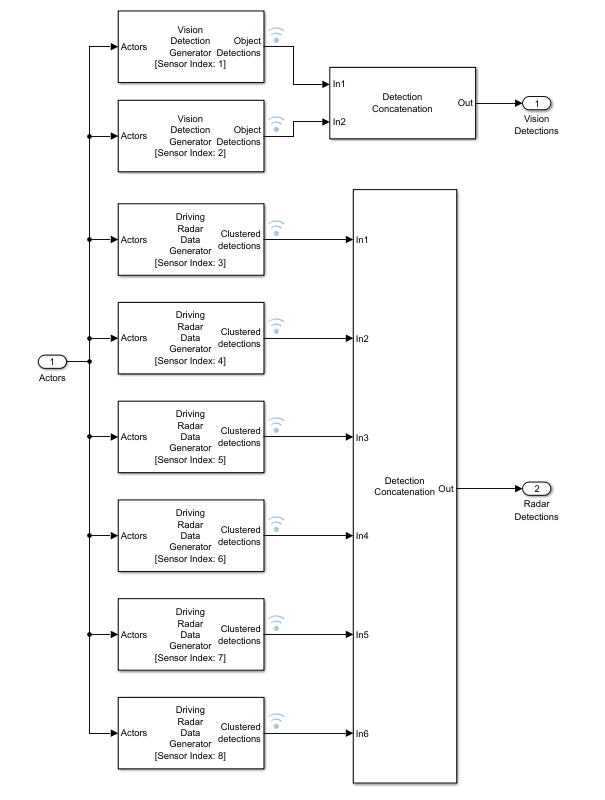

在这个例子中,你模拟一辆自我车辆,它有6个雷达传感器和2个覆盖360度视野的视觉传感器。传感器有一些重叠和覆盖差距。ego车辆在车辆的前部和后部都配备了一个远程雷达传感器和一个视觉传感器。车辆的每一侧有两个近程雷达传感器,每个覆盖90度。两侧各有一个传感器,从车辆中间覆盖到后部。两侧的另一个传感器从车辆中间向前覆盖。

当您打开Sensor Simulation子系统时,您可以看到这两个视觉检测发生器块,配置为从自我车辆的前面和后面产生探测。视觉检测发生器的输出连接到一个检测连接块。接下来,子系统包含6个雷达探测发生器块,配置如前一段所述。雷达探测生成器的输出被连接起来,然后使用检测聚类块进行聚类。

跟踪与传感器融合

来自视觉和雷达传感器的检测必须首先连接起来,形成一个单一的输入多目标跟踪块。连接是使用额外的检测连接块完成的。

多对象跟踪器块负责融合来自所有检测的数据,并跟踪自我车辆周围的对象。多目标跟踪器配置了与相应MATLAB示例中使用的相同参数,基于合成雷达和视觉数据的传感器融合.多对象跟踪器块的输出是一个已确认的跟踪列表。

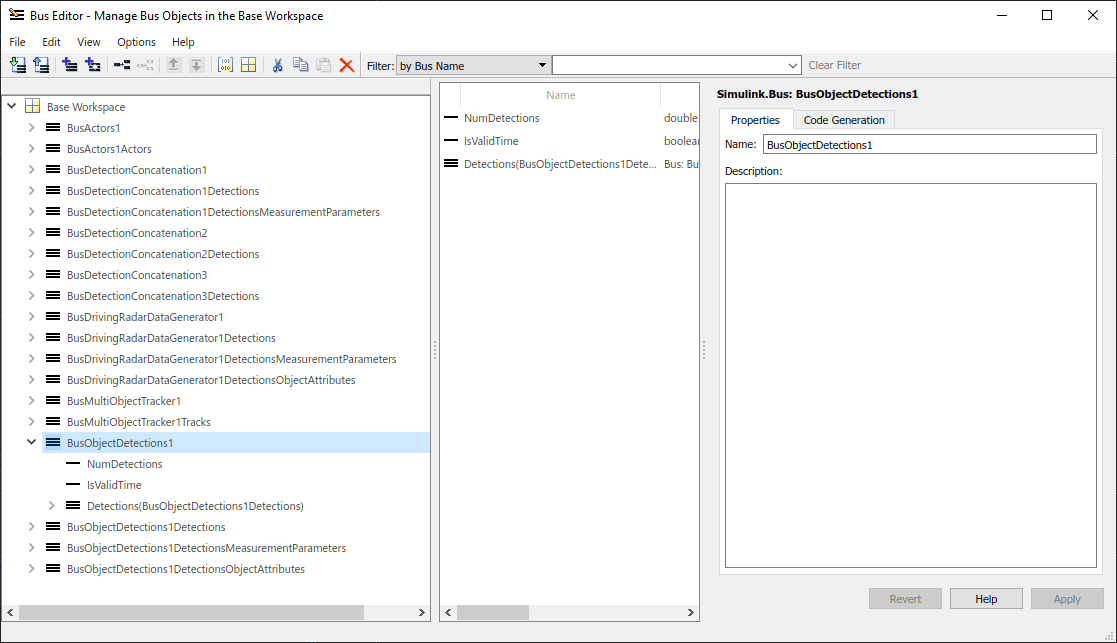

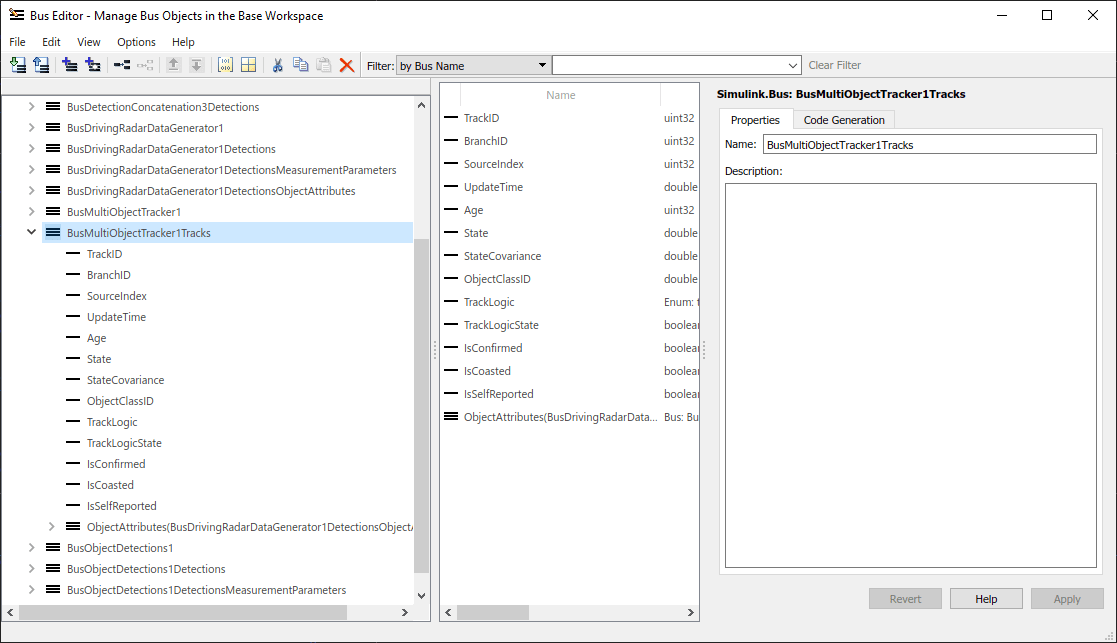

创建和传播总线

本例中各个块的输入和输出都是万博1manbetx仿真软件。公共汽车(万博1manbetx模型)“汽车”,总线被自动创建,它们的名称被传播到使用该总线作为输入的块。当设置为“属性”,可以定义输出总线的名称。下面的图像显示了检测总线、单个检测总线、轨道总线和单个轨道总线。

显示

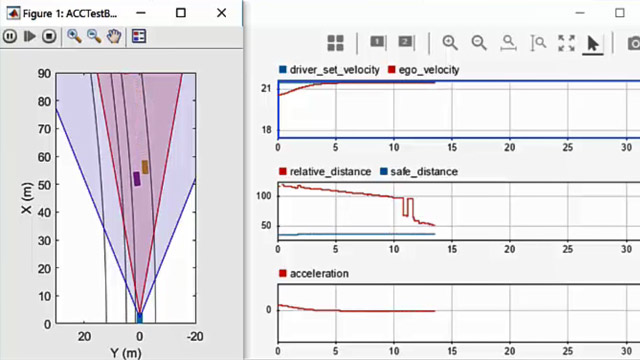

的鸟瞰的范围是一个可以从Simulink工具条打开的模型级可视化工具。万博1manbetx在模拟选项卡,在审查结果,点击鸟瞰的范围.打开作用域后,单击找到信号设置信号。然后运行模拟以显示参与者、视觉和雷达探测、轨道和道路边界。下图显示了本例的鸟瞰范围。