主要内容

rlSACAgent

软演员 - 评论家强化学习代理

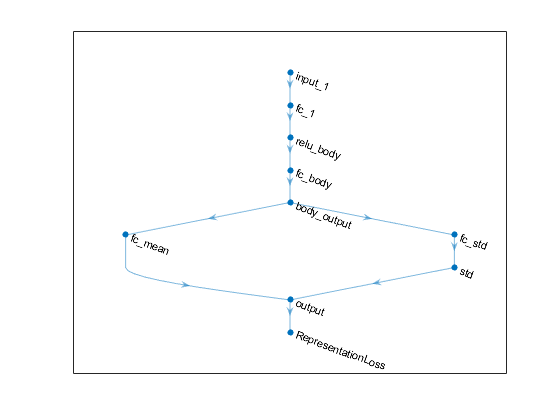

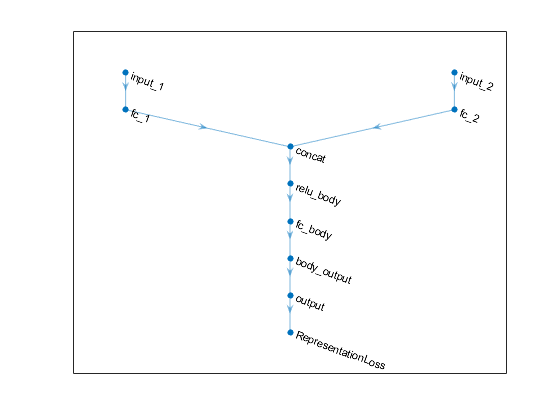

描述

软演员 - 评论家(SAC)算法是一种无型号,在线,违规政策演员 - 批评批评学习方法。SAC算法计算了最佳策略,最大化了长期预期奖励和策略的熵。政策熵是鉴于国家的政策不确定性的衡量标准。更高的熵值促进了更多的探索。最大化奖励和熵余额的探索和利用环境。动作空间只能是连续的。

有关更多信息,请参阅软Actor-Critic代理。

有关不同类型的强化学习代理商的更多信息,请参阅加固学习代理人。

创建

语法

描述

从观察和行动规范创建代理

代理人= rlsacagent(观察税收,ActionInfo.)观察税收和行为规范ActionInfo.。

代理人= rlsacagent(观察税收,ActionInfo.,initoptions.)initoptions.)。

指定代理选项

代理人= rlsacagent(___,agentOptions)

输入参数

特性

对象的功能

例子

另请参阅

深网络设计师|rlagentinitializationOptions.|rlSACAgentOptions|rlstochastorrepresentation|rlvalueerepresentation

介绍了R2019a