选择回归模型选项

选择回归模型类型

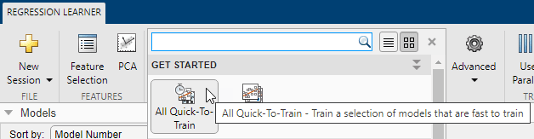

你可以使用回归学习应用程序自动训练你的数据选择不同的模型。使用自动化培训来快速尝试模型类型的选择,然后交互地探索有希望的模型。要开始,请先尝试以下选项:

| 开始回归模型按钮 | 描述 |

|---|---|

| 所有Quick-To-Train |

试所有Quick-To-Train按钮放在第一位。该应用程序训练所有类型的模型,通常是快速训练。 |

| 所有 |

使用所有按钮训练所有可用的不可优化的模型类型。训练每一种类型,不管任何先前训练的模型。可以耗时。 |

要了解有关自动化模型培训的更多信息,请参见自动回归模型训练.

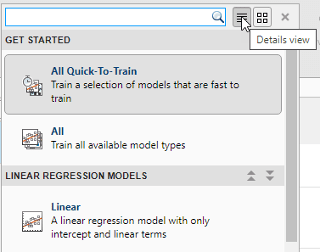

如果您想一次只研究一个模型,或者如果您已经知道您想要的模型类型,您可以选择单个模型或训练相同类型的一组模型。要查看所有可用的回归模型选项,请在回归的学习者选项卡中单击箭头模型类型部分以展开回归模型列表。图库中的非优化模型选项是具有不同设置的预置起点,适用于一系列不同的回归问题。要使用可优化的模型选项和自动调优模型超参数,请参阅回归学习程序中的超参数优化.

为了帮助您为问题选择最佳模型类型,请参阅显示不同回归模型类型的典型特征的表格。在速度、灵活性和可解释性方面做出权衡。最好的模型类型取决于您的数据。

提示

为了避免过度拟合,要寻找一个灵活性较低但提供足够精度的模型。例如,寻找一些简单的模型,如快速且易于解释的回归树。如果模型不能足够准确地预测响应,那么可以选择具有更高灵活性的其他模型,例如集成模型。要控制灵活性,请查看每个模型类型的详细信息。

回归模型类型的特点

要在回归学习器中阅读每个模型的描述,请切换到所有模型预设列表中的详细视图。

提示

的非可优化模型模型类型画廊是预置的起点与不同的设置。在选择了模型类型(比如回归树)之后,尝试训练所有不可优化的预设,看看哪一种可以产生最好的数据模型。

有关工作流说明,请参见在回归学习者应用程序中训练回归模型.

分类预测的支持万博1manbetx

在回归学习者中,所有模型类型都支持分类预测器。万博1manbetx

提示

如果你有有许多独特值的分类预测器,用交互作用或二次项训练线性模型和逐步线性模型可以使用大量的记忆。如果模型训练失败,尝试删除这些分类预测器。

线性回归模型

线性回归模型的预测因子在模型参数中是线性的,易于解释,并能快速做出预测。这些特点使得线性回归模型成为热门模型的首选。然而,这些模型的高度约束形式意味着它们的预测精度通常很低。在拟合线性回归模型后,尝试创建更灵活的模型,如回归树,并比较结果。

提示

在模型类型画廊,点击所有的线性![]() 尝试每一个线性回归选项,看看哪些设置产生最好的模型与您的数据。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个线性回归选项,看看哪些设置产生最好的模型与您的数据。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 模型的灵活性 |

|---|---|---|

| 线性 |

容易 | 非常低的 |

| 线性的交互 |

容易 | 媒介 |

| 鲁棒线性 |

容易 | 非常低。对异常值不太敏感,但训练起来很慢。 |

| 分段线性 |

容易 | 媒介 |

提示

有关工作流示例,请参见使用回归学习程序训练回归树.

高级线性回归选项

回归学习者使用fitlm函数来训练线性、交互线性和鲁棒线性模型。该应用程序使用stepwiselm函数来训练逐步线性模型。

对于线性、交互线性和稳健线性模型,您可以设置以下选项:

条款

指定在线性模型中使用哪些术语。您可以选择:

线性.预测器中有常数项和线性项的相互作用.一个常数项,线性项,和预测器之间的交互项纯二次.一个常数项,一个线性项,一个纯二次项在每个预测器中二次.常数项、线性项和二次项(包括相互作用)

健壮的选项

指定是否使用一个健壮的目标函数,使您的模型对异常值不那么敏感。有了这个选项,拟合方法会自动为那些更可能是异常值的数据点分配更低的权重。

逐步线性回归从一个初始模型开始,并基于这些逐渐增大和减小的模型的解释力,系统地向模型中添加和删除术语。对于逐步线性模型,你可以设置这些选项:

初始条件

指定在逐步过程的初始模型中包含的术语。你可以选择

常数,线性,的相互作用,纯二次,二次.项上界

指定逐步过程可以添加到模型中的术语的最高顺序。你可以选择

线性,的相互作用,纯二次,二次.最大台阶数

指定可在逐步过程中尝试的不同线性模型的最大数目。为了加速训练,试着减少最大的步数。选择较小的最大步骤数会降低您找到一个好的模型的机会。

提示

如果你有有许多独特值的分类预测器,用交互作用或二次项训练线性模型和逐步线性模型可以使用大量的记忆。如果模型训练失败,尝试删除这些分类预测器。

回归树

回归树易于解释,拟合和预测速度快,并且内存使用量低。尝试用更少的大叶子种植更小的树,以防止过度拟合。控件控制叶子的大小最小叶大小设置。

提示

在模型类型画廊,点击所有的树![]() 尝试每一个不可优化的回归树选项,看看哪些设置可以产生最好的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个不可优化的回归树选项,看看哪些设置可以产生最好的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 模型的灵活性 |

|---|---|---|

| 好树 |

容易 | 高 许多小叶子具有高度灵活的响应函数(最小叶子大小为4。) |

| 中树 |

容易 | 媒介 中等大小的叶子,响应函数较不灵活(最小叶子大小为12)。 |

| 粗树 |

容易 | 低 少量大叶,响应函数粗糙(最小叶大小为36)。 |

要预测回归树的响应,从根(开始)节点向下到叶节点。叶节点包含响应的值。

统计和机器学习工具箱™树是二进制的。预测的每一步都需要检查一个预测变量的值。例如,这是一个简单的回归树

这棵树根据两个预测器来预测反应,x1和x2.要进行预测,请从顶部节点开始。在每个节点上,检查预测器的值,以决定遵循哪个分支。当分支到达叶节点时,响应被设置为对应于该节点的值。

你可以通过从应用程序中导出模型来可视化回归树模型,然后输入:

视图(trainedModel。RegressionTree,“模式”,“图”)

提示

有关工作流示例,请参见使用回归学习程序训练回归树.

高级回归树选项

回归学习者应用程序使用fitrtree函数来训练回归树。你可以设置这些选项:

最小叶大小

指定用于计算每个叶节点响应的最小训练样本数。当您生长回归树时,请考虑它的简单性和预测能力。要更改最小叶子大小,请单击按钮或在最小叶大小盒子。

一棵有许多小叶子的优良树通常对训练数据具有很高的准确性。然而,在独立的测试集中,树可能无法显示出可比较的准确性。一棵枝叶繁茂的树往往会过度拟合,它的验证精度往往远低于它的训练(或再替代)精度。

相比之下,大叶子较少的粗树不能获得高的训练精度。但是粗糙的树可以更健壮,因为它的训练精度可以接近一个有代表性的测试集。

提示

减少最小叶大小创建一个更灵活的模型。

代理决定分裂-仅用于丢失数据。

指定决策分割的代理使用。如果数据缺少值,可以使用代理分割来提高预测的准确性。

当您设置代理决定分裂来

在,回归树在每个分支节点上发现最多10个代理分割。要更改代理分割的数量,请单击按钮或在每个节点最大代理数盒子。当您设置代理决定分裂来

找到所有,回归树在每个分支节点找到所有代理分割。的找到所有设置可以使用相当多的时间和内存。

或者,您可以让应用程序通过使用超参数优化自动选择一些模型选项。看到回归学习程序中的超参数优化.

万博1manbetx支持向量机

你可以在回归学习器中训练回归支持向量机(svm)。万博1manbetx线性支持向量机易于解释,但预测精度较低。非线性支持向量机更难以解释,但可以更精确。

提示

在模型类型画廊,点击所有支持向量机![]() 尝试每一个不可优化的SVM选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个不可优化的SVM选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 模型的灵活性 |

|---|---|---|

| 线性支持向量机 |

容易 | 低 |

| 二次支持向量机 |

硬 | 媒介 |

| 立方支持向量机 |

硬 | 媒介 |

| 细高斯支持向量机 |

硬 | 高 允许快速变化的响应功能。内核规模设置为 倍根号(P) / 4,在那里P是预测器的数量。 |

| 介质高斯支持向量机 |

硬 | 媒介 给出一个较不灵活的响应函数。内核规模设置为 sqrt (P). |

| 高斯粗糙支持向量机 |

硬 | 低 给出了刚性响应函数。内核规模设置为 sqrt (P) * 4. |

统计和机器学习工具箱实现线性不敏感的支持向量机回归。该支持向量机忽略小于某个固定数值ε的预测误差。的万博1manbetx支持向量是误差大于ε的数据点。支持向量机用来预测新值的函数只依赖于支持向量。万博1manbetx要了解更多关于SVM回归的知识,请参见理解支持向量机回归万博1manbetx.

提示

有关工作流示例,请参见使用回归学习程序训练回归树.

高级SVM选项

回归学习者使用fitrsvm函数来训练SVM回归模型。

你可以在应用程序中设置这些选项:

核函数

核函数决定了在训练支持向量机之前对数据应用的非线性变换。您可以选择:

高斯径向基函数(RBF)核线性内核,最容易解释二次内核立方内核

箱约束模式

方框约束控制对具有大残差的观测值施加的惩罚。一个更大的框约束提供了一个更灵活的模型。值越小,模型越刚性,对过拟合的敏感性越低。

当箱约束模式被设置为

汽车,应用程序使用启发式过程选择框约束。尝试通过手动指定框约束来调整模型。集箱约束模式来

手册并指定一个值。控件中单击按钮或输入正标量值来更改值手工盒约束盒子。应用程序会自动为你预先选择一个合理的值。尝试稍微增加或减少这个值,看看这是否改进了您的模型。提示

增加框约束值以创建更灵活的模型。

ε模式

小于ε值的预测误差将被忽略,并被视为等于零。值越小,模型就越灵活。

当ε模式被设置为

汽车,该应用程序使用启发式过程来选择内核规模。尝试通过手动指定的值来调整模型。集ε模式来

手册并指定一个值。控件中单击按钮或输入正标量值来更改值手动ε盒子。应用程序会自动为你预先选择一个合理的值。尝试稍微增加或减少这个值,看看这是否改进了您的模型。提示

降低的值,以创建一个更灵活的模型。

内核扩展模式

核规模控制核显著变化的预测器的规模。更小的内核规模提供了更灵活的模型。

当内核扩展模式被设置为

汽车,该应用程序使用启发式过程来选择内核规模。尝试通过手动指定内核规模来调整模型。集内核扩展模式来

手册并指定一个值。控件中单击按钮或输入正标量值来更改值手动内核规模盒子。应用程序会自动为你预先选择一个合理的值。尝试稍微增加或减少这个值,看看这是否改进了您的模型。提示

减小内核尺度值,以创建更灵活的模型。

标准化

标准化预测器会使它们的均值为0,标准差为1。标准化消除了对预测器中任意尺度的依赖,并通常提高了性能。

或者,您可以让应用程序通过使用超参数优化自动选择一些模型选项。看到回归学习程序中的超参数优化.

高斯过程回归模型

你可以在回归学习中训练高斯过程回归(GPR)模型。探地雷达模型通常是高度精确的,但可能很难解释。

提示

在模型类型画廊,点击所有探地雷达模型![]() 尝试每一个不可优化的GPR模型选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个不可优化的GPR模型选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 模型的灵活性 |

|---|---|---|

| 理性的二次 |

硬 | 自动 |

| 平方指数 |

硬 | 自动 |

| Matern 5/2 |

硬 | 自动 |

| 指数 |

硬 | 自动 |

在高斯过程回归中,响应使用函数空间上的概率分布建模。预设的灵活性模型类型图库是自动选择,以提供一个小的训练误差,同时,防止过拟合。要了解更多关于高斯过程回归的知识,请参阅高斯过程回归模型.

提示

有关工作流示例,请参见使用回归学习程序训练回归树.

高级高斯过程回归选项

回归学习者使用fitrgp功能来训练GPR模型。

你可以在应用程序中设置这些选项:

基函数

基函数指定了高斯过程回归模型的先验均值函数的形式。你可以选择

零,常数,线性.尝试选择一个不同的基函数,看看这是否改进了您的模型。核函数

核函数决定响应的相关性,作为预报值之间距离的函数。你可以选择

理性的二次,平方指数,Matern 5/2,Matern 3/2,指数.要了解更多关于内核函数的知识,请参见核(协方差)功能选项.

使用各向同性内核

如果使用各向同性核函数,所有预测器的相关长度尺度都是相同的。使用非各向同性核函数,每个预测变量都有自己独立的相关长度尺度。

使用非各向同性核可以提高模型的准确性,但会使模型适应速度变慢。

要了解更多关于非各向同性核的知识,请看核(协方差)功能选项。

内核模式

您可以手动指定最初的内核参数的值内核规模和信号标准偏差.信号标准差是响应值的先验标准差。默认情况下,应用程序从初始值开始在本地优化内核参数。要使用固定的内核参数,请清除优化数值参数复选框。

当内核扩展模式被设置为

汽车,应用程序使用启发式过程来选择初始内核参数。如果你设置内核扩展模式来

手册,可以指定初始值。单击按钮或在中输入正标量值内核规模盒子和信号标准偏差盒子。如果你通过了使用各向同性内核选中复选框,则无法手动设置内核初始参数。

σ模式

可以手动指定最初的观测噪声标准差值σ.默认情况下,应用程序从初始值开始优化观测噪声的标准偏差。要使用固定的内核参数,请清除优化数值参数复选框。

当σ模式被设置为

汽车,应用程序使用启发式程序选择初始观测噪声的标准差。如果你设置σ模式来

手册,可以指定初始值。单击按钮或在中输入正标量值σ盒子。标准化

标准化预测器会使它们的均值为0,标准差为1。标准化消除了对预测器中任意尺度的依赖,并通常提高了性能。

优化数值参数

通过这个选项,应用程序自动优化GPR模型的数值参数。优化后的参数为基函数,核参数内核规模和信号标准偏差,观测噪声标准差σ.

或者,您可以让应用程序通过使用超参数优化自动选择一些模型选项。看到回归学习程序中的超参数优化.

乐团的树木

你可以在回归学习器中训练回归树的集合。集成模型将许多弱学习者的结果合并成一个高质量的集成模型。

提示

在模型类型画廊,点击所有的集合体![]() 尝试每一个不可优化的集成选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个不可优化的集成选项,看看哪些设置可以产生最佳的数据模型。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 整体方法 | 模型的灵活性 |

|---|---|---|---|

| 提高了树 |

硬 | 最小二乘提高( |

中等到高 |

| 袋装的树木 |

硬 | 使用回归树学习器,引导聚合或套袋。 |

高 |

提示

有关工作流示例,请参见使用回归学习程序训练回归树.

高级合奏选项

回归学习者使用fitrensemble功能训练集合模型。你可以设置这些选项:

最小叶大小

指定用于计算每个叶节点响应的最小训练样本数。当您生长回归树时,请考虑它的简单性和预测能力。要更改最小叶子大小,请单击按钮或在最小叶大小盒子。

一棵有许多小叶子的优良树通常对训练数据具有很高的准确性。然而,在独立的测试集中,树可能无法显示出可比较的准确性。一棵枝叶繁茂的树往往会过度拟合,它的验证精度往往远低于它的训练(或再替代)精度。

相比之下,大叶子较少的粗树不能获得高的训练精度。但是粗糙的树可以更健壮,因为它的训练精度可以接近一个有代表性的测试集。

提示

减少最小叶大小创建一个更灵活的模型。

许多学习者

试着改变学习者的数量,看看你是否能改进这个模型。许多学习者可以产生较高的准确性,但可能需要花费时间来适应。

提示

增加了许多学习者创建一个更灵活的模型。

学习速率

对于增强树,指定收缩的学习率。如果您将学习速率设置为小于1,则集成需要更多的学习迭代,但通常能够获得更好的准确性。0.1是一个很流行的初始选择。

或者,您可以让应用程序通过使用超参数优化自动选择一些模型选项。看到回归学习程序中的超参数优化.

神经网络

神经网络模型通常具有良好的预测精度;然而,它们并不容易解释。

模型的灵活性随着神经网络中全连接层的大小和数量的增加而增加。

提示

在模型类型画廊,点击所有的神经网络![]() 尝试每一个预设的神经网络选项,看看哪些设置产生最好的模型与您的数据。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

尝试每一个预设的神经网络选项,看看哪些设置产生最好的模型与您的数据。选择最好的模型在模型窗格,并尝试通过使用特性选择和更改一些高级选项来改进该模型。

| 回归模型类型 | 可解释性 | 模型的灵活性 |

|---|---|---|

| 狭窄的神经网络 |

硬 | 中等-随时间增加第一层的大小设置 |

| 中神经网络 |

硬 | 中等-随时间增加第一层的大小设置 |

| 广泛的神经网络 |

硬 | 中等-随时间增加第一层的大小设置 |

| 双层神经网络 |

硬 | 高-增加与第一层的大小和第二层的大小设置 |

| Trilayered神经网络 |

硬 | 高-增加与第一层的大小,第二层的大小,第三层的大小设置 |

每个模型都是一个用于回归的前馈、全连接的神经网络。神经网络的第一个完全连接层有一个来自网络输入(预测数据)的连接,每一个后续层都有一个来自前一层的连接。每个完全连通的层将输入乘以一个权值矩阵,然后添加一个偏置向量。激活函数跟随每一个完全连接的层,不包括最后一层。最后的全连接层产生网络的输出,即预测的响应值。有关更多信息,请参见神经网络结构.

例如,请参见使用回归学习应用程序训练回归神经网络.

高级神经网络选项

回归学习者使用fitrnet函数用于训练神经网络模型。你可以设置这些选项:

完全连接的层数-指定神经网络中完全连接的层数,不包括最终用于回归的完全连接层。您最多可以选择三个完全连接的层。

第一层的大小,第二层的大小,第三层的大小-指定每个完全连接层的大小,不包括最终完全连接层。如果您选择创建具有多个完全连接层的神经网络,请考虑指定大小较小的层。

激活—指定所有全连接层的激活功能,最终全连接层除外。从以下激活功能中选择:

线性整流函数(Rectified Linear Unit),双曲正切,没有一个,乙状结肠.迭代限制—指定最大训练迭代次数。

正则化强度(λ)-指定岭(L2)正则化惩罚项。

标准化数据—指定是否标准化数值预测器。如果预测器有很大的不同尺度,标准化可以提高拟合。强烈建议对数据进行标准化。

或者,您可以让应用程序通过使用超参数优化自动选择一些模型选项。看到回归学习程序中的超参数优化.