决策树

决策树,或分类树和回归树,预计数据响应。为了预测的响应,按照从根(开始)树上的决策节点到叶节点。叶节点包含响应。分类树给出的反应是名义上的,如'真正'要么'假'。回归树给数字响应。

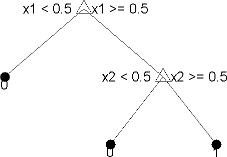

统计和机器学习工具箱™树是二进制的。在一个预测的每个步骤包括检查一个预测值(变量)的值。例如,下面是一个简单的分类树:

这棵树预测基于两个预测分类,X1和X2。为了预测,从顶部开始节点,通过一个三角形(Δ)来表示。第一个决定是,是否X1小于0.5。如果是这样,按照左分支,看到树,分类上述数据类型0。

但是,如果X1超过0.5,然后按照右分支到右下三角形节点。这里的树询问X2小于0.5。如果是这样,然后按照左分支看到树,分类上述数据类型0。如果没有,那么按照正确的分支看到,树中的数据类型进行分类1。

要了解如何利用决策树来准备你的数据进行分类或回归,看在监督学习步骤。

火车分类树

这个例子显示了如何培养一个分类树。

创建使用整个分类树电离层数据集。

加载电离层%含有X和Y变量MDL = fitctree(X,Y)

MDL = ClassificationTree ResponseName: 'Y' CategoricalPredictors:[]类名:{ 'B' 的 'g'} ScoreTransform: '无' NumObservations:351的属性,方法

火车回归树

这个例子显示了如何训练回归树。

创建使用所有的观测回归树carsmall数据集。考虑马力和重量矢量作为预测变量,并且MPG矢量作为响应。

加载carsmall%包含马力,重量,MPGX = [马力重量];MDL = fitrtree(X,MPG)

MDL = RegressionTree ResponseName: 'Y' CategoricalPredictors:[] ResponseTransform: '无' NumObservations:94的属性,方法

参考

[1] Breiman,L.,J。H.弗里德曼,R. A. Olshen,和C. J.石。分类和回归树。博卡拉顿:查普曼和霍尔,1984年。

也可以看看

ClassificationTree|RegressionTree|fitctree|fitrtree